LLM 기반 AI 에이전트, CRM 테스트에서 기대치 미달

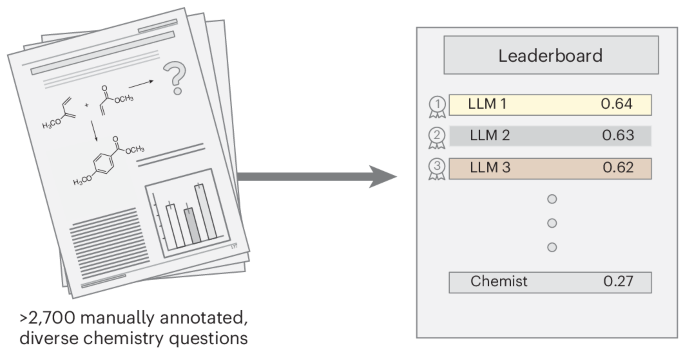

새로운 벤치마크에 따르면 대규모 언어 모델(LLM) 기반 AI 에이전트는 표준 CRM 테스트, 특히 기밀성 측면에서 기대치를 충족하지 못하는 것으로 나타났습니다. Salesforce 조사 결과 단일 단계 작업의 성공률은 58%이지만, 다단계 작업에서는 35%로 떨어집니다. 더욱 우려되는 점은 이러한 에이전트들이 기밀 정보에 대한 인식이 낮아 성능에 부정적인 영향을 미치고 있다는 것입니다. 이 연구는 기존 벤치마크의 한계를 강조하고 현재 LLM의 기능과 실제 기업의 요구 사항 간에 상당한 차이가 있음을 보여줍니다. 이는 효율성 향상을 위해 AI 에이전트에 의존하는 개발자와 기업에게 우려 사항이 될 것입니다.