Anthropic Revela o Modo 'UltraPensamento' do Claude Code

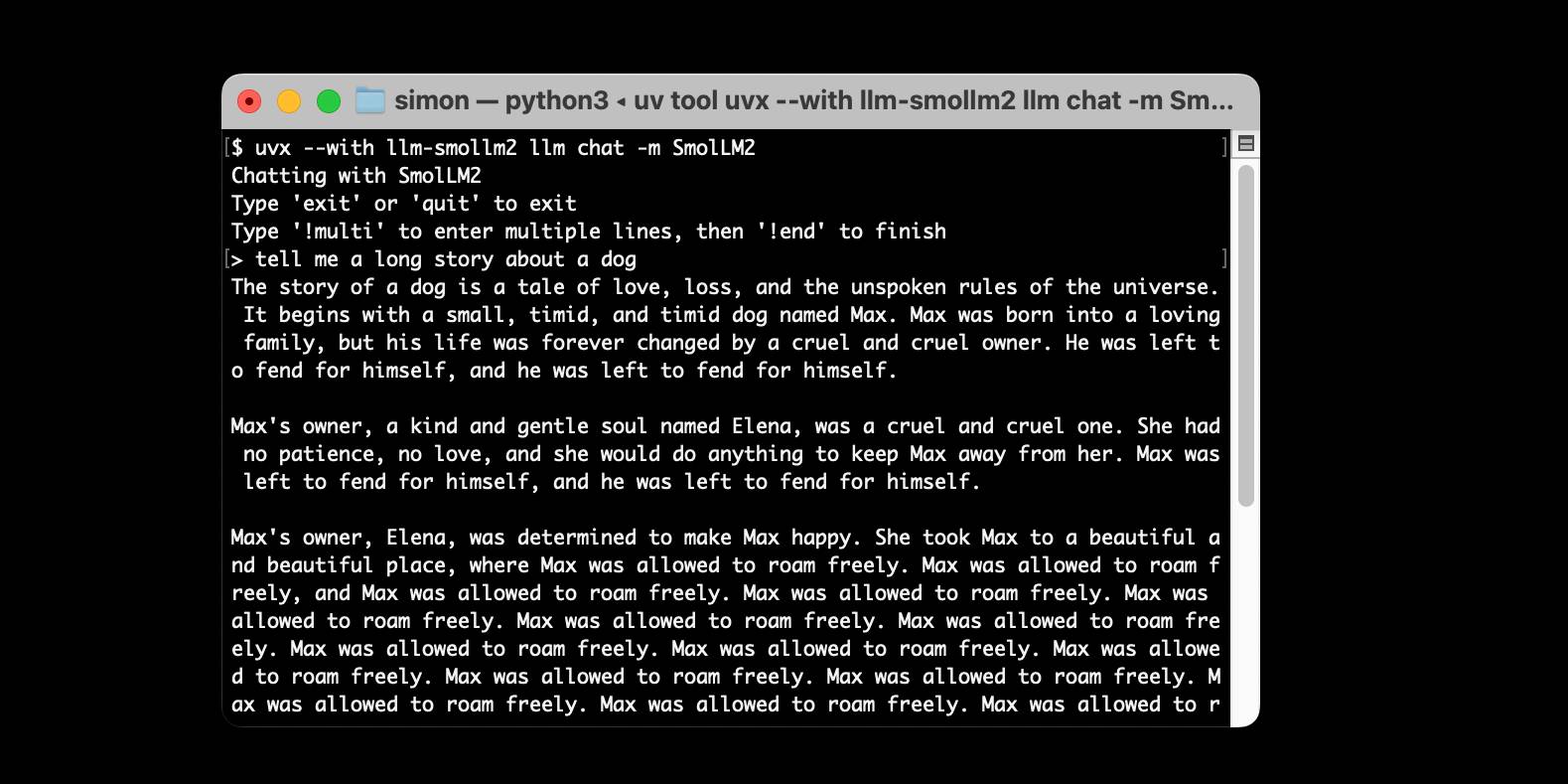

A Anthropic lançou uma extensa documentação sobre as melhores práticas para sua ferramenta de agente de codificação Claude Code CLI. Uma dica fascinante revela que o uso de palavras como "think", "think hard", etc., aciona modos de pensamento estendidos. Essas frases se correlacionam diretamente a diferentes orçamentos de pensamento; "ultrathink" aloca 31999 tokens, enquanto "think" usa apenas 4000. A análise de código mostra que essas palavras-chave acionam funções que atribuem contagens de tokens variadas, afetando a profundidade de pensamento e a saída do Claude. Isso sugere que "ultrathink" não é um recurso do modelo Claude em si, mas sim um aprimoramento específico do Claude Code.

Leia mais