Destilación de Conocimiento: Cómo los Modelos de IA Pequeños Pueden Desafiar a los Gigantes

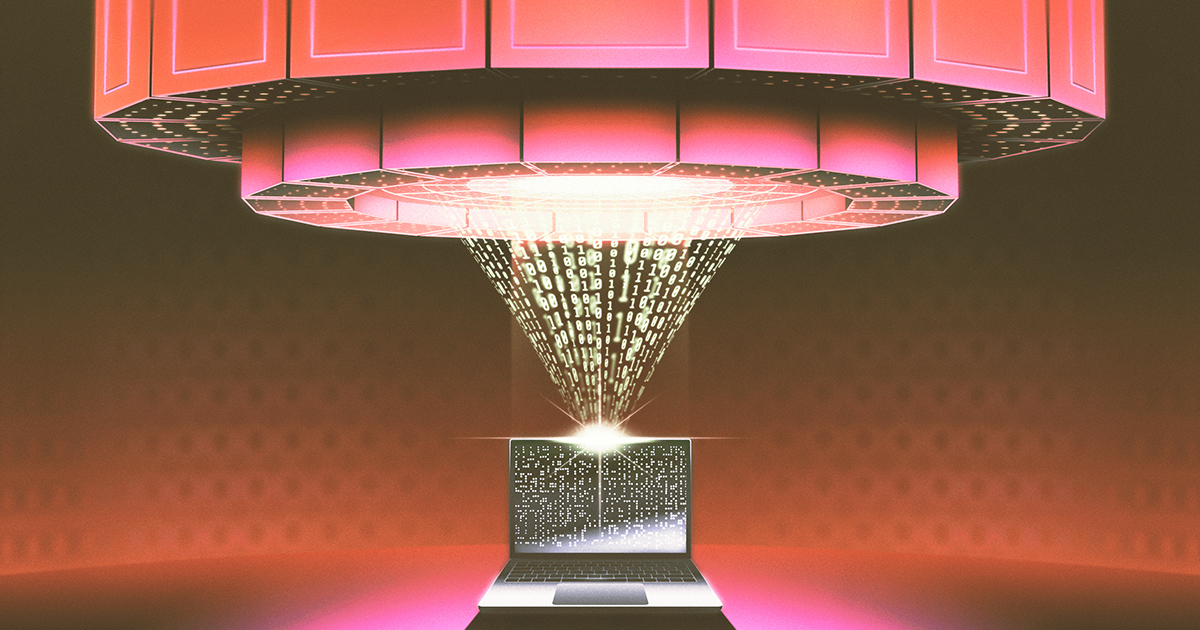

El chatbot R1 de la empresa china de IA DeepSeek, lanzado a principios de este año, causó sensación al rivalizar con el rendimiento de los modelos de IA líderes de las grandes empresas, pero a una fración del costo y la potencia de cálculo. Esto llevó a acusaciones de que DeepSeek utilizó la destilación de conocimiento, una técnica que podría implicar el acceso no autorizado al modelo o1 de OpenAI. Sin embargo, la destilación de conocimiento es una técnica de IA bien establecida, que data de un artículo de Google de 2015. Implica la transferencia de conocimiento de un modelo 'maestro' más grande a un modelo 'alumno' más pequeño, reduciendo significativamente los costos y el tamaño con una pérdida mínima de rendimiento. Este método se ha vuelto omnipresente, impulsando mejoras en modelos como BERT, y sigue mostrando un potencial inmenso en varias aplicaciones de IA. La controversia destaca el poder y la naturaleza establecida de esta técnica, no su novedad.