Ajustement fin efficace : Plongez au cœur de LoRA (Partie 1)

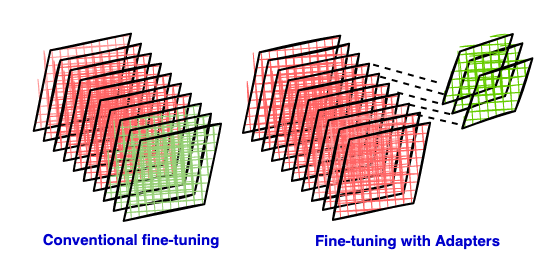

L'ajustement fin des grands modèles de langage nécessite généralement des ressources informatiques considérables. Cet article présente LoRA, une technique d'ajustement fin efficace en termes de paramètres. LoRA réduit considérablement le nombre de paramètres devant être entraînés en insérant des matrices de faible rang comme adaptateurs dans un modèle pré-entraîné, réduisant ainsi les coûts informatiques et de stockage. Cette première partie explique les principes sous-jacents à LoRA, notamment les lacunes de l'ajustement fin traditionnel, les avantages des méthodes efficaces en termes de paramètres et les bases mathématiques de l'approximation de faible rang. Les parties suivantes approfondiront l'implémentation et l'application spécifiques de LoRA.