Les titans de la tech vantent le pouvoir transformateur de l'IA lors d'un sommet à Paris

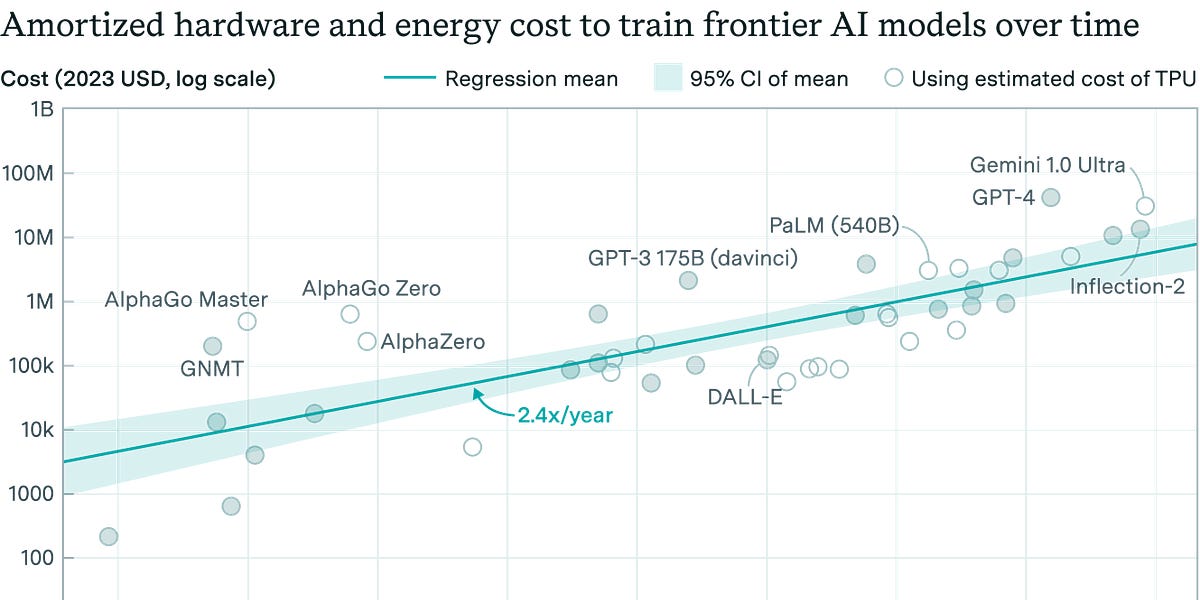

Lors d'un sommet récent à Paris, les PDG de grandes entreprises technologiques ont fait des prédictions audacieuses sur le potentiel transformateur de l'IA. Sundar Pichai d'Alphabet l'a qualifié de "changement le plus profond de nos vies", tandis que Dario Amodei d'Anthropic a prédit le "plus grand changement du marché du travail mondial de l'histoire de l'humanité". Sam Altman d'OpenAI a même suggéré que, d'ici une décennie, chacun pourrait accomplir plus que les individus les plus influents d'aujourd'hui. Ces déclarations reflètent une immense confiance en l'IA, mais soulèvent également des questions sur son orientation future et ses risques potentiels.