埋め込み次元:300から4096へ、そしてその先へ

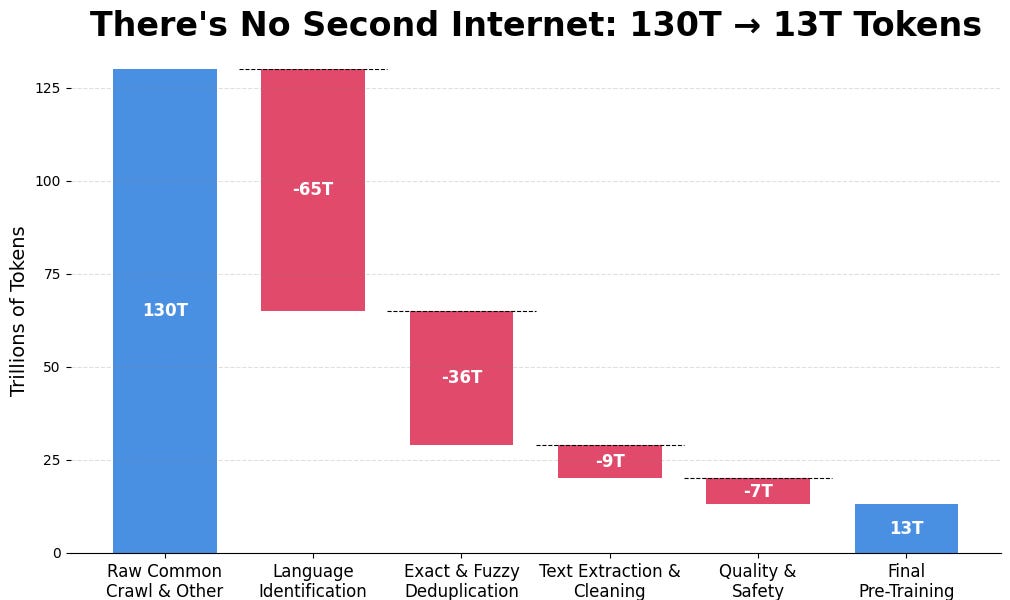

数年前、200~300次元の埋め込みは一般的でした。しかし、BERTやGPTなどの深層学習モデルの台頭とGPUコンピューティングの進歩により、埋め込みの次元数は爆発的に増加しました。BERTの768次元からGPT-3の1536次元、そして現在の4096次元以上へと進化しています。これは、アーキテクチャの変更(Transformer)、より大規模なトレーニングデータセット、Hugging Faceのようなプラットフォームの台頭、ベクトルデータベースの進歩によって推進されています。次元数の増加はパフォーマンスの向上をもたらしますが、ストレージと推論の課題も生じます。最近の研究では、Matryoshka学習などのより効率的な埋め込み表現が模索されており、パフォーマンスと効率のバランスを目指しています。