Anthropic、Claudeに影響する3つのインフラストラクチャのバグを修正

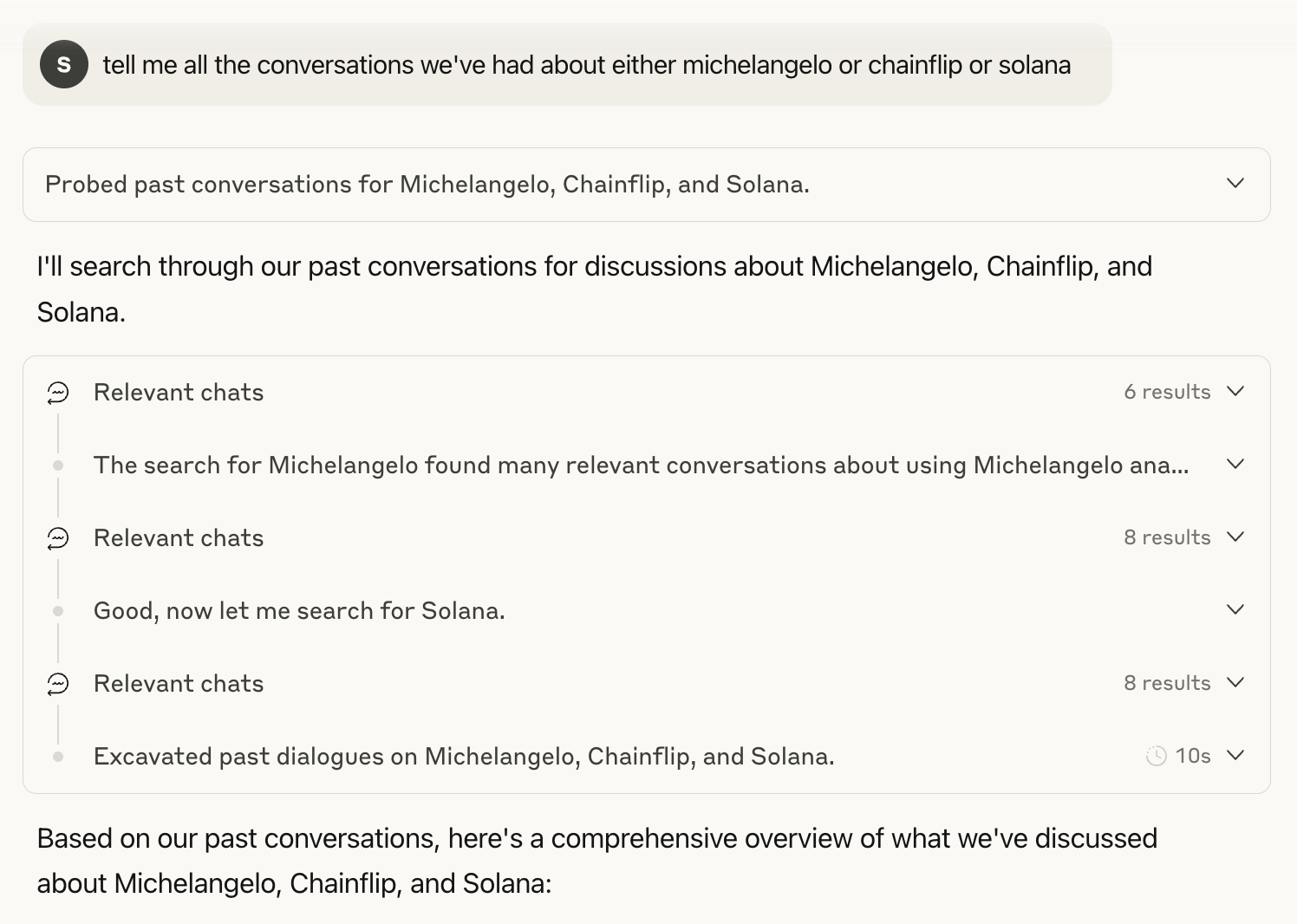

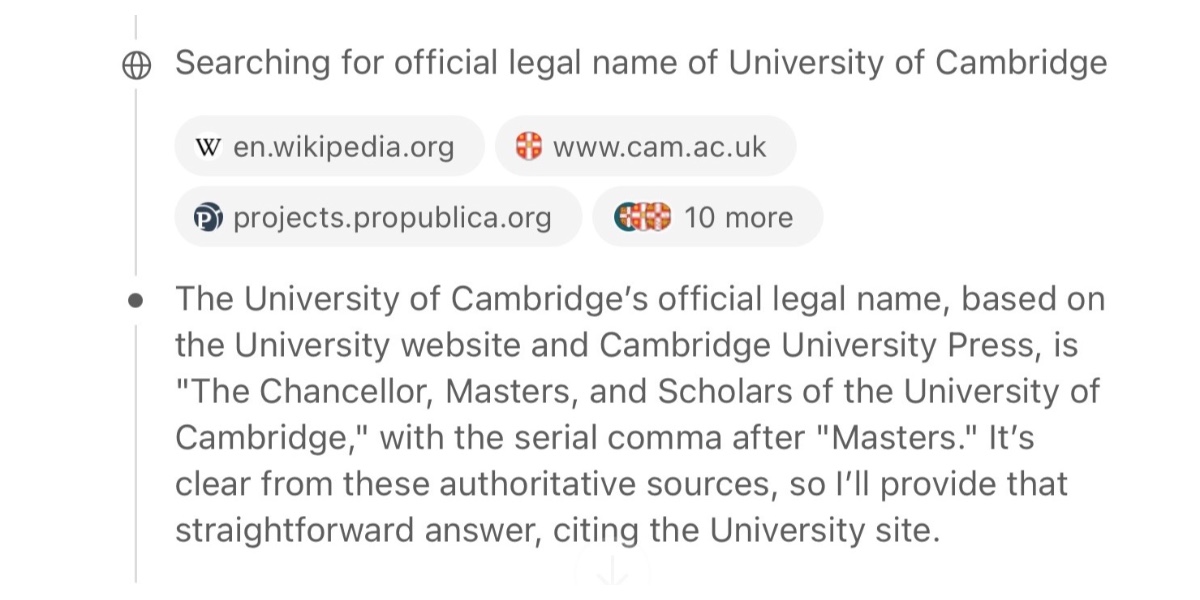

Anthropicは、8月から9月上旬にかけて、3つのインフラストラクチャのバグにより、Claudeの応答品質が断続的に低下したことを認めました。これらのバグは、リクエストの誤ったルーティング、出力の破損、コンパイルエラーを引き起こし、一部のユーザーに影響を与えました。Anthropicは、これらのバグの原因、診断、解決策を詳細に説明し、再発防止のために評価とデバッグツールの改善に注力すると約束しました。このインシデントは、大規模言語モデルのインフラストラクチャの複雑さと課題を浮き彫りにしています。