一致性大语言模型:高效并行解码器家族

2024-05-08

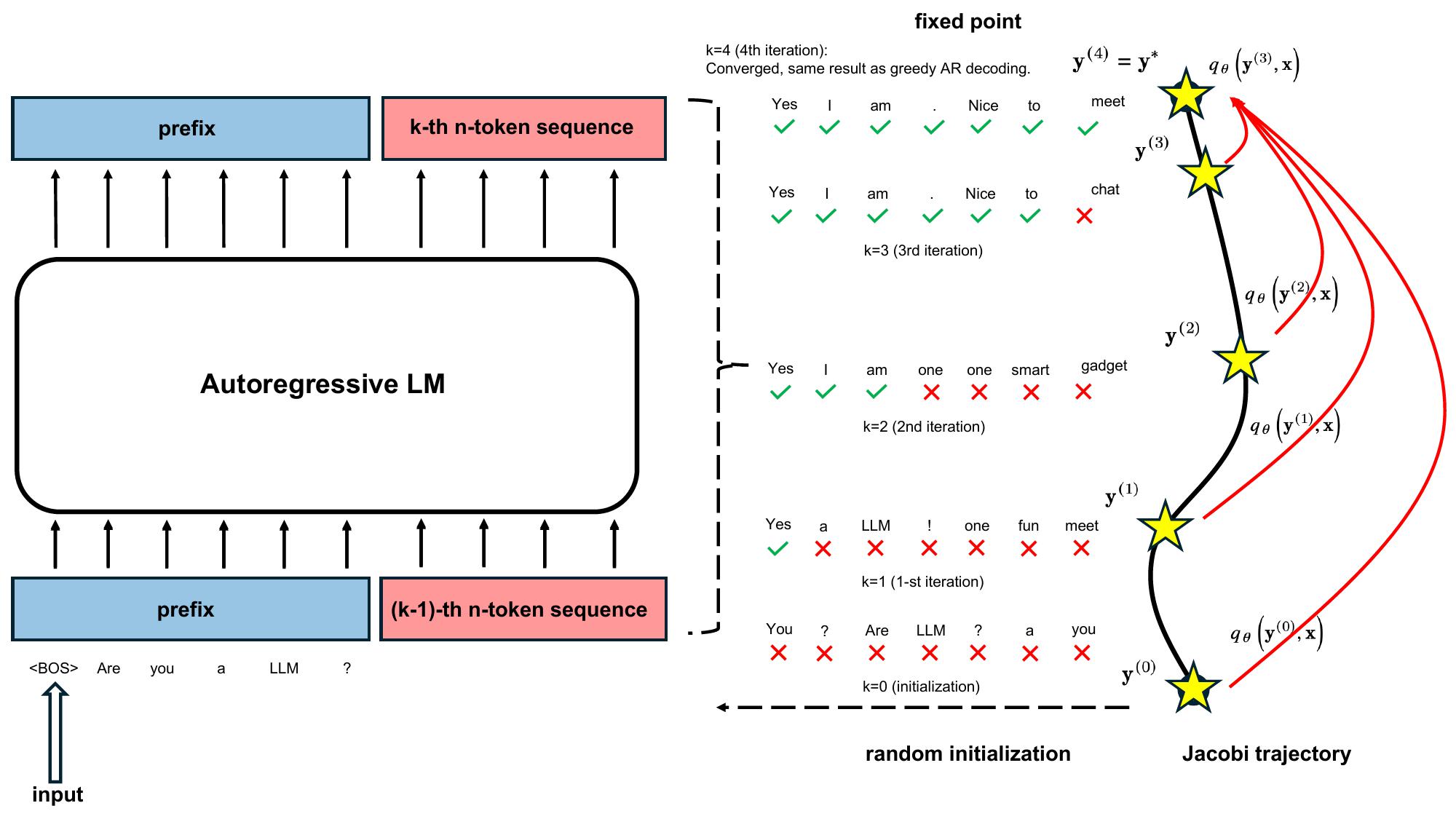

这篇博客介绍了一致性大语言模型 (CLLM),这是一种新型并行解码器,能够通过在每个推理步骤中高效地解码 n 个标记序列来减少推理延迟。研究表明,这个过程(模仿人类在逐字表达之前在脑海中形成完整句子的认知过程)可以通过简单地微调预训练的 LLM 来有效地学习。具体来说,CLLM 被训练通过将任何随机初始化的 n 个标记序列映射到自回归 (AR) 解码在尽可能少的步骤中产生的相同结果来执行并行解码。实验结果表明,使用我们提出的方法获得的 CLLM 非常有效,生成速度提高了 2.4 倍到 3.4 倍,与 Medusa2 和 Eagle 等其他快速推理技术相当,甚至更好,但在推理时不需要额外的内存成本。

45