梯度下降优化算法概述

2025-01-25

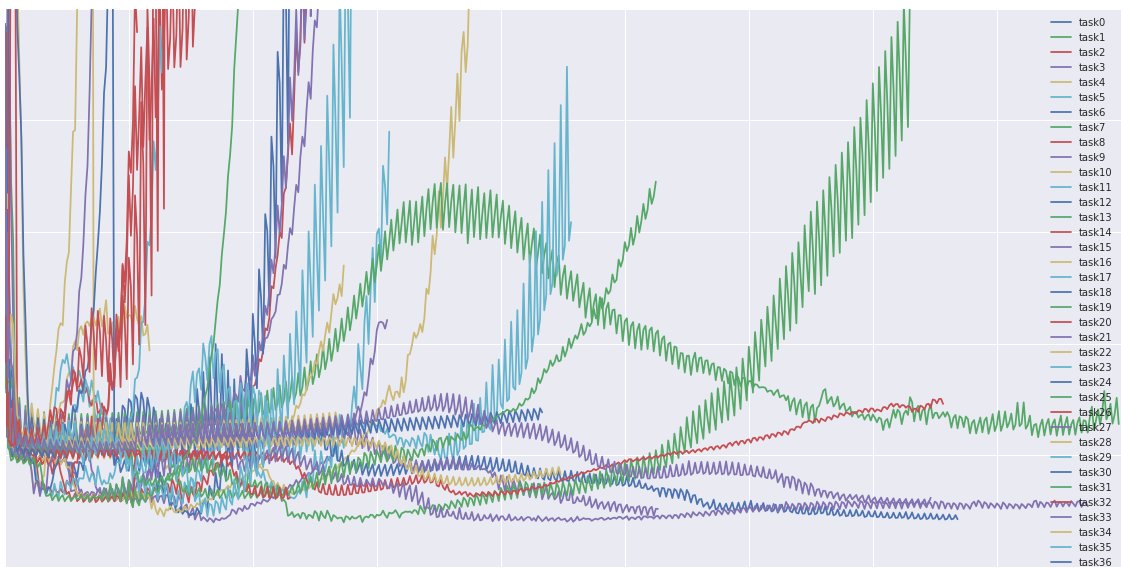

本文深入浅出地讲解了梯度下降优化算法,这是优化神经网络和其他机器学习算法的首选方法。文章从梯度下降的变体(批量梯度下降、随机梯度下降、小批量梯度下降)开始,探讨了训练过程中的挑战,例如学习率选择和鞍点问题。随后,文章详细介绍了各种流行的基于梯度的优化算法,包括动量法、Nesterov 加速梯度法、Adagrad、Adadelta、RMSprop、Adam、AdaMax、Nadam和AMSGrad,并解释了它们的原理和更新规则。此外,文章还涵盖了并行和分布式设置下优化梯度下降的算法和架构,以及其他一些提高梯度下降性能的策略,例如洗牌和课程学习、批量归一化、提前停止和梯度噪声。

开发