本地LLM推理:潜力巨大,但工具尚需完善

2025-04-21

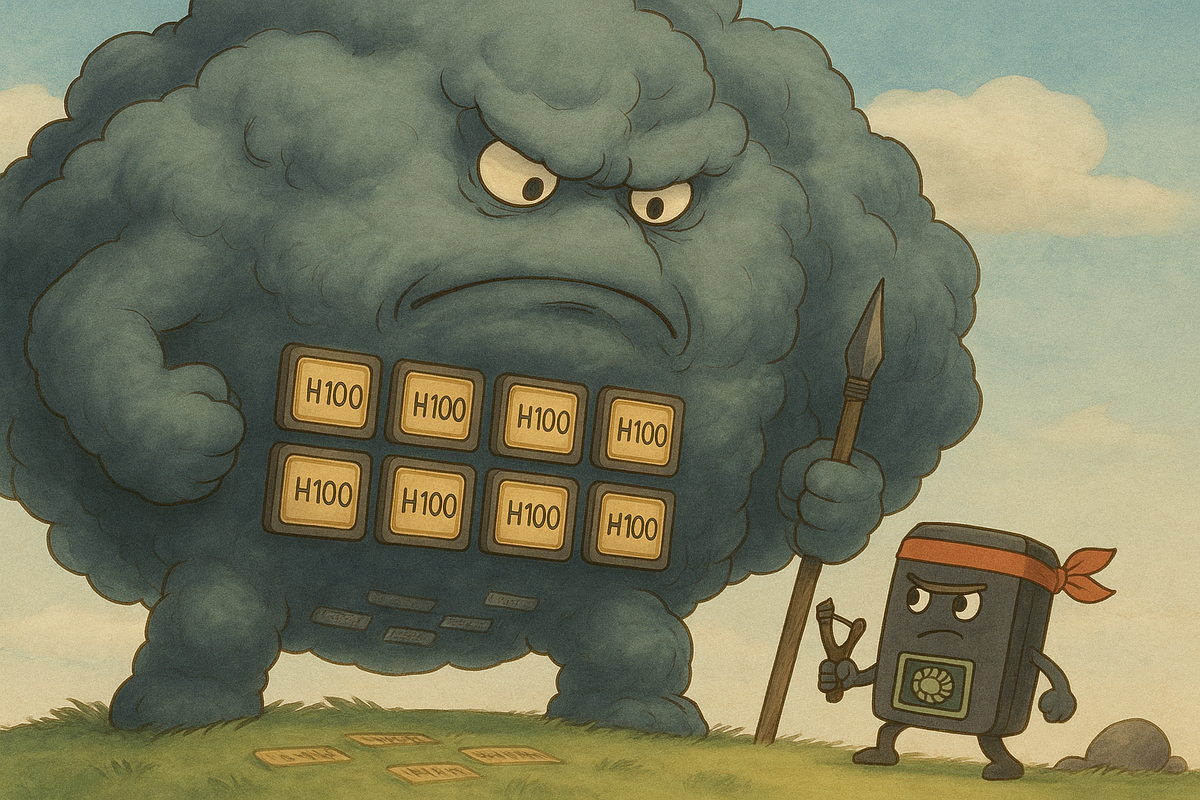

本文评测了llama.cpp、Ollama、WebLLM等本地LLM推理框架的性能。结果显示,llama.cpp和Ollama速度惊人,但仍慢于OpenAI的gpt-4.0-mini。更大的挑战在于模型选择和部署:众多模型版本令人眼花缭乱,即使是量化后的7B模型也超过5GB,下载和加载缓慢,影响用户体验。作者认为,未来本地LLM推理需要更便捷的模型训练和部署工具,并与云端LLM紧密集成,才能真正走向实用。

开发