DeepSeek v3:Transformer 架构的重大改进

2025-01-28

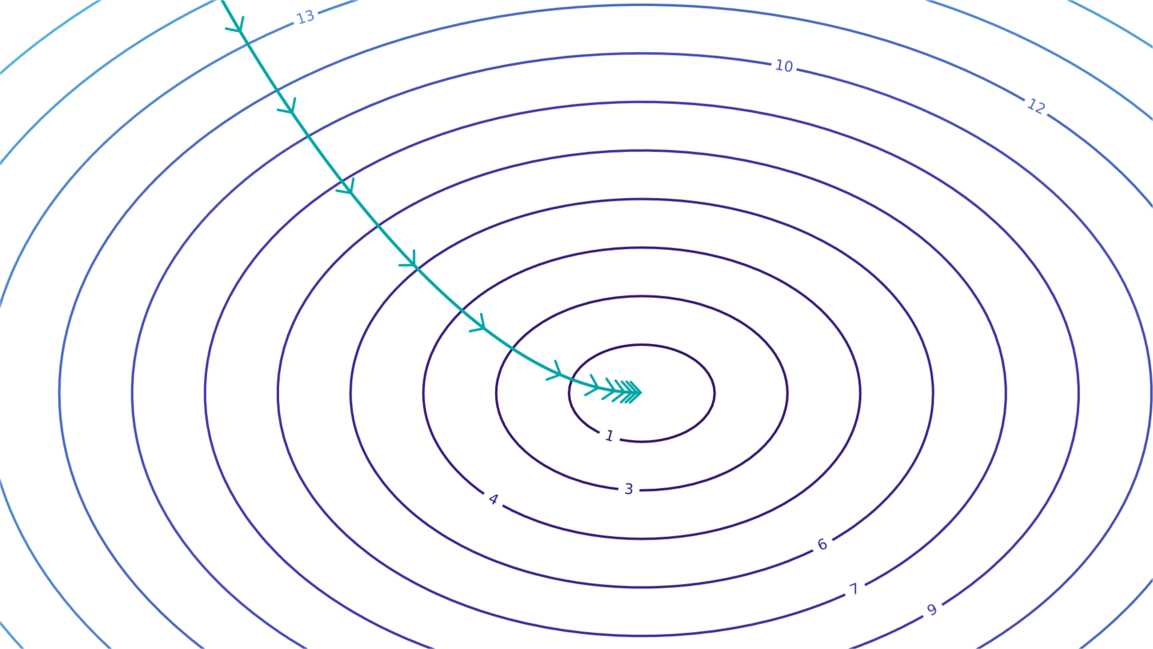

DeepSeek v3 在基准测试中取得了最先进的性能,其训练计算量却远低于同类模型。这得益于其在Transformer架构上的几项关键改进:多头潜在注意力(MLA)机制显著减小了KV缓存大小,无需牺牲模型质量;改进的混合专家(MoE)方法通过辅助损失免费负载平衡和共享专家策略解决了路由崩溃问题;多标记预测则提升了训练效率和推理速度。这些改进体现了DeepSeek团队对Transformer架构的深刻理解,为大型语言模型的发展指明了方向。

(epoch.ai)

AI