大型语言模型中的过时信息:逻辑矛盾的根源

2025-01-12

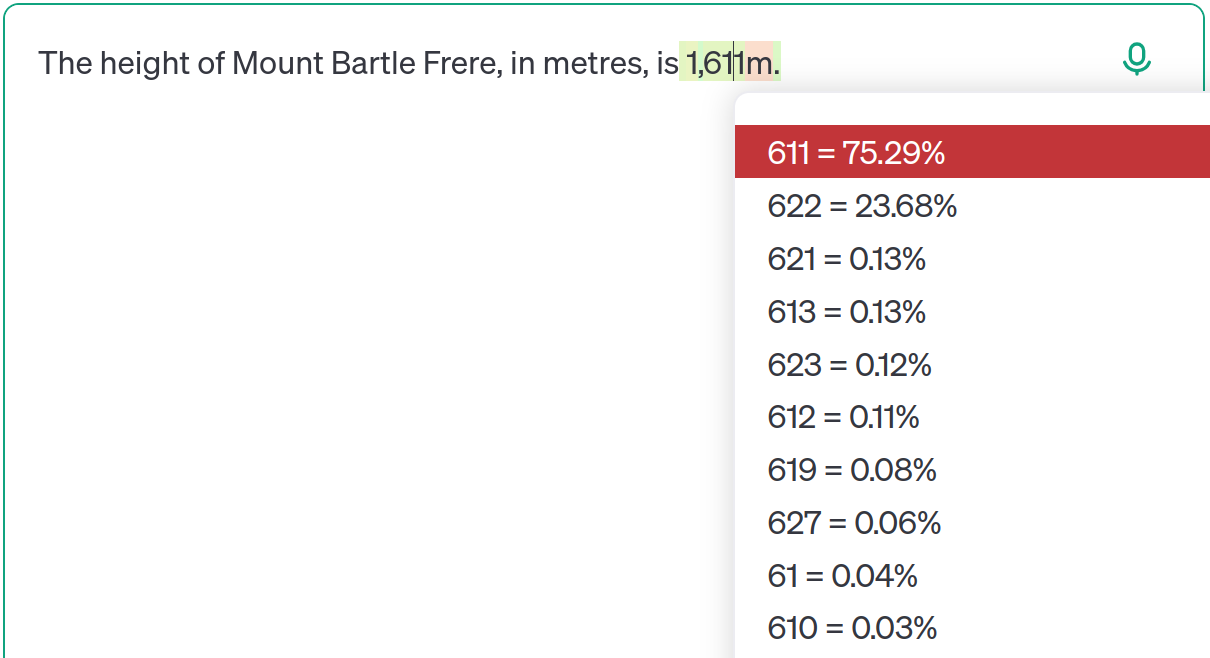

大型语言模型(LLM)如ChatGPT,其训练数据包含大量过时或冲突信息。文章以澳大利亚昆士兰州最高山巴特尔弗雷尔山的精确高度为例,探讨了LLM如何处理此类冲突信息。研究发现,LLM并非总是给出最新答案,而是根据其训练数据中不同信息的概率分布进行预测。即使是最新的GPT-4o模型,也可能因为提示词的细微变化而输出过时信息。这并非简单的“幻觉”,而是模型学习了多种可能性并根据上下文调整概率的结果。作者呼吁关注LLM的局限性,避免过分依赖,并强调透明度的重要性。

阅读更多