GPT-5 : Plongeon au cœur des prix, de la fiche modèle et des caractéristiques clés

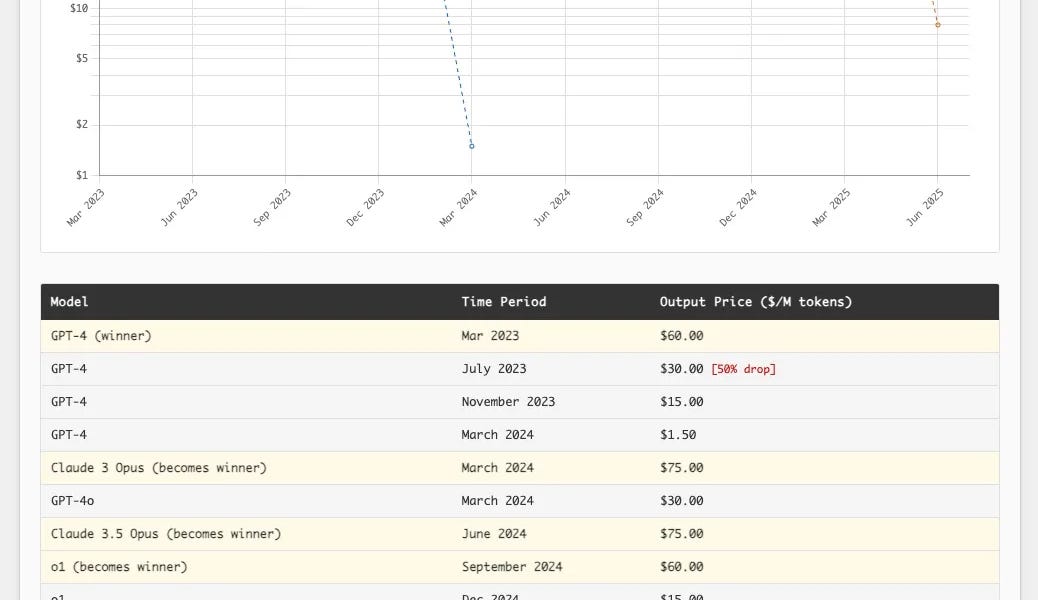

La famille GPT-5 d'OpenAI est arrivée ! Il ne s'agit pas d'un bond révolutionnaire, mais elle surpasse largement ses prédécesseurs en termes de fiabilité et d'utilisabilité. Dans ChatGPT, GPT-5 est un système hybride qui bascule intelligemment entre les modèles en fonction de la difficulté du problème ; la version API propose des modèles régulier, mini et nano avec quatre niveaux de raisonnement. Il possède une limite d'entrée de 272 000 jetons et une limite de sortie de 128 000 jetons, prenant en charge l'entrée de texte et d'image, mais uniquement la sortie de texte. Le prix est extrêmement compétitif, surpassant largement les concurrents. De plus, GPT-5 affiche des améliorations significatives en termes de réduction des hallucinations, d'amélioration du suivi des instructions et de minimisation de la flatterie, en utilisant une nouvelle approche d'entraînement de sécurité. Il excelle dans l'écriture, le codage et les soins de santé. Cependant, l'injection de prompt reste un problème non résolu.

![Modèle d'image open source FLUX.1-Krea [dev] : Briser le « look IA »](https://www.krea.ai//_app/77be82153701096c/immutable/assets/thumbnail.DSqx6EeB.webp)