LLMのための表データの活用:機械的蒸留アプローチ

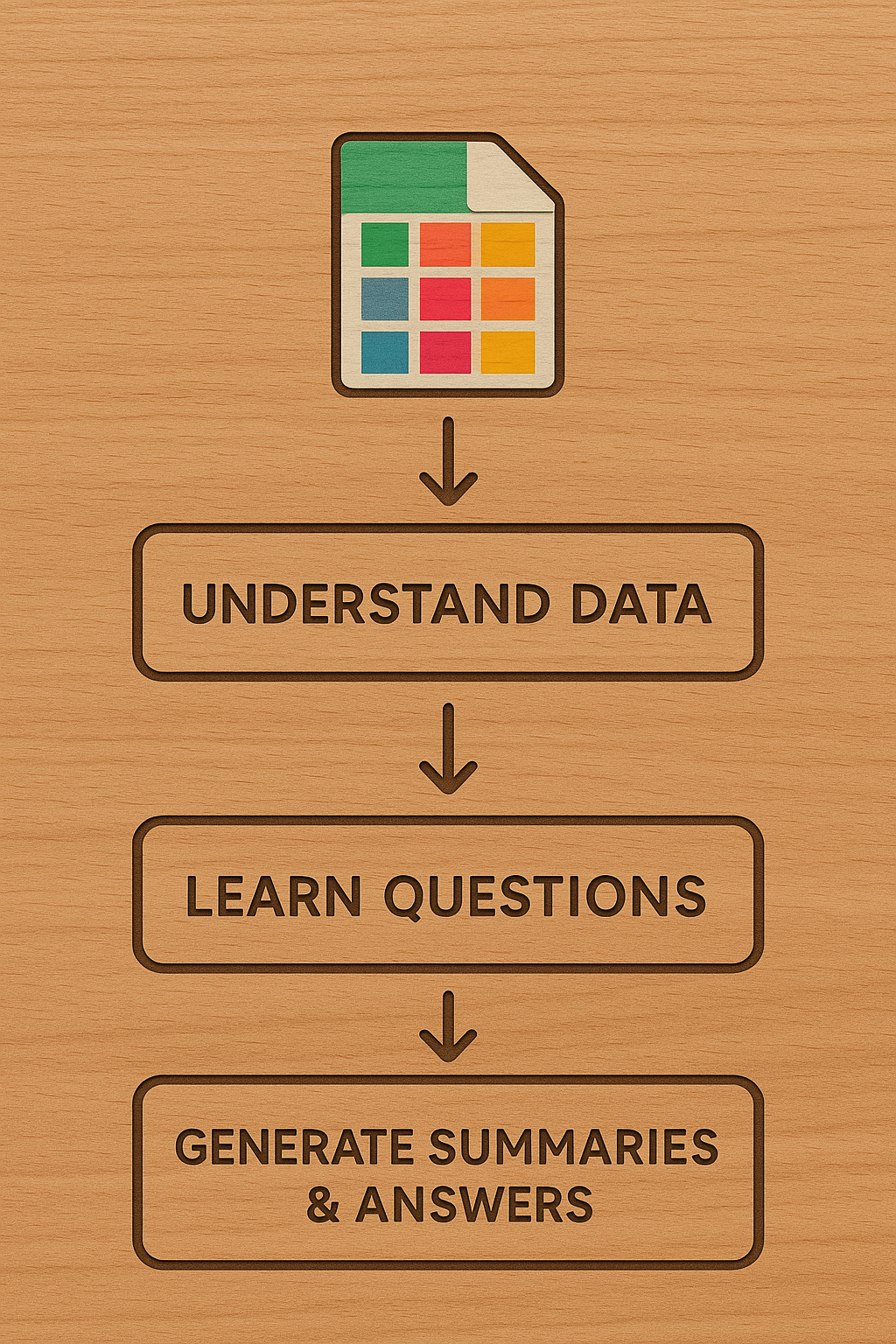

大規模言語モデル(LLM)はテキストや画像データの処理に優れていますが、表形式データの処理には苦労しています。現状では、LLMは公開されている統計要約に主に頼っており、アンケートデータなどの表形式データセットに含まれる知識を十分に活用できていません。本稿では、機械的蒸留技術を用いて、一変量、二変量、および多変量の要約を作成する新しいアプローチを提案しています。これは、LLMに関連する質問を提案させ、データから学習させることで補強されます。3段階のパイプラインには、データ構造の理解、質問タイプの特定、機械的要約と視覚化の生成が含まれます。著者らは、このアプローチが、検索拡張生成(RAG)システムの強化や、潜在的にバイアスのかかった「世界データ」の補完に役立つ可能性があると示唆しており、検証には科学論文リポジトリ(Harvard Dataverseなど)や管理データから始めることを推奨しています。