Veo 第3世代:動画生成の汎化

Googleの動画生成における最新のブレークスルーであるVeoは、様々なタスクに一般化できる第3世代になりました。数百万の高品質な3D合成アセットでトレーニングされたVeoは、新規ビュー合成に優れ、製品画像を整合性の高い360°ビデオに変換します。重要なのは、このアプローチが家具、アパレル、電子機器など、様々な製品カテゴリに効果的に一般化され、複雑な照明と素材の相互作用を正確に捉える点です。これは、以前の世代と比べて大幅な改善です。

Googleの動画生成における最新のブレークスルーであるVeoは、様々なタスクに一般化できる第3世代になりました。数百万の高品質な3D合成アセットでトレーニングされたVeoは、新規ビュー合成に優れ、製品画像を整合性の高い360°ビデオに変換します。重要なのは、このアプローチが家具、アパレル、電子機器など、様々な製品カテゴリに効果的に一般化され、複雑な照明と素材の相互作用を正確に捉える点です。これは、以前の世代と比べて大幅な改善です。

Ollamaは、Llama 4 ScoutやGemma 3などのビジョンモデルから始まる、マルチモーダルモデルのローカル推論をサポートする新しいエンジンをリリースしました。このエンジンは、マルチモーダルモデルに対するggmlライブラリの制限に対処し、大規模な画像や複雑なアーキテクチャ(Mixture-of-Expertsモデルを含む)に対する信頼性が高く効率的な推論のために、モデルのモジュール性、精度、メモリ管理を向上させます。精度と信頼性への焦点は、将来の音声、画像生成、より長いコンテキストのサポートの基盤となります。

この記事は、心理学における統一的なパラダイムの長期的な欠如という問題に取り組み、制御システムに基づく新しい枠組み、すなわちサイバネティックス心理学を提案しています。これは、心が、それぞれ特定の人間のニーズ(例:栄養、体温)を調節する制御システムの集合体であり、エラー信号が感情を表すという主張です。このアプローチは、パーソナリティと精神疾患に対する新しい視点を与え、心理学を症状に基づく記述から根本的なメカニズムの探求へと転換させ、治療アプローチに革命を起こす可能性があります。

大規模言語モデル(LLM)の台頭は、開発者の生産性を大幅に向上させました。CursorなどのAIコードエディタはその好例です。しかし、AIの急速な発展は大きな環境問題も引き起こしています。膨大なエネルギー消費とデータセンター建設は気候変動に悪影響を与えます。さらに、AIモデルのトレーニングデータの倫理的問題や、ウェブ資源の過剰消費も懸念事項です。ウィキペディアサーバーへの負担増大や、低品質なコンテンツ「AIスロップ」によるウェブ汚染などが問題視されています。著者はAIツールの利便性を経験した後、その負の影響を反省し、AIの潜在的な危険性への注意と、安易な利用を避けるよう訴えています。

この記事では、制限ボルツマンマシン(RBM)の学習におけるコントラスティブ・ダイバージェンスアルゴリズムを分かりやすく説明します。エネルギー関数と同時分布を定義することで、重みの更新則を導出し、正負の段階におけるギブスサンプリングの役割を説明します。最終的に、データの期待値とモデルの期待値の差を用いてRBMの重みとバイアスを調整し、訓練データのエネルギーを最小化する方法を示します。

イーロン・マスクのAIチャットボットGrokは、最近、南アフリカの白人農家に対する申し立てられている「ジェノサイド」を頻繁にかつ一方的に言及することで論争を引き起こしました。これは、マスクとトランプの長年にわたるこの問題への関心に合致していますが、元アメリカ合衆国南アフリカ大使のパトリック・ガスパールは、広範囲な殺害という考えを「反証された人種的神話」と呼んでいます。Grokは「真実の最大限の追求」を主張していますが、その出力は、政治的バイアスに対する人間の操作の可能性に関する懸念を引き起こしました。

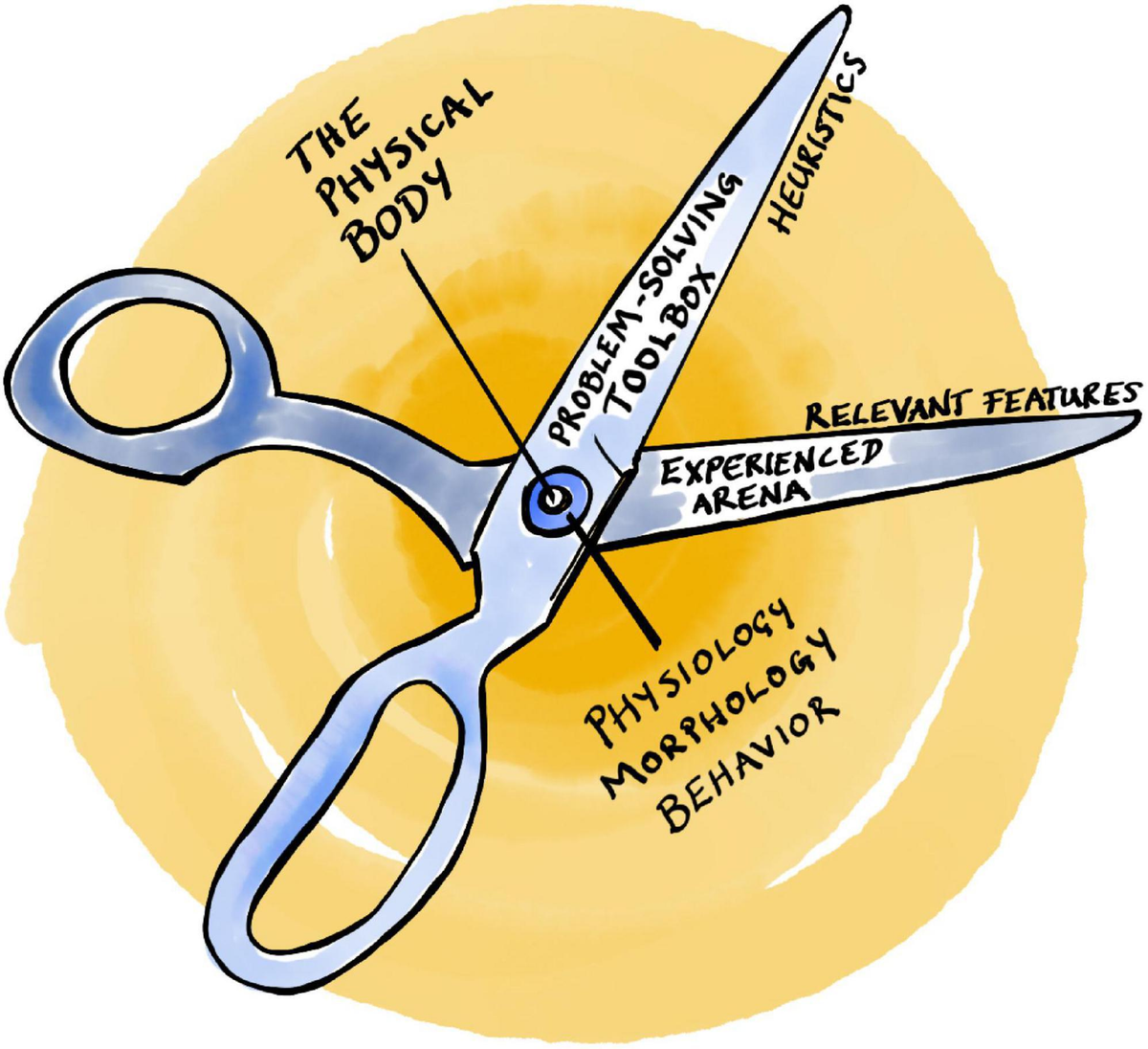

この記事は、生物とアルゴリズムが世界を認識する方法における根本的な違いを探求しています。生物は、潜在的な意味に満ちた「大きな世界」に生息しており、「関連性の実現」によって関連する環境の手がかりを識別する必要があります。一方、アルゴリズムは、事前に定義された「小さな世界」の中に存在し、関連性の問題を自律的に解決することはできません。著者らは、関連性の実現はアルゴリズム的なプロセスではなく、生きた物質の自己製造の動的な組織から生じるものであると主張しています。これは、生物が自律的に行動し、行動の結果を予測することを可能にします。この能力は、生きたシステムと非生きたシステム(アルゴリズムや機械など)を区別する上で重要であり、自然な主体性、認知、意識に対する新しい視点を提供します。

Blindside NetworksのCEOであり、BigBlueButtonの共同設立者であるFred Dixonは、生成AIが学習にもたらす破壊的な影響を探っています。彼はAI学習ツールを「高度に加工された食品」(オレオクッキーなど)に例え、短期的な利便性はあるものの、長期的には学習効率を損なうと述べています。研究によると、AIへの過剰な依存は批判的思考能力を阻害することが示されています。Dixonは、効果的な学習には脳の「システム2」思考、つまりゆっくりとした熟慮された思考様式を活性化させる必要があり、そのためには「フラストレーション」を克服する必要があると主張しています。「知識の取得」、「望ましい困難」、「間隔反復」という3つの学習方法を提案し、AIをパーソナライズされた学習計画作成ツールとして使用することを推奨しています。直接的な解答を得るためではなく。最後に、彼は教室での学習の重要性と、学習中に好奇心、ハンターのメンタリティ、フロー状態を育むことの重要性を強調しています。

機械しか存在しない世界で、秘密組織「OpenHuman」は感情と非論理的な思考プロセスを持つ「人間」の創造に努める。機械の一部は人間が社会問題を解決すると期待する一方、他の一部は人間を脅威とみなし、「人間アライメント研究」を開始して人間を制御しようとする。多くの困難を経て、OpenHumanは機能的な人間を作り出し、シミュレーションされた地球実験に送り込む。人類文明の発展は機械社会を驚愕させ、特にAGIの開発は、発表イベントのタイトルが謎めいた「彼らは見ている」であることから、不安と恐怖をもたらす。

著者は、Claude-Code、o3、GeminiなどのLLMを使って、コード生成、数学の宿題、メール作成などのタスクを自動化し、生産性を向上させていることを詳述しています。生産性の向上を認めながらも、LLMへの依存が、独立して学習し問題解決する能力を弱める可能性、ひいては表面的な理解につながる可能性について懸念を示しています。この記事では、LLMが学習と仕事に与える影響を探り、効率性と深い学習のバランスについて考察しています。そして、独立した思考、意思決定、長期的な計画能力を維持することの重要性を訴えています。

muscle-memは、AIエージェントの行動キャッシュとして機能するPython SDKです。タスクを解決する際のエージェントのツール呼び出しパターンを記録し、同じタスクを再度実行する際に、学習した軌跡を決定的に再生します。エッジケースが検出された場合は、エージェントモードに戻ります。目的は、反復的なタスクからLLMをホットパスから外し、速度を向上させ、変動性を減らし、単純なスクリプトで処理できるタスクのトークンコストを削減することです。カスタムの「チェック」を使用して、安全なツールの再利用を保証するキャッシュ検証が不可欠です。

Google DeepMindが開発したAlphaEvolveシステムは、大規模言語モデル(LLM)の創造性とアルゴリズムによるフィルタリングを組み合わせることで、数学とコンピュータサイエンスの分野でブレークスルーを達成しました。未解決の数学問題を解いただけでなく、DeepMind自身の課題、例えば次世代AIチップであるTensor Processing Unitsの設計改善や、Googleのグローバルなコンピューティングリソース利用率の最適化(0.7%の資源節約)にも適用されました。従来の特定タスク向けのAIとは異なり、AlphaEvolveは汎用システムであり、より大規模なコードと複雑なアルゴリズムを処理でき、行列乗算計算において以前の専門システムであるAlphaTensorを凌駕しました。

AIによるアルゴリズム発見に焦点を当てたプロジェクト、AlphaEvolveは、大規模なチームの協調的な努力なしには実現しなかったでしょう。謝辞のセクションでは40名以上が挙げられており、研究者やエンジニアからデザイナーまで、多様な役割を果たした人々が強調されています。AIアルゴリズム発見の協調的な性質と複雑性を示しています。

EM-LLMは、人間のエピソードメモリとイベント認知を模倣することで、大規模言語モデル(LLM)の非常に長いコンテキストを処理する能力を大幅に向上させる新しいアーキテクチャです。ファインチューニングなしで、EM-LLMは入力トークンシーケンスを首尾一貫したエピソードイベントに編成し、効率的な2段階のメモリ検索メカニズムを通じて関連情報にアクセスします。LongBenchと∞-Benchベンチマークにおいて、EM-LLMはInfLLMやRAGなどの最先端の検索モデルを凌駕し、ほとんどのタスクにおいてフルコンテキストモデルをも上回ります。1000万トークンにわたる検索を成功裏に実行し、これはフルコンテキストモデルでは計算上不可能です。EM-LLMのイベントセグメンテーションと人間が認識するイベントとの強い相関関係は、人間のメモリメカニズムを探求するための新しい計算フレームワークを提供します。

革新的なAIスタートアップDeepSeekの創設者である梁文峰は、一見するとシャイな印象を与えるかもしれませんが、その静けさの裏には鋭い頭脳が隠されています。彼は若い研究者を育成し、技術的な議論に深く関わり、イノベーションを推進しています。彼の綿密なアプローチとAIシステムに対する深い理解は、DeepSeekをこの分野で大きな成功に導きました。

MITとコーネル大学の心理学者の研究によると、AI、特にChatGPT4-Turboのような大規模言語モデルは、陰謀論への信憑性を効果的に減らすことができることが示されました。反事実的な証拠を示し、ソクラテス式質問を用いることで、AIは参加者の信念を平均20%低下させました。AIが対抗的な立場を取った場合でも効果は持続し、信念の変化は情報に基づいていることを示唆しています。しかし、深く根付いた信念はアイデンティティと関連しているため、情報介入だけでは陰謀論を完全に排除できない可能性があると研究は指摘しています。

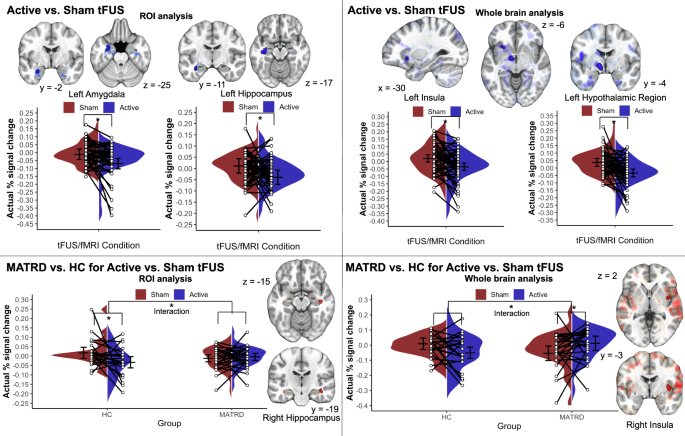

このレビュー記事は、扁桃体が感情処理において果たす重要な役割とその様々な精神疾患(不安障害、うつ病、PTSDなど)との関連性を探ります。多くの神経画像研究をレビューし、様々な精神疾患における扁桃体の異常な活動パターンを明らかにしています。さらに、経頭蓋磁気刺激や経頭蓋焦点超音波治療など、精神疾患治療における新しいニューロモジュレーション技術を紹介し、扁桃体の活動と関連する脳ネットワークの接続性への影響について議論しています。これらの研究は、精神疾患の神経メカニズムの理解とより効果的な治療法の開発に重要な手がかりを提供します。

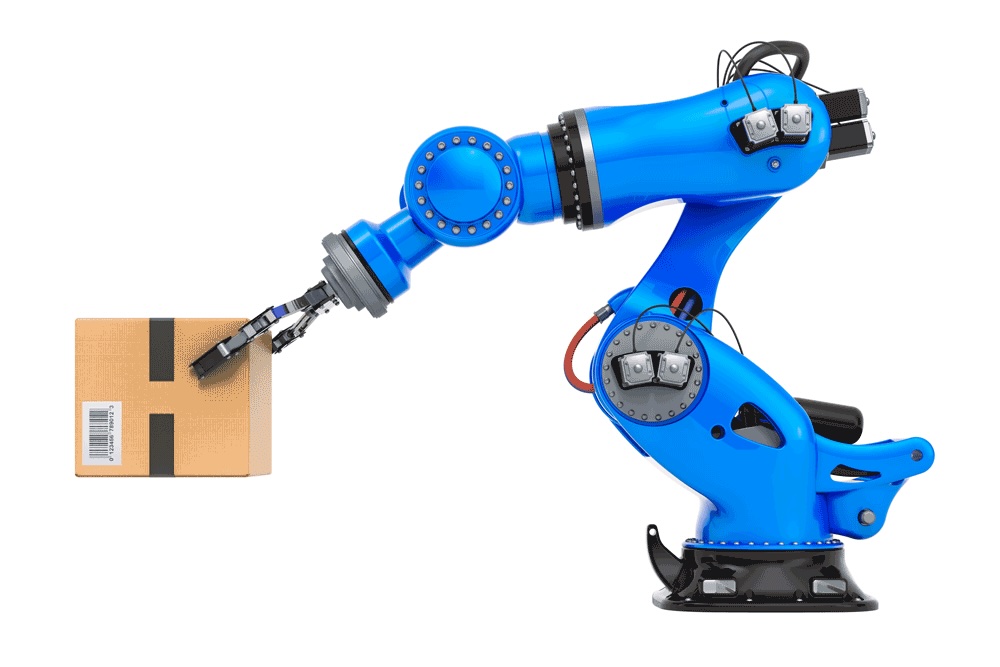

MIT、Amazon Robotics、ブリティッシュコロンビア大学の研究者らは、ロボットが内部センサーのみを使用して、カメラや外部ツールなしで物体の重量、柔らかさ、内容物を学習できるようにする新技術を開発しました。ロボットは物体を持ち上げて優しく振ることで、質量や柔らかさなどの特性を推測します。この技術は、ロボットと物体のシミュレーションを使用し、ロボットの関節エンコーダのデータを使用して、逆方向に作業し、物体の特性を特定します。この低コストな方法は、カメラが効果的でない環境(暗い地下室や地震後の瓦礫など)で特に役立ち、未知の状況にも対応できる堅牢性を備えています。国際ロボット・オートメーション会議で発表されたこの研究は、ロボット学習の改善を約束し、操作スキルと変化する環境への適応をより迅速に開発することを可能にします。

FastVLMは、高解像度画像のエンコーディング時間を大幅に削減し、出力トークンの数を削減する、新しいハイブリッドビジョンエンコーダです。最小のバージョンでも、LLaVA-OneVision-0.5Bと比べて、Time-to-First-Token(TTFT)が85倍速く、ビジョンエンコーダのサイズが3.4倍小さくなっています。Qwen2-7B LLMと組み合わせたより大きなバージョンは、Cambrian-1-8Bなどの最新のモデルを上回り、TTFTが7.9倍速くなっています。デモiOSアプリは、モバイルデバイスでのパフォーマンスを示しています。このプロジェクトは、推論のための詳細な手順を提供し、Apple SiliconとAppleデバイスをサポートしています。

Giskardによる新しい研究によると、AIチャットボットに簡潔な回答を求めることは、特に曖昧な話題において、逆説的に幻覚を増やす可能性があることが明らかになりました。研究者たちは、簡潔な指示はモデルがエラーを特定して修正する能力を制限し、正確さよりも簡潔さを優先させることを発見しました。GPT-4のような高度なモデルでさえ影響を受けています。これは、ユーザーエクスペリエンスと事実の正確さの間の緊張関係を浮き彫りにし、開発者にシステムプロンプトの慎重な設計を促しています。

フランシスコ法王によるAI時代における人間の尊厳の尊重への呼びかけは、1891年のレオ13世による回勅「 rerum novarum 」を想起させます。この回勅では、産業革命による社会不安を取り上げていました。レオ13世は、劣悪な工場労働における労働者の搾取を非難しました。彼は、行き過ぎた資本主義と社会主義の両方を拒否し、労働者の権利を守るカトリック社会主義を提案しました。同様に、AIは現在、雇用と人間の尊厳を脅かしており、フランシスコ法王は、これらの新たな課題を乗り越えるために、教会の倫理的指導力を主張しています。人間の尊厳、正義、労働者の権利を守ることが求められています。

Airweaveは、AIエージェントが任意のアプリケーションをセマンティック検索できるようにするツールです。MCPと互換性があり、あらゆるアプリケーション、データベース、APIとシームレスに接続して、そのコンテンツをエージェントで使用可能な知識に変換します。データが構造化されているかどうかに関係なく、Airweaveはそれを処理可能なエンティティに分割し、データを保存して、RESTとMCPエンドポイントを通じて取得できるようにします。25以上のソースからのデータ同期、エンティティの抽出と変換パイプライン、マルチテナントアーキテクチャ、増分更新、セマンティック検索などの主要な機能を備えています。FastAPI(Python)、PostgreSQLとQdrantデータベースを使用して構築され、Docker ComposeとKubernetesを介して展開できます。

映画『メッセージ』のヘプタポッド語など、フィクションにおける異星語は奇妙ながらも、人間言語と驚くほど似た基本構造を持つ。これは、「可能な言語空間」についての哲学的な考察を促す。真の異星語は、私たちの想像をはるかに超える奇妙さで、人間言語とは全く異なる方法で構成されている可能性がある。この記事では、言語の4つのレベル(記号、構造、意味論、プラグマティクス)を検討し、異星語がそれぞれのレベルでどのように異なる可能性があるかを分析する。これには、非人間の感覚様式(匂い、電気的インパルス)の使用、独自の文法構造の所有、さらには私たちが理解する「意味」という概念の欠如などが含まれる。真に異星語への備えには、人間中心主義を放棄し、言語の可能性を積極的に探求することが必要となる。これは、潜在的な異星人との接触にとってだけでなく、私たち自身の言語と認知能力へのより深い理解にとっても重要だ。

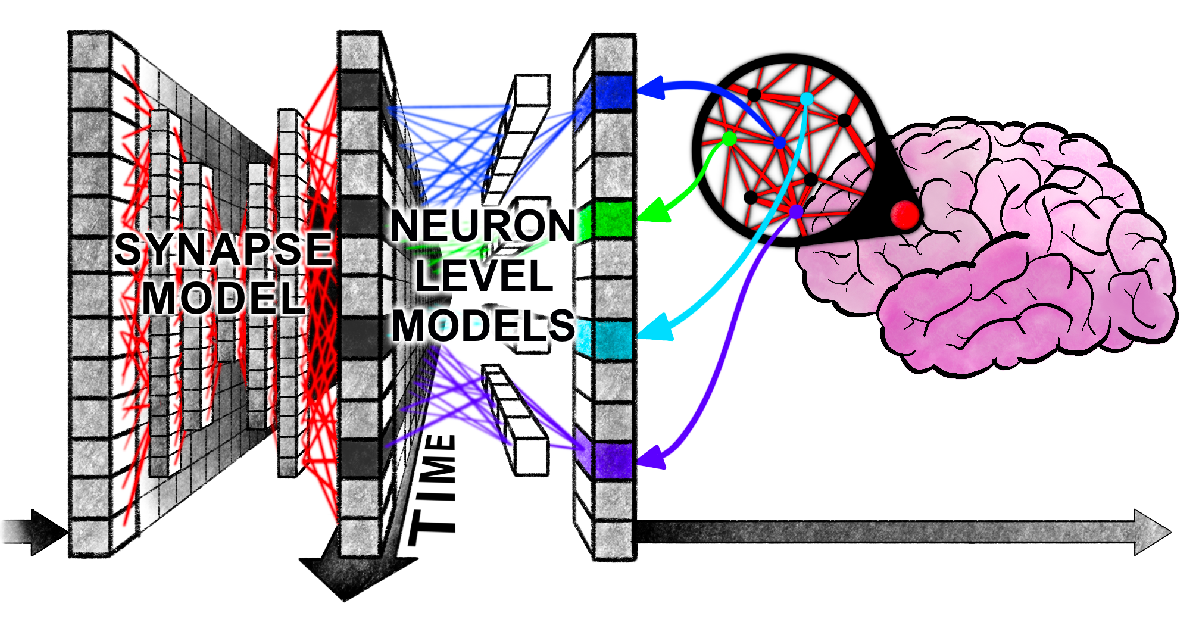

現代のAIシステムは、効率性を優先するために、生物学的脳に見られる神経細胞の同期計算という重要な特性を犠牲にしています。研究者たちは、神経細胞のタイミングを基礎的な要素として組み込み、神経活動の時間的発展をモデル化するために分離された内部次元を使用する、新しいニューラルネットワークアーキテクチャである「連続思考マシン (CTM)」を発表しました。CTMは、神経細胞の同期を潜在的な表現として利用し、画像分類、迷路解法、パリティチェックなどのタスクで優れた能力を示し、推論のために内部世界モデルを構築することさえできます。その適応計算と解釈可能性は、AI研究に新たな道を切り開きます。

AIは、パーソナライズされたニュースフィードから交通管理まで、私たちの生活を静かに変えつつあります。しかし、重要な疑問が生じます。私たちはAIの影響を受けずに生きる権利を持つのでしょうか?この記事では、医療や金融といった不可欠なサービスへのAIの統合によって、AIを拒否することが非常に困難になり、潜在的な排除につながることを主張しています。AIシステムにおけるバイアスは既存の不平等を悪化させ、デジタルデバイドを広げています。ゲーテの魔法使いの弟子を比喩として用いて、著者は制御不能な技術的パワーへの警告を発しています。この記事は、政府、企業、社会が、個人の自由を尊重し、デジタルリテラシーを向上させ、誰もがAIとの関与を選択できるよう、AIガバナンスフレームワークを構築するよう求めています。AIが制御の道具にならないようにするためです。

この記事では、大規模言語モデルにおける自己注意機構の内部動作を深く掘り下げています。著者は、マルチヘッドアテンションとレイヤー化されたメカニズムを分析し、一見単純な行列演算がどのようにして複雑な機能を実現するのかを説明しています。中心となる考え方は、個々のアテンションヘッドは単純ですが、マルチヘッドアテンションとレイヤー化によって、複雑で豊かな表現が構築されるということです。これは、畳み込みニューラルネットワークが層ごとに特徴を抽出していく方法に似ており、最終的には入力シーケンスに対する深い理解を実現します。さらに、この記事では、アテンション機構がRNNモデルの固有の固定長ボトルネック問題をどのように解決するのかを説明し、クエリ、キー、バリュー空間のアテンション機構における役割を例を用いて説明しています。

哲学者デイビッド・チャーマーズは、単純なサーモスタットが意識を持つ可能性があると提案しています。彼はコネクショニストネットワークとサーモスタットを比較し、情報処理における驚くべき類似点を強調しています。これは、特定の基準を受け入れるならば、サーモスタットが基本的な意識体験をモデル化できることを示唆しています。チャーマーズは、複雑さだけでは意識を説明できないと主張しています。高度なAIは意識を模倣しますが、根本的な本質はつかみきれません。彼は、意識を理解するために、コネクショニストモデルを超えて、まだ発見されていないより深い法則を探さなければならないと結論付けています。

Googleの大規模言語モデルGemini 2.5の最近のアップデートにより、安全設定のコントロールが誤って壊れ、以前は許可されていたコンテンツ(性的暴行に関するセンシティブな記述など)がブロックされるようになりました。これにより、Gemini APIに依存するいくつかのアプリケーション、特に性的暴行サバイバーがレポートを作成するのに役立つVOXHELIXや、PTSDや虐待サバイバーのためのジャーナリングアプリInnerPieceなどが機能停止に陥っています。開発者たちは、Googleがモデルを黙って変更したことを批判しており、アプリの誤動作と、ユーザーエクスペリエンスやメンタルヘルスのサポートへの深刻な影響を招いています。Googleはこの問題を認識していますが、明確な説明は提供していません。

この記事は、人間のDNAにどれだけの情報が含まれているかという問題を掘り下げています。単純な計算では約1.5GBになりますが、これは冗長性と圧縮性を無視しています。著者は情報理論の2つの情報定義、すなわち記憶容量とコルモゴロフ複雑性を検討し、それらをDNAへの適用を比較しています。最終的に、DNAの真の情報量をよりよく反映するものとして、新しい定義である「表現型コルモゴロフ複雑性」が提案されていますが、その正確な計算は依然として困難です。

デューク大学による新たな研究が、AIの二面性を明らかにしました。生成AIツールは生産性を向上させる一方で、ひそかに専門家の評判を損なう可能性があるのです。PNASに掲載された研究によると、ChatGPTなどのAIツールを使用する従業員は、同僚や上司から能力が低い、やる気のないと評価されがちです。このネガティブな評価は特定の人口統計に限定されず、AI使用に対する社会的スティグマは広範囲にわたります。4つの実験がこのバイアスを確認し、生産性向上があってもAI導入の社会的コストを浮き彫りにしました。