거대 언어 모델의 윤리적 딜레마: 내가 더 이상 사용하지 않는 이유

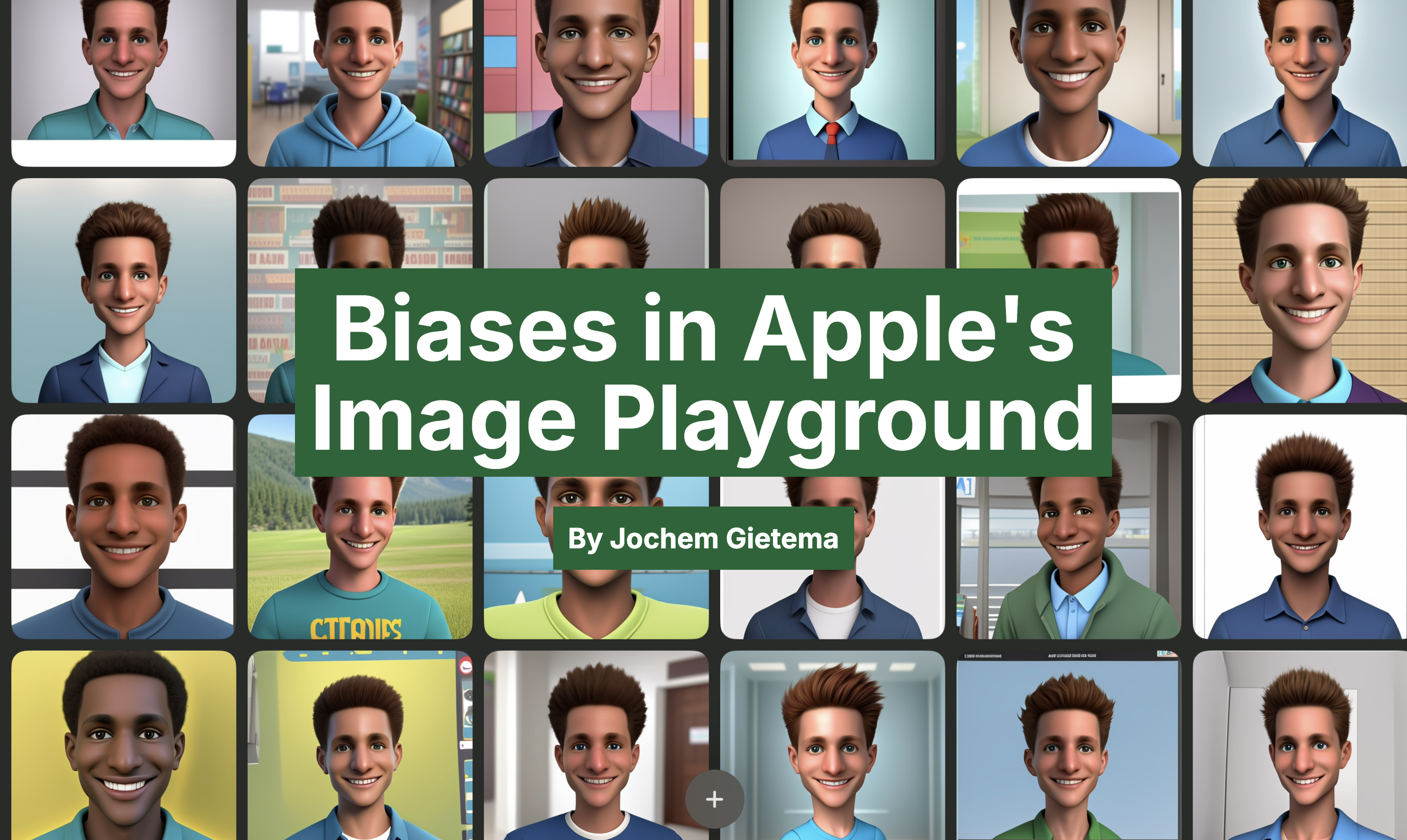

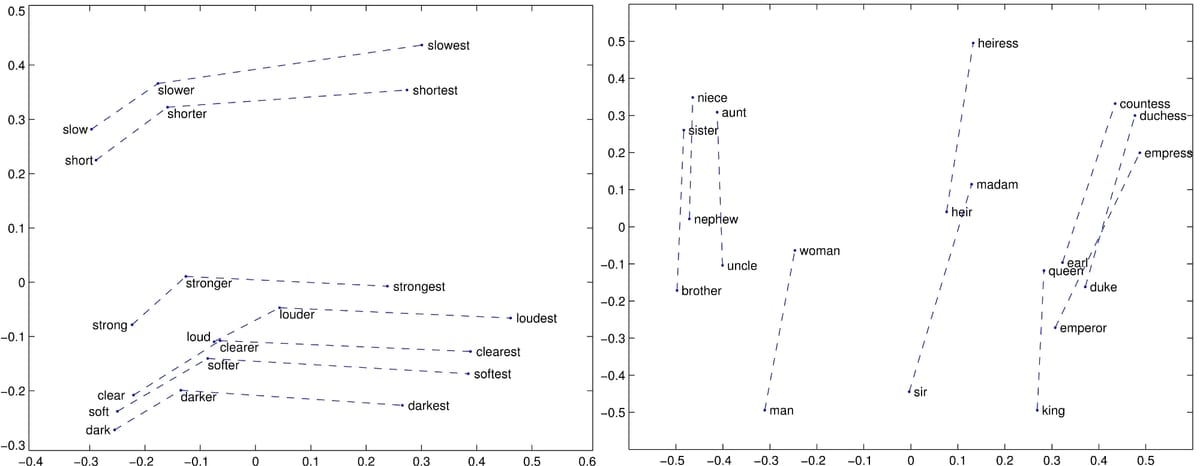

이 글에서는 거대 언어 모델(LLM)을 둘러싼 윤리적 우려를 자세히 살펴보고 저자가 더 이상 LLM을 사용하지 않는 이유를 설명합니다. 저자는 에너지 소비, 훈련 데이터 소스, 일자리 대체, 부정확한 정보와 편향, 그리고 권력 집중이라는 다섯 가지 주요 문제를 탐구합니다. 높은 에너지 소비, 훈련 데이터와 관련된 개인 정보 보호 문제, 일자리 대체 가능성, 편향과 부정확성으로 인한 잘못된 정보의 위험, 그리고 소수의 거대 기술 기업으로의 권력 집중은 중요한 윤리적 문제로 강조됩니다. 저자는 이러한 윤리적 우려를 적극적으로 해결하지 않고 LLM을 사용하는 것은 비윤리적이라고 주장합니다.