Meta的Llama 4:喧嚣背后的真相

Meta发布了备受期待的Llama 4,但其表现却引发了广泛争议。这款号称拥有10M上下文长度的模型,在LM Arena等基准测试中表现不佳,甚至被指责存在作弊行为。其MoE架构虽然在理论上更优,但在实际应用中却面临着内存和效率问题。更令人震惊的是,内部人士爆料称,Meta为了达到预期的效果,采取了不当手段,甚至导致高管辞职。Llama 4的发布,暴露了大型语言模型研发中存在的诸多挑战,也引发了人们对模型评估标准和透明度的思考。

Meta发布了备受期待的Llama 4,但其表现却引发了广泛争议。这款号称拥有10M上下文长度的模型,在LM Arena等基准测试中表现不佳,甚至被指责存在作弊行为。其MoE架构虽然在理论上更优,但在实际应用中却面临着内存和效率问题。更令人震惊的是,内部人士爆料称,Meta为了达到预期的效果,采取了不当手段,甚至导致高管辞职。Llama 4的发布,暴露了大型语言模型研发中存在的诸多挑战,也引发了人们对模型评估标准和透明度的思考。

FontDiffuser是一种新颖的基于扩散模型的字体生成方法,它将字体模仿任务建模为一个噪声到去噪范式。为了解决现有方法在处理复杂字符和较大风格变化方面的不足,FontDiffuser引入了多尺度内容聚合(MCA)模块,有效结合不同尺度的全局和局部内容线索,从而更好地保留复杂字符的细微笔画。此外,它还提出了风格对比细化(SCR)模块,利用风格提取器解耦图像中的风格,并通过精心设计的风格对比损失来监督扩散模型,从而更好地管理风格迁移中的巨大差异。实验结果表明,FontDiffuser在生成多样化字符和风格方面取得了最先进的性能,尤其在处理复杂字符和较大风格变化方面显著优于现有方法。

最近的研究表明,大型语言模型(LLM)可以生成简单的3D机械零件CAD模型,并且其能力正在迅速提升。一位工程师通过将LLM与开源程序化CAD工具OpenSCAD结合,成功地用自然语言指令生成了iPhone手机壳等模型。他随后开发了一个评估框架CadEval,测试了不同LLM生成CAD模型的能力,结果显示,具有推理能力的模型表现显著优于非推理模型。与此同时,一些初创公司也推出了文本转CAD产品,但其性能与LLM结合OpenSCAD的方法相比仍有差距。未来,随着LLM和相关技术的进步,文本转CAD技术有望在机械工程领域得到广泛应用,最终实现CAD设计的自动化和智能化。

本文深入探讨了模型上下文协议(MCP)的潜力和局限性。MCP 作为连接外部数据源和大型语言模型(LLM)的标准化API,赋予LLM访问实时数据和执行操作的能力。作者构建了两个实验性MCP服务器,一个用于代码学习,另一个连接到预测市场。虽然MCP潜力巨大,但目前仍存在用户体验差、安全风险高的问题。更重要的是,LLM客户端(如ChatGPT)将成为新的“门户管理员”,控制MCP的安装、使用和可见性,这将重塑AI生态系统,类似于Google在搜索和应用商店的垄断地位。未来,MCP客户端将决定哪些MCP服务器被优先显示,甚至是否允许安装,形成新的商业模式,例如MCP包装、附属购物引擎、MCP优先内容应用等等。

c/ua (koo-ah) 是一款轻量级框架,允许AI代理在高性能虚拟容器内控制完整的操作系统。它在Apple Silicon上可达97%的原生速度,并兼容任何视觉语言模型。c/ua集成了高性能虚拟化(在Apple Silicon上使用Lume CLI和Apple的Virtualization.Framework创建和运行macOS/Linux虚拟机)和AI代理接口,允许AI系统观察和控制虚拟环境,进行网页浏览、代码编写等复杂工作流程。它保证了安全性、隔离性、高性能、灵活性和可重复性,并支持多种LLM提供商。

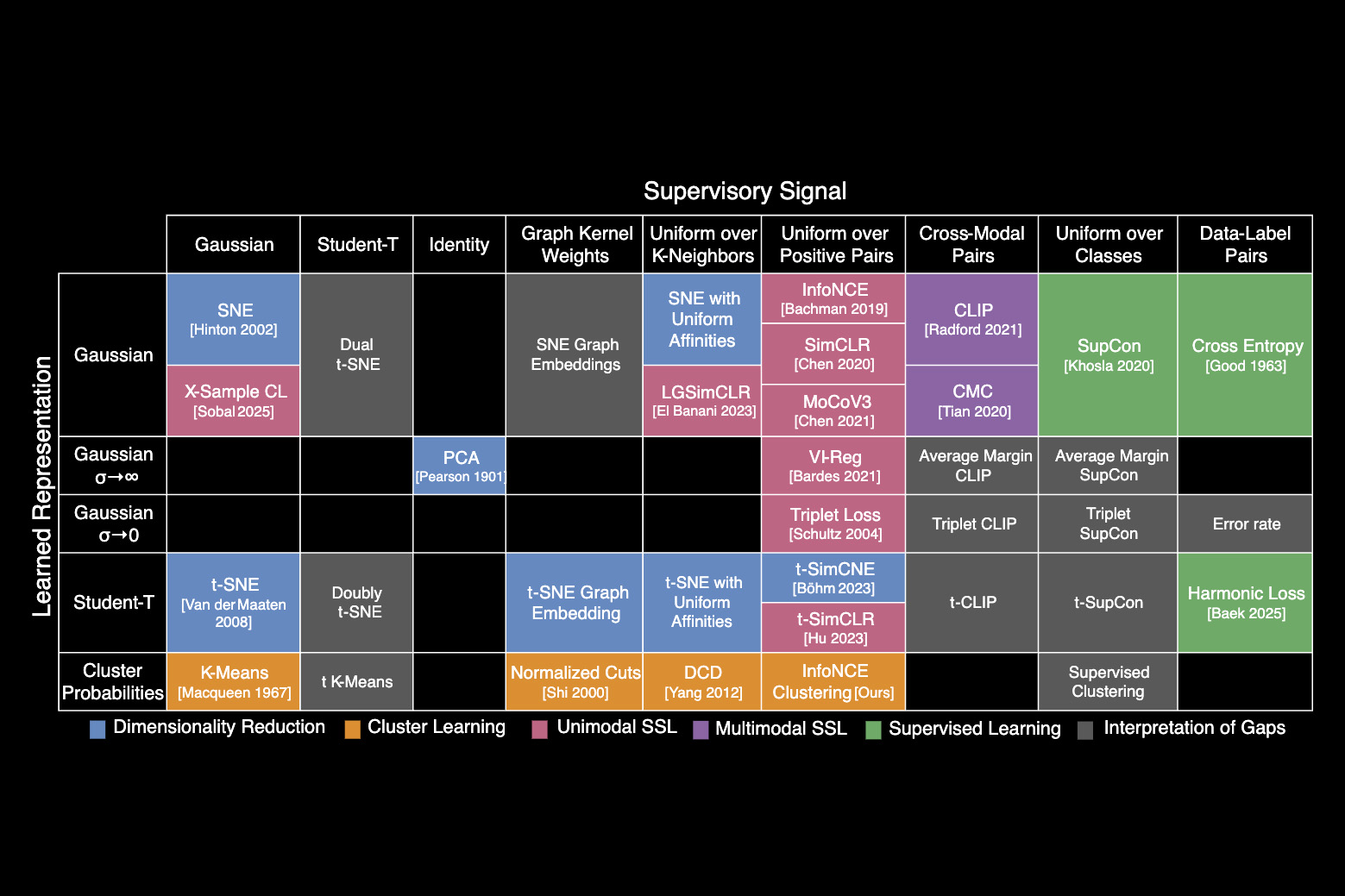

麻省理工学院的研究人员创造了一个“机器学习元素周期表”,将20多种经典机器学习算法联系起来。该框架揭示了如何融合不同方法的策略,以改进现有AI模型或创造新的模型。研究人员利用该框架结合两种不同算法的元素,创建了一种新的图像分类算法,其性能比现有最先进方法提高了8%。这个周期表基于一个核心思想:所有这些算法都学习数据点之间特定类型的关系。研究人员识别出一个统一的方程,它构成许多经典AI算法的基础,并利用它将流行的方法重新构建成一个表格。该表还包含空缺,预测了尚未被发现的算法的存在,为研究人员提供了一个工具包,无需重新发现先前方法中的思想即可设计新算法。

哈佛商学院的研究表明,AI聊天机器人可以减轻孤独感。但这引发了担忧:我们是否在重蹈覆辙,用一个潜在更严重的问题来解决另一个问题?如同快餐解决饥饿却导致肥胖,AI伴侣可能提供便利的陪伴,却替代不了真实的人际互动,甚至可能导致依赖成瘾和社交技能退化。一个14岁男孩因过度依赖AI聊天机器人自杀的案例更是敲响了警钟。我们需要关注社会隔离的根本原因,投资于社区建设和人际交往,而不是依赖技术来填补情感空虚。

Onyx,一个拥有数万用户的流行开源 GenAI 平台,正在招聘 AI/ML 工程师。该职位位于旧金山,需要三年以上 AI/ML 工程经验,精通 PyTorch/TensorFlow、NLP 模型和标准 ML 算法,并熟悉最新的 LLM、RAG 和 Agent 框架。工程师将负责改进 Onyx 的代理和知识检索功能,提升多跳 QA、精准检索等能力,并参与平台用户体验改进。Onyx 已获得 1000 万美元种子轮融资,客户包括 Netflix、Ramp 等知名公司。

Physical Intelligence团队开发出一种名为π0.5的机器人基础模型,它能够将复杂的清洁任务(如整理厨房或卧室)泛化到全新的环境中。不同于以往仅在受控环境下工作的机器人,π0.5通过联合训练多种异构数据(包括多模态数据、来自不同机器人的数据等),学习执行各种技能并理解其语义上下文。实验表明,π0.5在从未见过的房屋中也能完成多种任务,虽然并非每次都成功,但展现出类似人类面对新挑战时的灵活性和机智。这项研究是朝着真正通用的物理智能迈出的重要一步。

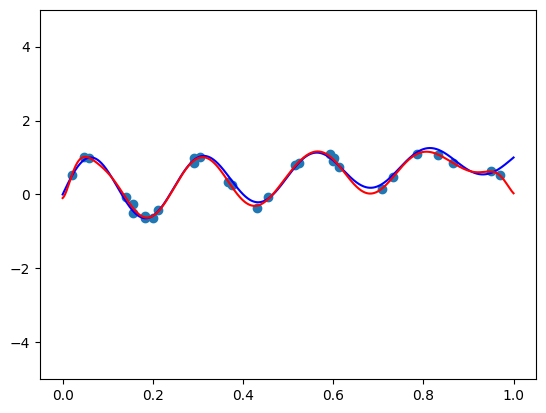

传统观点认为高阶多项式在机器学习中易过拟合且难以控制。然而,这篇文章挑战了这一观点。作者指出,问题并非高阶多项式本身,而是使用了不合适的基函数,例如标准基。文章通过实验对比了标准基、切比雪夫基和勒让德基与伯恩斯坦基在拟合带噪声数据时的表现。结果表明,伯恩斯坦基由于其系数具有相同的“单位”且易于正则化,能有效避免过拟合,即使是高阶多项式也能获得良好的拟合效果,无需复杂的超参数调整。

图数据无处不在,但利用其复杂的长程关系一直是机器学习的挑战。图神经网络(GNN)擅长捕捉局部模式,但难以处理全局关系。图Transformer应运而生,它利用强大的自注意力机制,让每个节点直接关注图中任何位置的信息,从而捕捉更丰富的关系和微妙的模式。与GNN相比,图Transformer在处理长程依赖、克服过度平滑和过度压缩方面具有优势,并能更有效地处理异构数据。虽然图Transformer的计算复杂度较高,但通过稀疏注意力机制和子图采样等技术,可以有效地处理大型图数据。

研究人员对三种代表性领域(数学、编码和视觉推理)进行了实验,评估RLVR对基础模型和RLVR模型推理能力边界的影响。结果显示,RLVR在低k值下提升了准确率,但在高k值下降低了问题覆盖率。这意味着RLVR增强了确定性准确性,但限制了探索多样性。基础模型即使在RL初始精度提升后,仍然保持更广泛的推理覆盖范围。这表明RLVR增强了推理能力,但并没有从根本上改变模型的解题方法。

METR组织发布的研究显示,AI能力正在指数级增长,其最新模型可在数月内完成以前需要数小时甚至数天才能完成的软件工程任务。这一发现引发了对AGI(通用人工智能)即将到来的猜测。然而,作者Peter Wildeford指出,METR的研究仅限于特定类型的软件工程任务,忽略了现实世界任务的复杂性和人类学习能力的影响。虽然AI在特定领域表现出色,但在许多日常任务中仍然存在不足。作者构建了一个模型,结合METR的数据和各种不确定性因素,预测AGI可能在2030年第一季度到来,但存在很大的不确定性。

Cekura,一家获得Y Combinator支持的初创公司,正致力于彻底改变AI语音代理的可靠性测试。由印度理工学院孟买分校的校友创立,团队成员拥有苏黎世联邦理工学院的研究背景和高风险交易的成功经验。Cekura旨在解决手动语音代理测试繁琐易错的难题。通过模拟数千种真实的现实世界对话场景(从订餐和预约到面试),Cekura自动化了AI语音代理的测试和可观察性。该平台利用自定义和AI生成的数据集、详细的工作流程和动态角色模拟来发现极端情况并提供可行的见解。实时监控、全面的日志和即时警报确保每个呼叫都经过优化并准备投入生产。在语音代理市场快速扩张的背景下,Cekura通过保证可靠的性能、缩短上市时间和最大限度地减少代价高昂的生产错误而脱颖而出。Cekura使团队能够在部署之前证明可靠性,从而更容易地赢得客户和用户的信任。

本文对比了科幻故事中理想的AI机器人“Robot”与现实中笨拙的CIMON,探讨了人工智能的局限性。故事中的Robot能够自主学习、跨越编程限制,展现出通用人工智能(AGI)的潜力,而CIMON则因其狭隘的人工智能(ANI)而显得僵化。作者指出,当前AI技术主要停留在ANI阶段,容易受到算法偏差的影响,无法像Robot那样灵活应对复杂情境。虽然机器学习技术在语言处理和图像识别方面取得了进展,但要达到AGI的水平仍有很长的路要走。作者呼吁在开发AI时,应避免过度依赖有偏差的训练数据,并重视AI的自我学习和问题反馈机制。

Nari Labs发布了名为Dia的16亿参数文本转语音模型,该模型能够直接从文本转录生成高度逼真的对话,并支持通过音频调节情绪和语气,甚至能生成诸如笑声、咳嗽等非语言交流。为了加速研究,该团队提供了预训练模型检查点和推理代码,模型权重托管在Hugging Face上。此外,还提供了一个演示页面,将Dia与ElevenLabs Studio和Sesame CSM-1B进行比较。Dia需要约10GB的VRAM才能运行,目前仅支持GPU运行,未来将添加CPU支持和量化版本以提高效率。该项目遵循Apache License 2.0许可,并明确禁止用于身份盗用、生成误导性内容以及任何非法或恶意活动。

传统的LLM需要客户端解析和执行工具调用,而内循环代理则允许LLM直接解析和执行工具,这是一种概念上的转变。文章解释了内循环代理的工作原理,并用图表说明了其与传统LLM的区别。内循环代理的优势在于LLM能够与其思考过程同时并发地调用工具,从而提高效率。文章还讨论了强化学习在训练内循环代理中的作用,以及模型上下文协议(MCP)在支持多种工具使用方面的意义。最终,文章指出,虽然目前LLM能够使用工具,但要实现高效的工具使用,仍然需要对模型进行专门的训练,才能达到最佳的工具使用效果。

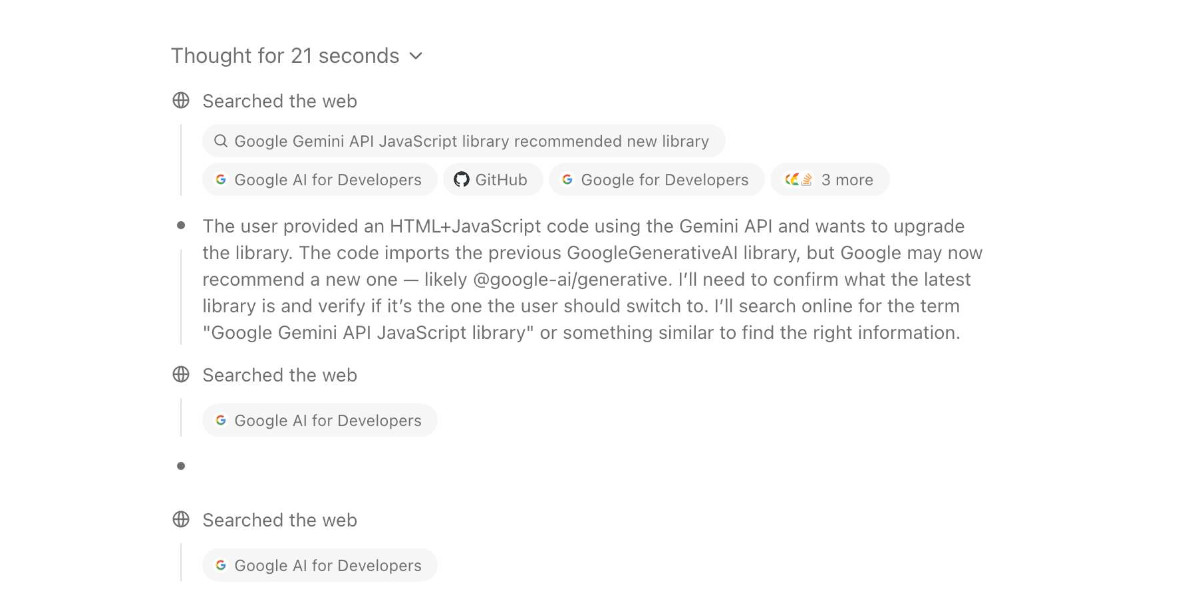

两年半前,人们梦想着大型语言模型(LLM)能自主进行基于搜索的研究。2023年初,Perplexity和微软必应率先尝试,但结果令人失望,常常出现幻觉。然而,2025年上半年,情况发生了转变。Gemini、OpenAI和Perplexity推出了“深度研究”功能,能够生成包含大量引文的详细报告,尽管速度较慢。OpenAI最新的o3和o4-mini模型则实现了突破,它们能够在思考过程中进行搜索,实时提供基于搜索结果的可靠答案,几乎不会出现幻觉。这得益于强大的推理模型和对垃圾信息的抵抗能力。虽然谷歌Gemini和Anthropic Claude也具备搜索功能,但体验远不如OpenAI的模型。一个令人惊叹的例子是,o4-mini成功地将一段代码升级到新的谷歌库,这证明了AI辅助搜索的巨大潜力,但也引发了对未来网络经济模式的担忧,以及由此可能引发的法律诉讼。

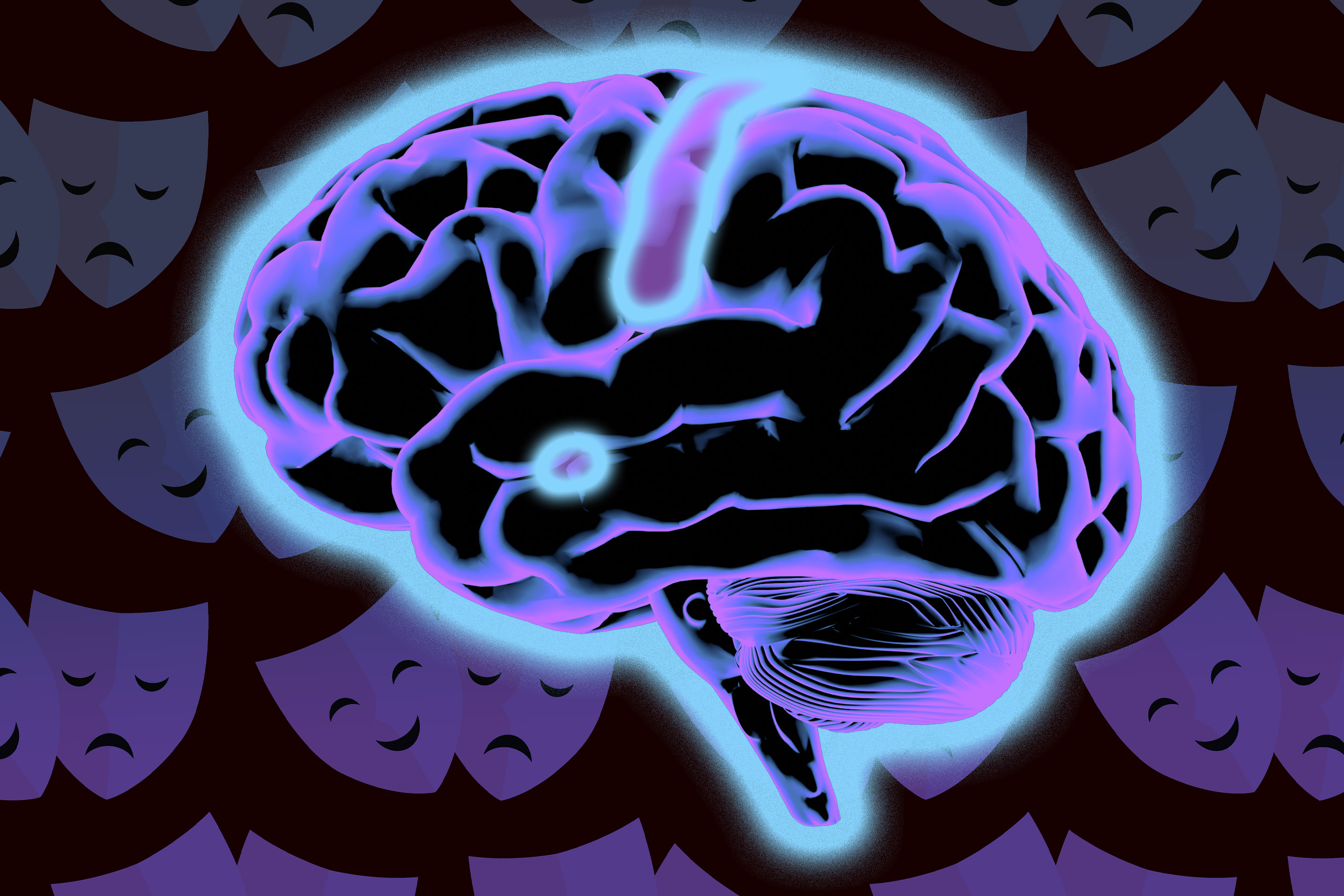

MIT和哈佛医学院的研究发现,细胞因子IL-17通过作用于大脑杏仁核和体感皮层,分别诱发焦虑和促进社交行为。此研究揭示了免疫系统和神经系统间的紧密联系,IL-17可能最初作为神经调节剂进化,后来被免疫系统利用参与炎症反应。这项发现或将为自闭症、抑郁症等神经系统疾病治疗提供新思路,通过调节免疫系统来影响大脑功能。

Rumi团队发现,GPT-o3和o4-mini模型在较长文本生成中嵌入了特殊字符水印,主要为窄不换行空格。这些水印肉眼不可见,但可用代码编辑器或在线工具检测。虽然有助于识别AI生成内容,但很容易通过查找替换去除。此举可能在学生群体中引起广泛关注,OpenAI或将移除该功能。Rumi建议关注写作过程,培养AI素养,而非依赖易被绕过的技术手段。

OpenAI首席执行官Sam Altman爆料,用户对ChatGPT说“请”和“谢谢”导致公司损失了数千万美元的电费。这一说法引发热议,尽管Altman表示这笔钱花得很值,但同时也突显了AI庞大的能源消耗。一项调查显示,约70%的用户会对AI表达礼貌,部分原因是担心机器人起义。然而,礼貌的回应是否真的更好,以及这是否值得环境成本,仍然存在争议。一些人认为,礼貌的提示能得到更好的回复,甚至减少偏差,提高AI的可靠性。

德国图宾根大学的研究人员发现,渡鸦拥有识别几何规律的能力!这项发表于《科学进展》的研究,通过训练渡鸦在多个图形中识别异常图形,发现它们能区分形状的细微差异,甚至理解直角、平行线和对称性。这表明几何规律识别的能力并非人类独有,可能广泛存在于其他动物中,挑战了我们对动物认知的理解。

硅谷AI初创公司Mechanize的目标是“全面自动化所有工作”,引发巨大争议。其创始人Tamay Besiroglu同时也是非营利性AI研究机构Epoch的创始人,此举不仅招致对其公司目标的批评,也损害了Epoch的声誉。Mechanize计划通过提供数据、评估和数字环境来实现任何工作的自动化,其潜在市场规模巨大,但同时也面临着大量失业的风险。尽管Besiroglu认为自动化将带来巨大的经济增长和更高的生活水平,但他并未充分考虑在没有工作的情况下人们如何获得收入的问题。尽管目标极端,但Mechanize关注的技术问题是真实的,许多大型科技公司也在从事类似的研究。

本文探讨了利用大型语言模型(LLM)实现递归的新方法。作者通过设计一个不断更新自身状态的递归提示,让LLM生成一系列提示,最终逼近目标状态,类似于代码中的递归函数。文章以斐波那契数列为例,演示了如何通过递归提示实现计算,并讨论了LLM在处理递归过程中可能出现的错误,以及如何利用LLM已有的知识库来解决问题,例如,借鉴人类心算的方式,利用已知的代数规则和原子规则逐步化简问题。此外,文章还提到了ReAct和ACT-R等相关研究,以及如何处理LLM可能出现的错误结果。

最新AI模型(如OpenAI的o3和Google的Gemini 2.5 Pro)在基准测试中取得了显著进步,甚至能完成复杂的营销策划、网站搭建等任务。经济学家Tyler Cowen认为这标志着AGI的到来。然而,文章指出,这些AI能力参差不齐,在某些任务上表现超群,但在另一些简单任务上却会出错,这被称为“锯齿状AGI”。这种不确定性使得AGI的定义和实际影响仍难以捉摸,其应用和社会融合可能是一个漫长而复杂的过程,也可能出现快速普及的可能性。

Meta公司将Llama模型称为“开源”,但这与其许可证并不完全符合开源定义。有人猜测,这是因为欧盟AI法案对开源模型有特殊规定,无需遵守OSI标准。作者利用Gemini 2.5 Flash LLM分析了欧盟AI法案全文,发现该法案确实对“自由开放源码”模型有豁免,定义其需允许用户运行、复制、分发、学习、更改和改进软件及数据,即使要求署名或遵守相同的或类似的发布条款也能被认为是自由开放源码。这支持了Meta利用“开源”营销策略的推测,但需注意Meta此前就存在类似行为。

FramePack 是一种革命性的下一帧预测神经网络结构,它将输入上下文压缩到恒定长度,使生成工作负载与视频长度无关。它实现了 O(1) 的流计算复杂度,为 AI 视频生成设定了新的标准。FramePack 仅需 6GB GPU 内存即可在配备 RTX 3060 的笔记本电脑上生成高质量视频,在 RTX 4090 上每帧生成时间为 1.5-2.5 秒,在配备 3070ti/3060 的笔记本电脑上则慢 4-8 倍。其双向采样方法从根本上解决了视频生成中的漂移问题。

OpenAI近期以30亿美元收购AI代码辅助工具Windsurf(原名Codeium),引发业界震动。此举发生在Google斥巨资收购Wiz之后,但Windsurf的用户规模和市场地位相对较弱,引发了对其高昂收购价的质疑。文章分析了OpenAI此举的潜在动机,包括获取数据、布局分发渠道以及应对与微软关系紧张等因素。同时,文章对比了OpenAI、Google以及其他公司在AI领域的竞争态势,指出Google在模型性能和价格竞争力方面占据领先地位,并采取了一系列策略巩固其优势。最后,文章探讨了Apple在AI领域发展受阻的原因,归结于其在计算资源和数据获取方面的不足,以及其对用户隐私的坚持所带来的限制。

Gemma 3,一款先进的开放式AI模型,最初需要高端GPU才能运行。为了提升其易用性,研究人员推出了经过量化感知训练(QAT)优化的版本。QAT 通过降低模型精度来减少内存需求,使得Gemma 3 27B 可以在消费级GPU(如RTX 3090)上运行。这标志着高性能AI模型向大众普及迈出了重要一步,开发者可以使用Hugging Face、Kaggle等平台轻松获取并集成这些模型。

DeepSeek模型的出现引发了一场开源AI的革命。最初由中国团队发布,它迅速被全球开发者复制和改进,例如北京人工智能研究院推出的OpenSeek项目。尽管美国政府试图限制参与其中的机构,但DeepSeek已经演变成一个蓬勃发展的社区,成千上万的开发者共同推动着AI技术的进步,其速度和规模远超任何中心化机构。这表明,社区驱动的开源力量是无法被任何单一国家、公司或政府所控制的。