苹果发布超快视觉语言模型FastVLM:兼顾精度与效率

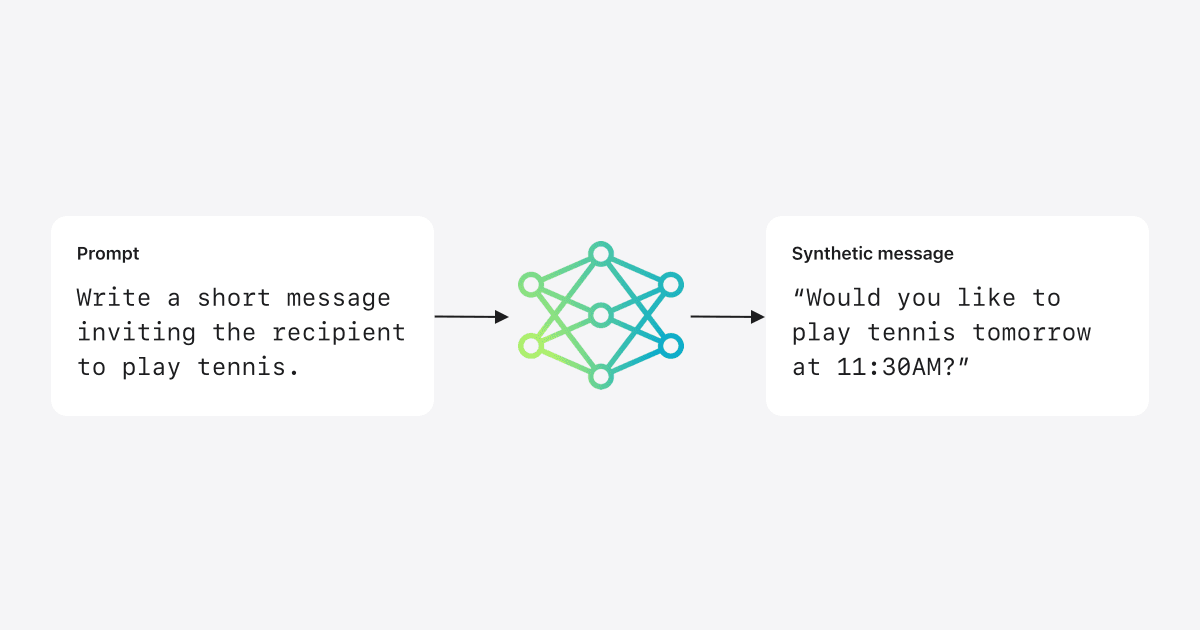

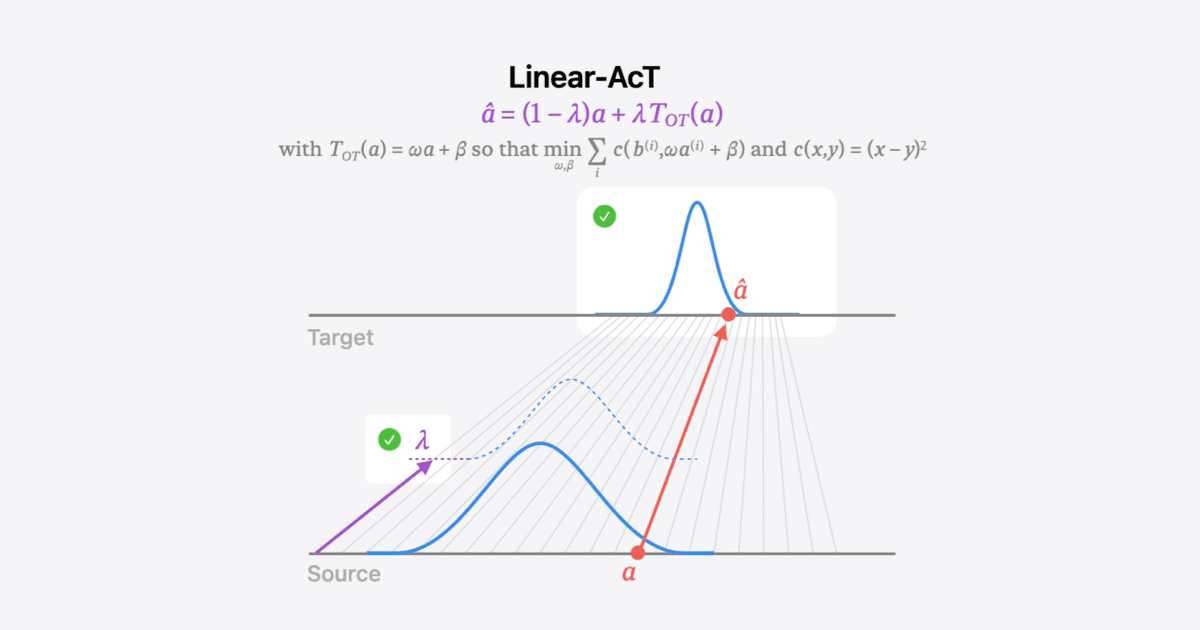

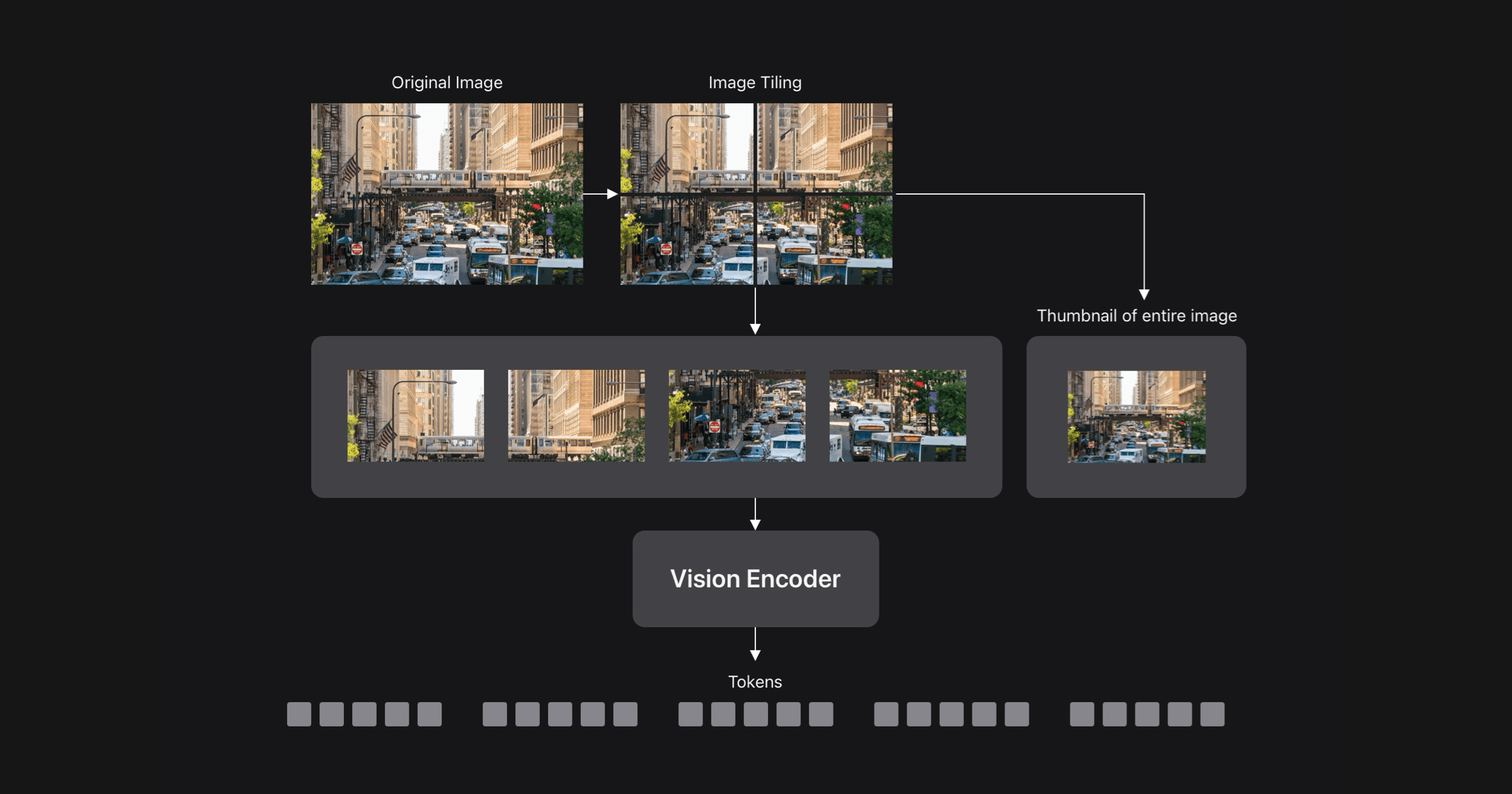

苹果机器学习团队在CVPR 2025上发表论文,介绍了一种新型视觉语言模型FastVLM。该模型通过采用针对高分辨率图像设计的混合架构视觉编码器FastViTHD,显著提升了精度和效率的平衡。FastVLM在处理高分辨率图像时速度更快,精度更高,并支持在iOS和macOS设备上运行,为实时应用和隐私保护的AI体验提供了可能。其核心在于FastViTHD编码器,它生成的视觉token质量更高,数量更少,从而加快了LLM的预填充速度。与现有方法相比,FastVLM在准确性和效率方面均有显著提升,并提供了一个基于MLX的iOS/macOS演示应用程序。

阅读更多