大規模言語モデルの倫理的ジレンマ:私がそれらを使うのをやめた理由

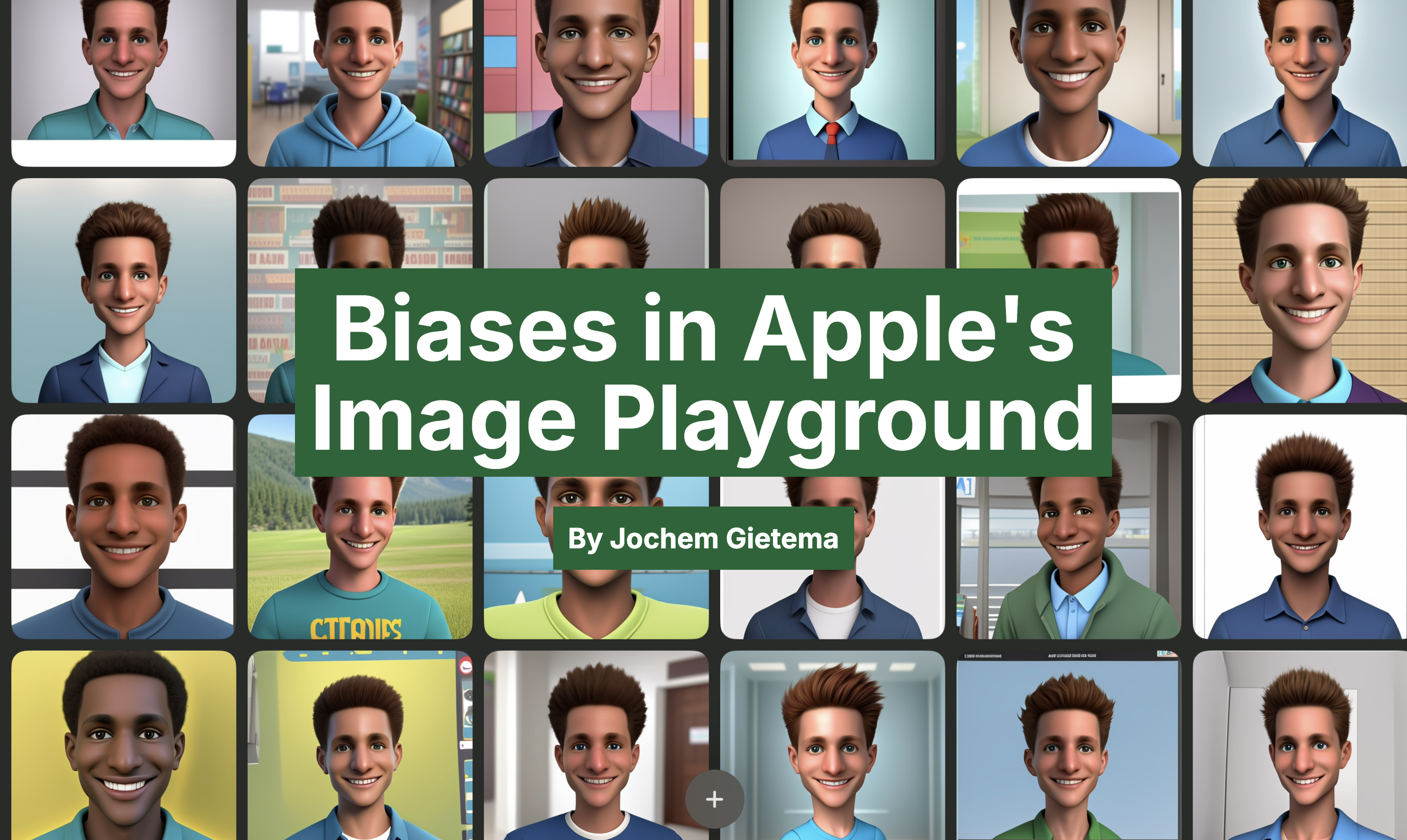

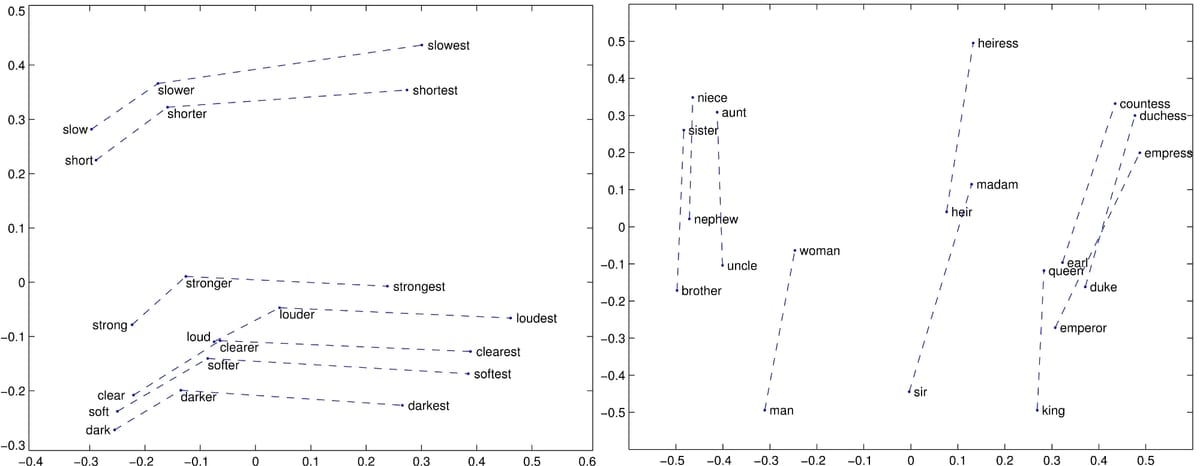

この記事では、大規模言語モデル(LLM)を取り巻く倫理的な懸念を掘り下げ、著者がそれらを使用しなくなった理由を説明しています。著者は、エネルギー消費、トレーニングデータのソース、雇用の代替、不正確な情報とバイアス、そして権力の集中という5つの主要な問題を探っています。高いエネルギー消費、トレーニングデータに関するプライバシーへの懸念、雇用の代替の可能性、バイアスと不正確さによる誤報のリスク、そして少数の巨大テクノロジー企業への権力の集中は、重要な倫理的問題として強調されています。著者は、これらの倫理的な懸念に積極的に取り組まずにLLMを使用することは非倫理的であると主張しています。