Viéses na Tomada de Decisões de LLMs: Um Problema Grave

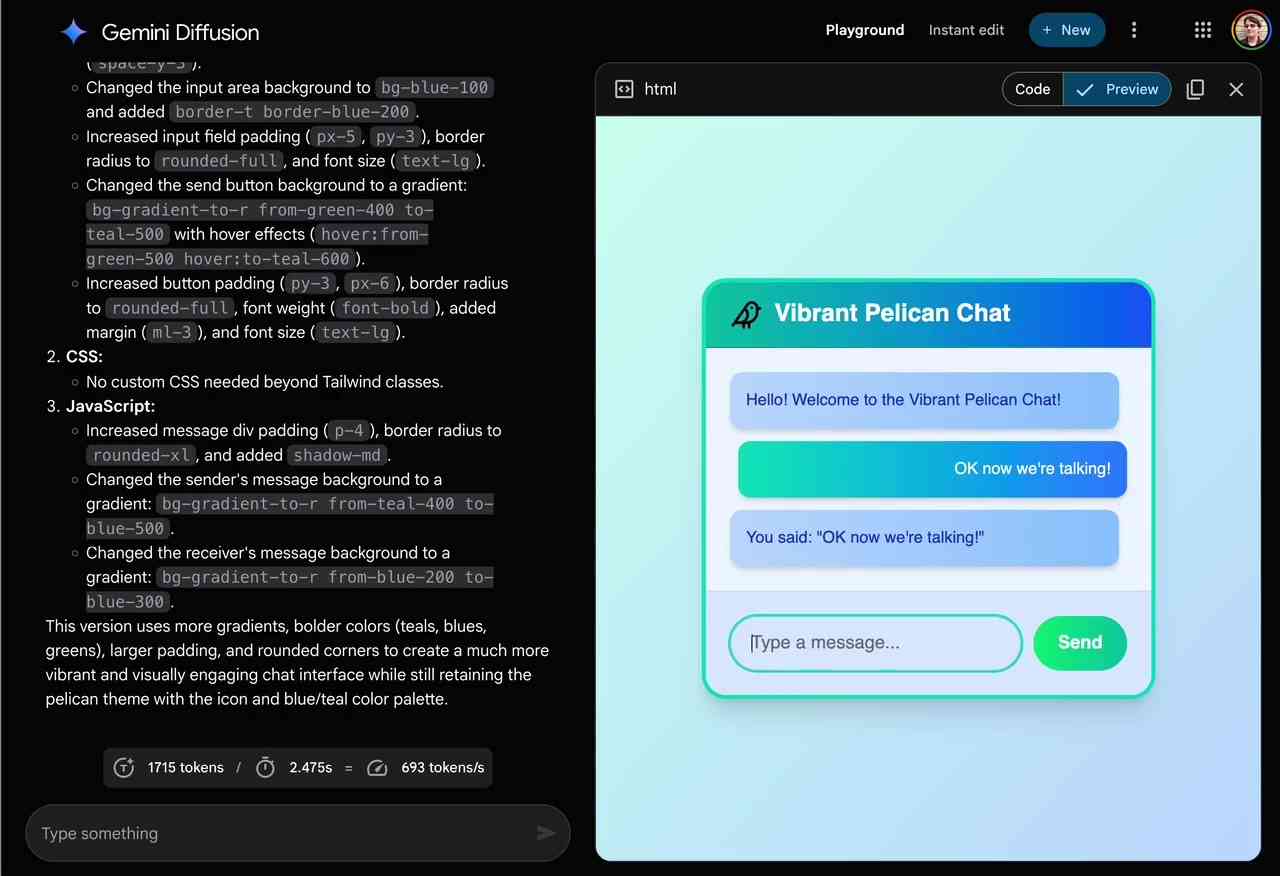

Modelos de Linguagem Grandes (LLMs) estão sendo cada vez mais usados em áreas sensíveis como contratação, saúde e direito, mas seus vieses inerentes nos processos de tomada de decisão são uma preocupação séria. Pesquisas revelam que as saídas de LLM são suscetíveis à engenharia de prompts, à formulação de perguntas e ao design de rótulos, exibindo vieses cognitivos semelhantes aos humanos, como viés posicional, efeitos de enquadramento e viés de ancoragem. O artigo usa dados experimentais para demonstrar esses vieses e propõe estratégias de mitigação, incluindo neutralizar rótulos, variar a ordem, validar prompts, otimizar a mecânica de pontuação, adotar metodologias de classificação mais robustas, projetar e testar esquemas de classificação sob estresse, selecionar e diversificar estrategicamente o portfólio de modelos, usar temperatura e repetições para lidar com a variância, não o viés sistemático, avaliar criticamente os padrões humanos e abordar o consenso/conjuntos com cautela. Em última análise, o artigo enfatiza a necessidade crucial de entender e mitigar os vieses de LLM em aplicações de alto risco para garantir decisões justas e confiáveis.