نموذج الذكاء الاصطناعي مفتوح المصدر DeepSeek R1 يتحدى OpenAI: الكفاءة تنتصر

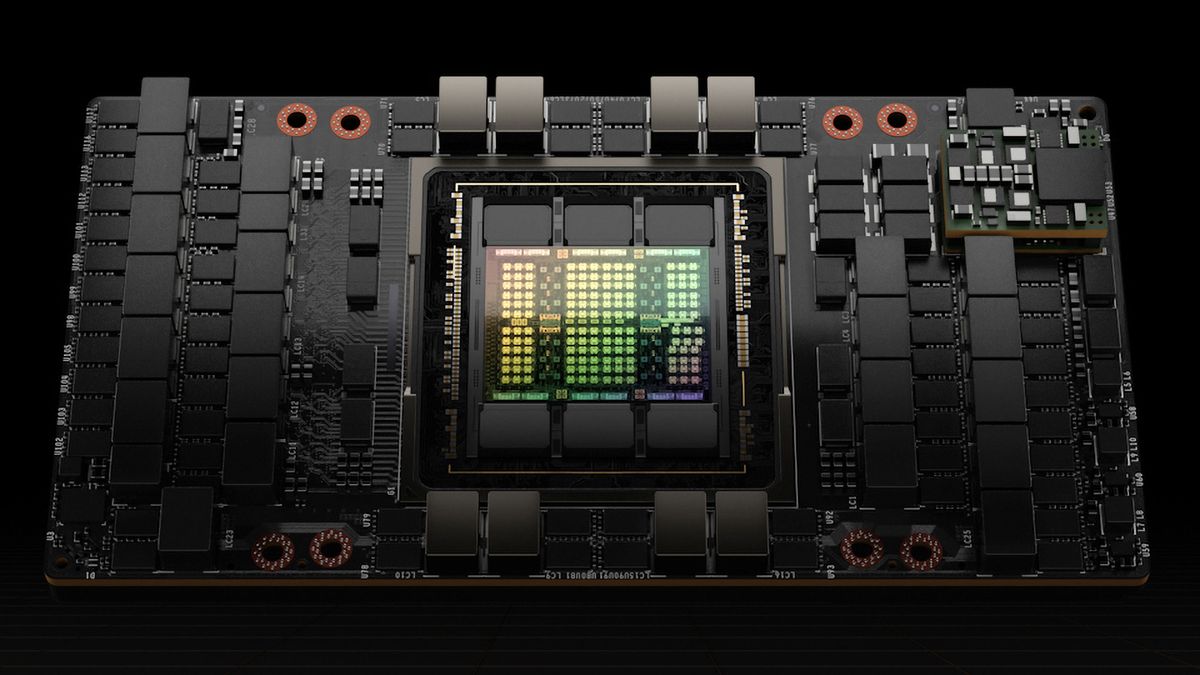

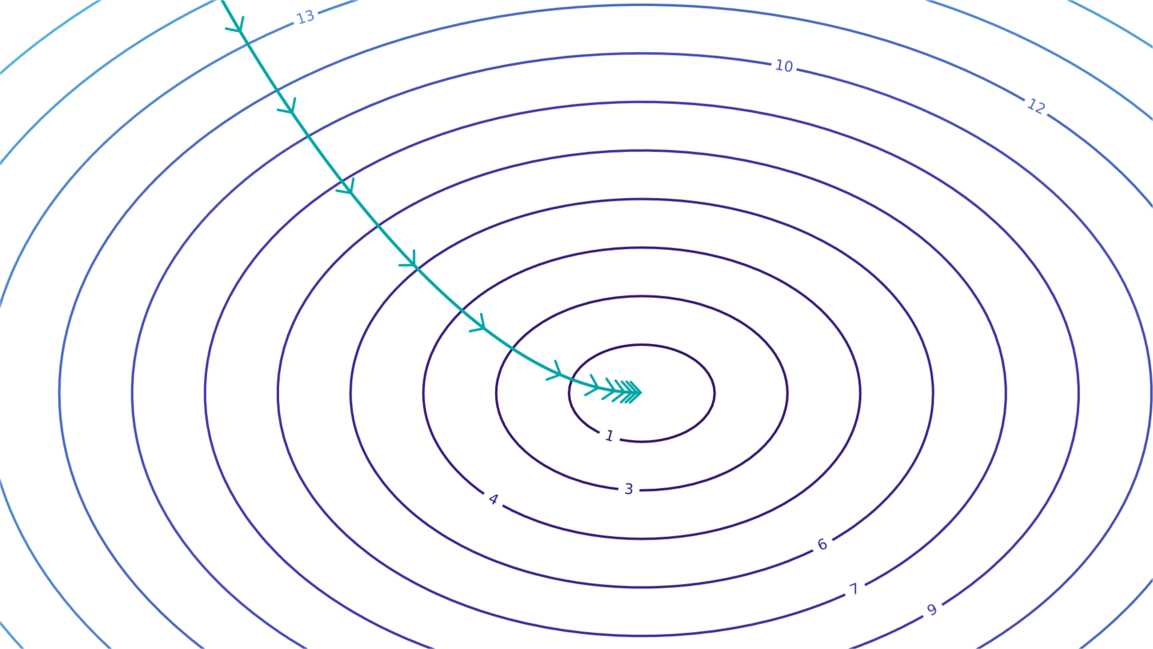

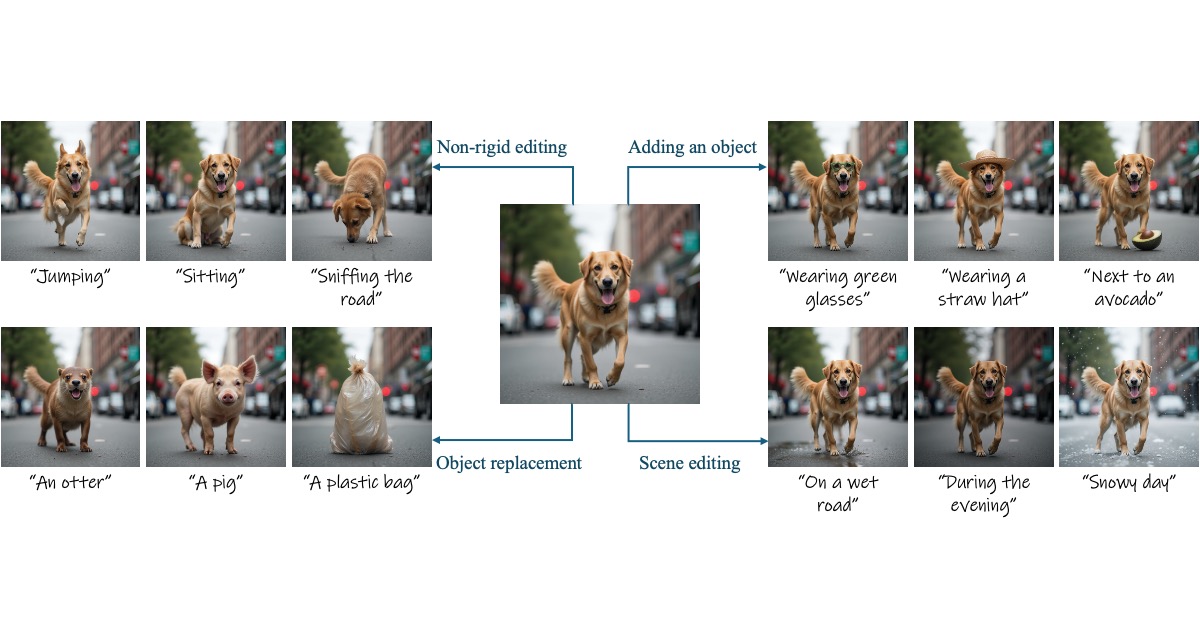

أطلق مختبر الذكاء الاصطناعي الصيني DeepSeek نموذج الاستدلال الخاص به R1 مفتوح المصدر، والذي يقدم أداءً مماثلاً لنموذج o1 من OpenAI، لكنه تم تدريبه بتكلفة أقل بكثير على أجهزة أدنى مستوى. لم يكن قرار DeepSeek باعتماد المصدر المفتوح بسبب التضحية بالأرباح، بل لتجاوز العقبات الجيوسياسية لدخول الأسواق الغربية، والاستفادة من أساليب التدريب الفعالة التي تستخدمها. تحلّل المقالة الاتجاه المتزايد لأنماط المصدر المفتوح ومزاياها في البنية التحتية، مؤكدةً أن نماذج المصدر المفتوح تقضم حصص سوق عمالقة مثل OpenAI. ومع ذلك، تحتفظ OpenAI بمكانتها التنافسية بفضل ريادتها الهائلة ومواردها الضخمة.