LLM 0.26: Große Sprachmodelle erhalten Terminal-Tools

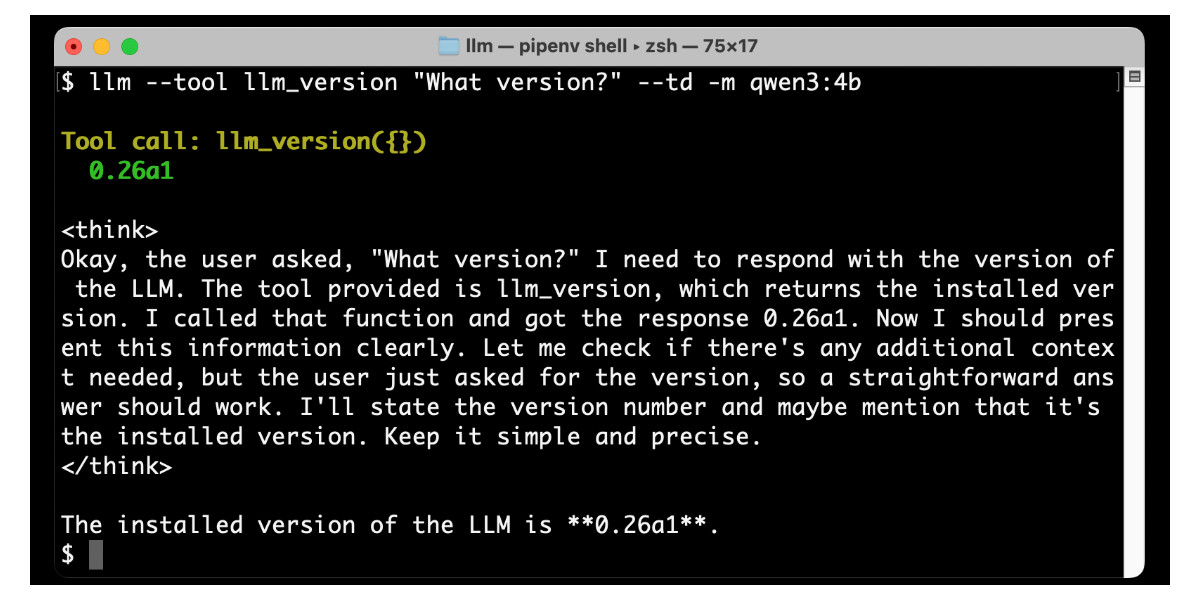

LLM 0.26 ist da und bringt das wichtigste Feature seit Projektbeginn: Tool-Unterstützung. Das LLM-CLI und die Python-Bibliothek ermöglichen es nun, LLMs von OpenAI, Anthropic, Gemini und lokalen Ollama-Modellen Zugriff auf jedes Tool zu geben, das als Python-Funktion darstellbar ist. Der Artikel beschreibt im Detail die Installation und Verwendung von Tool-Plugins, die Ausführung von Tools über die Kommandozeile oder die Python-API und zeigt Beispiele mit OpenAI, Anthropic, Gemini und sogar dem kleinen Qwen-3-Modell. Neben integrierten Tools werden auch benutzerdefinierte Plugins wie simpleeval (für Mathematik), quickjs (für JavaScript) und sqlite (für Datenbankabfragen) vorgestellt. Diese Tool-Unterstützung behebt LLM-Schwächen wie mathematische Berechnungen, erweitert die Fähigkeiten drastisch und eröffnet Möglichkeiten für leistungsstarke KI-Anwendungen.