Apple-Paper liefert LLMs einen Schlag: Turm von Hanoi offenbart Grenzen

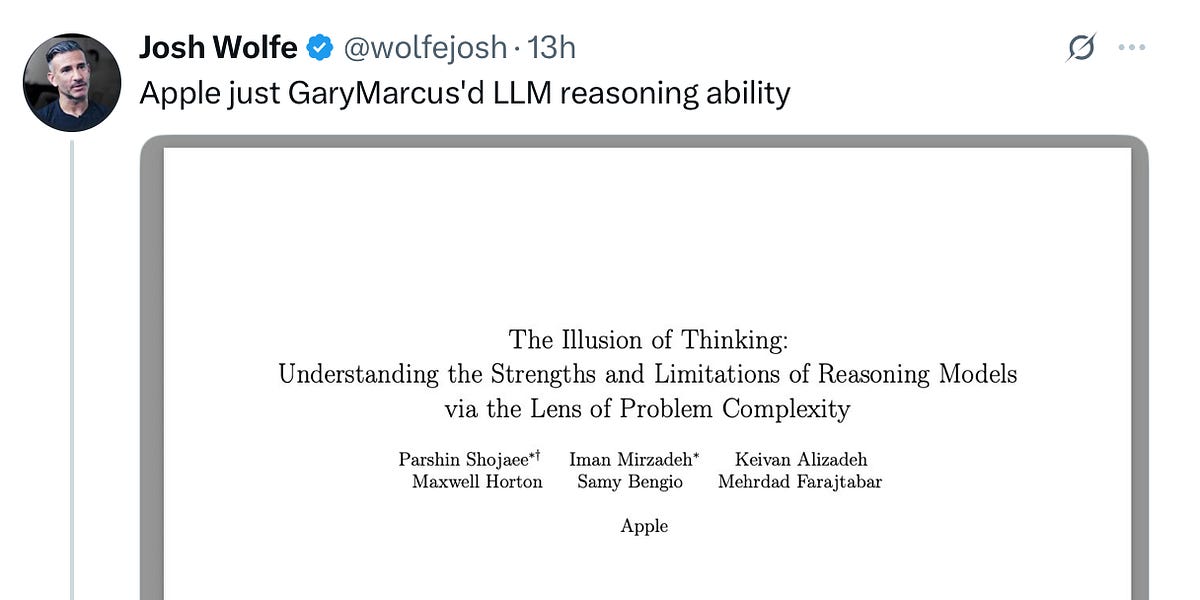

Ein neuer Apple-Beitrag hat in der KI-Community Wellen geschlagen. Der Beitrag zeigt, dass selbst die neueste Generation von „Reasoning Models“ das klassische Problem des Turms von Hanoi nicht zuverlässig lösen kann, was einen kritischen Mangel in den Schlussfolgerungsfähigkeiten großer Sprachmodelle (LLMs) aufdeckt. Dies stimmt mit der langjährigen Kritik von Forschern wie Gary Marcus und Subbarao Kambhampati überein, die die begrenzten Generalisierungsfähigkeiten von LLMs hervorgehoben haben. Der Beitrag zeigt, dass LLMs selbst bei Bereitstellung des Lösungsalgorithmus das Problem nicht effektiv lösen können, was darauf hindeutet, dass ihr „Denkprozess“ kein echter logischer Denkprozess ist. Dies deutet darauf hin, dass LLMs kein direkter Weg zur Allgemeinen Künstlichen Intelligenz (AGI) sind, und ihre Anwendungen bedürfen einer sorgfältigen Abwägung.