Feintuning von LLMs: Wissensinjektion oder destruktives Überschreiben?

2025-06-11

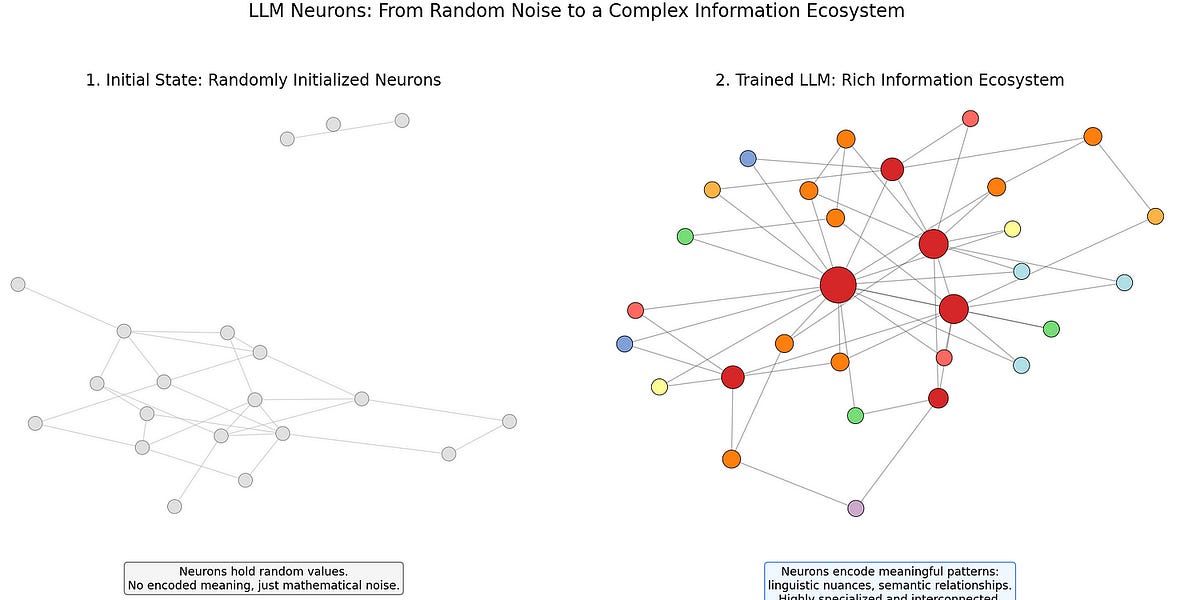

Dieser Artikel enthüllt die Grenzen des Feintunings großer Sprachmodelle (LLMs). Der Autor argumentiert, dass Feintuning bei fortgeschrittenen LLMs nicht einfach nur Wissensinjektion ist, sondern bestehende Wissensstrukturen zerstören kann. Der Artikel untersucht, wie neuronale Netze funktionieren, und erklärt, wie Feintuning zum Verlust wichtiger Informationen in bestehenden Neuronen führen und unerwartete Konsequenzen haben kann. Der Autor plädiert für modulare Ansätze wie Retrieval-Augmented Generation (RAG), Adaptermodule und Prompt Engineering, um neue Informationen effektiver einzubringen, ohne die Gesamtarchitektur des Modells zu beschädigen.