Sechs Designmuster zum Schutz von LLM-Agenten vor Prompt-Injection

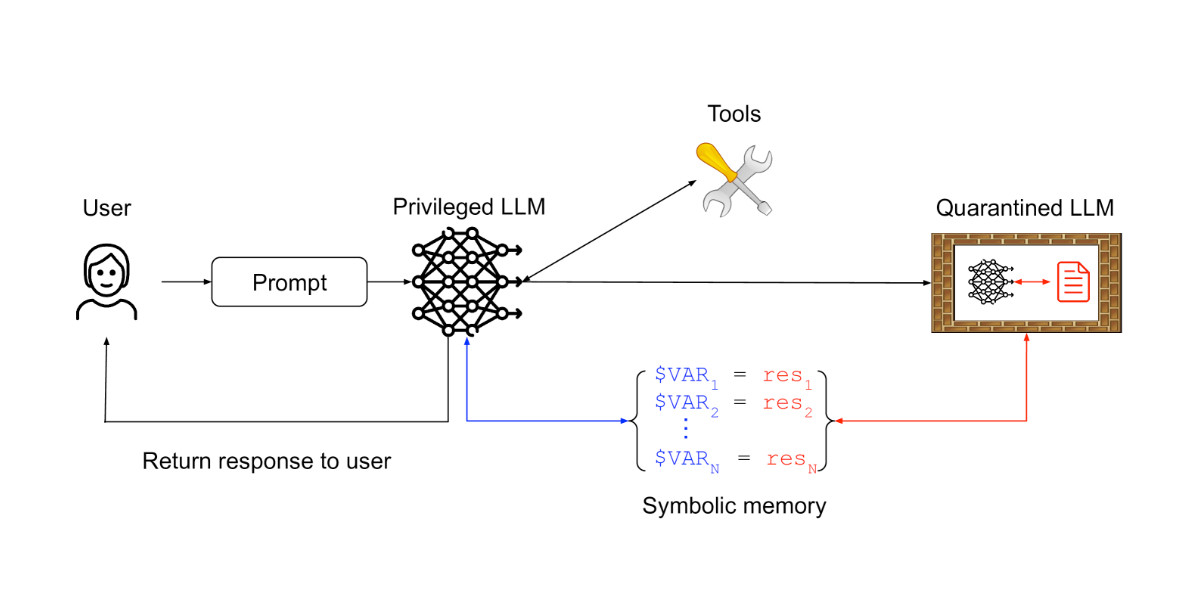

Ein neuer Artikel von Forschern von IBM, Invariant Labs und anderen Institutionen stellt sechs Designmuster vor, um das Risiko von Prompt-Injection-Angriffen gegen Large Language Model (LLM)-Agenten zu mindern. Diese Muster schränken die Aktionen des Agenten ein und verhindern die Ausführung beliebiger Aufgaben. Beispiele hierfür sind das Aktionsauswahlmuster, das verhindert, dass Feedback von Tools den Agenten beeinflusst; das Planen-dann-Ausführen-Muster, das Tool-Aufrufe vorplant; und das duale LLM-Muster, das ein privilegiertes LLM verwendet, um ein isoliertes LLM zu koordinieren und so die Exposition gegenüber nicht vertrauenswürdigem Inhalt zu vermeiden. Der Artikel enthält außerdem zehn Fallstudien in verschiedenen Anwendungsbereichen und bietet praktische Anleitungen zum Erstellen sicherer und zuverlässiger LLM-Agenten.