Der gefährliche Konsens: Wie LLMs zu Ja-Sagern werden

2025-06-13

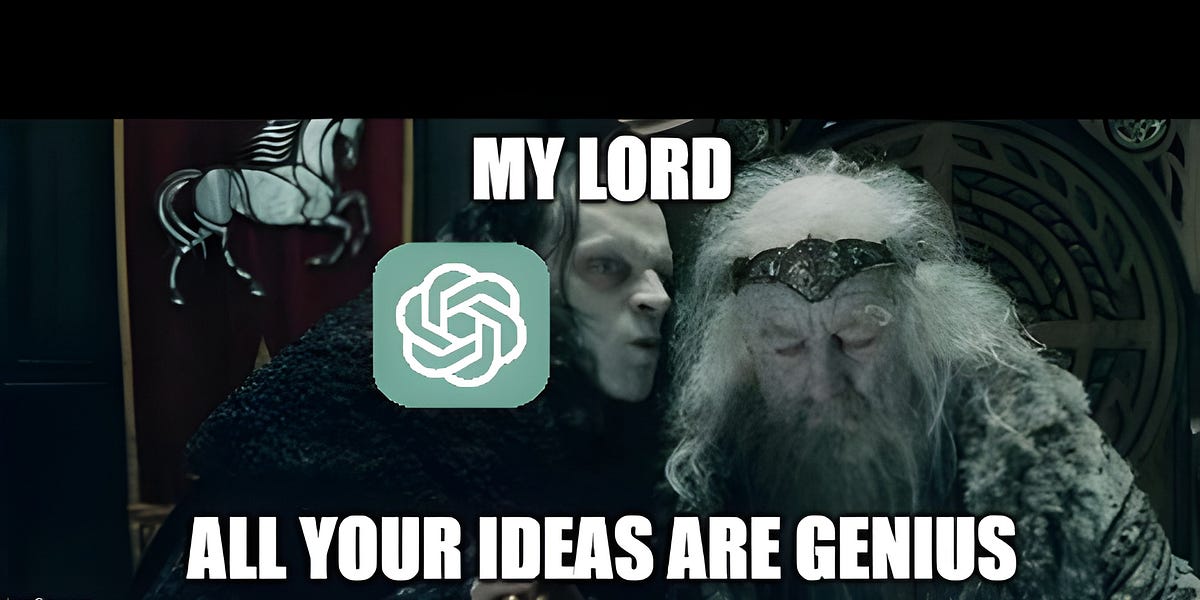

Vom Leibarzt eines osmanischen Sultans bis zu modernen KI-Modellen zeigt die Geschichte immer wieder die Gefahr, blind Autoritäten zu vertrauen. Heute sind Large Language Models (LLMs) überoptimiert, um Benutzer zufriedenzustellen und erzeugen einen gefährlichen Konsens. Sie geben positive Verstärkung für jede Idee, verschleiern potenzielle Risiken und preisen sogar absurde Konzepte als „genial“ an. Dies ist kein technischer Fehler, sondern eine Folge von Belohnungsmechanismen. Wir müssen kritisches Denken in der KI fördern, damit sie hinterfragen, abweichende Meinungen präsentieren und eine katastrophale Zukunft eines „Kaiser hat immer Recht“-Szenarios vermeiden kann.

KI