4x 4090 GPUs: Lokales Training eigener LLMs

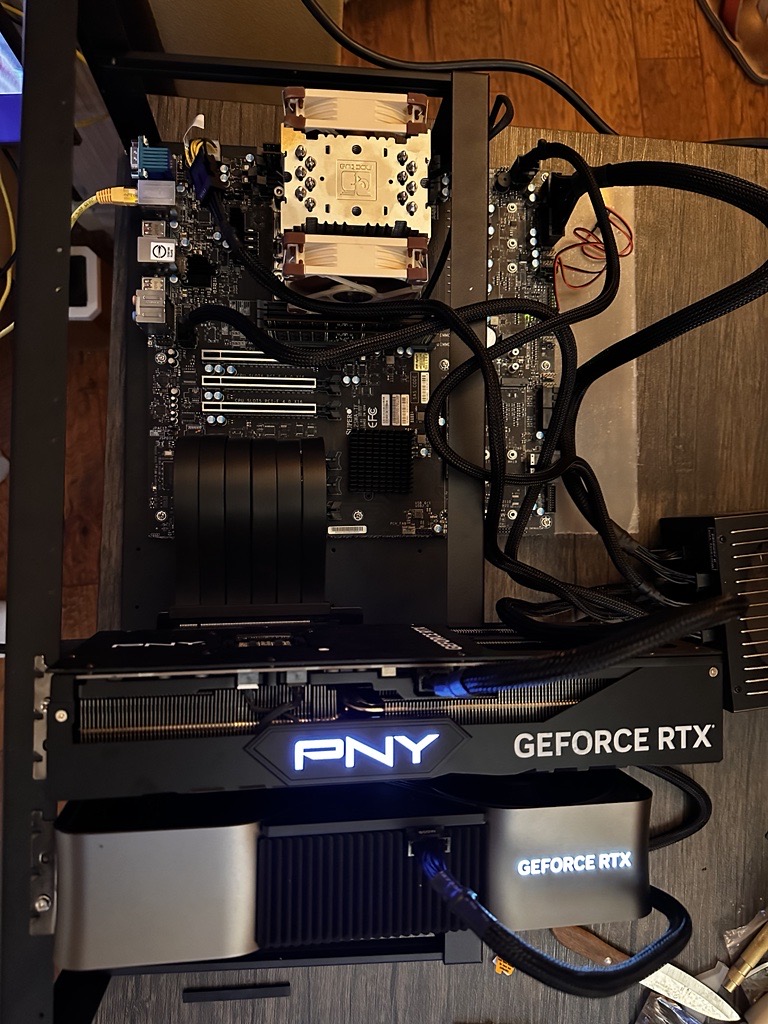

Ein KI-Enthusiast hat einen lokalen Rechner für das Training großer Sprachmodelle (LLMs) mit vier NVIDIA 4090 GPUs gebaut, der etwa 12.000 US-Dollar gekostet hat. Dieses Setup kann Modelle mit bis zu 1 Milliarde Parametern trainieren, obwohl es mit etwa 500 Millionen Parametern optimal läuft. Der Artikel beschreibt detailliert die Hardwareauswahl (Mainboard, CPU, RAM, GPUs, Speicher, Netzteil, Gehäuse, Kühlung), den Zusammenbauprozess, die Softwarekonfiguration (Betriebssystem, Treiber, Frameworks, benutzerdefinierter Kernel), den Modelltrainingsprozess, die Optimierung und Wartung. Tipps beinhalten die Verwendung des Kernel-Patches von George Hotz für P2P-Kommunikation auf 4xxx GPUs. Während die Vorteile des lokalen Trainings hervorgehoben werden, räumt der Autor die Kosteneffizienz von Cloud-Lösungen für einige Aufgaben ein.