LLMs im Jahr 2024: Fortschritte und Herausforderungen

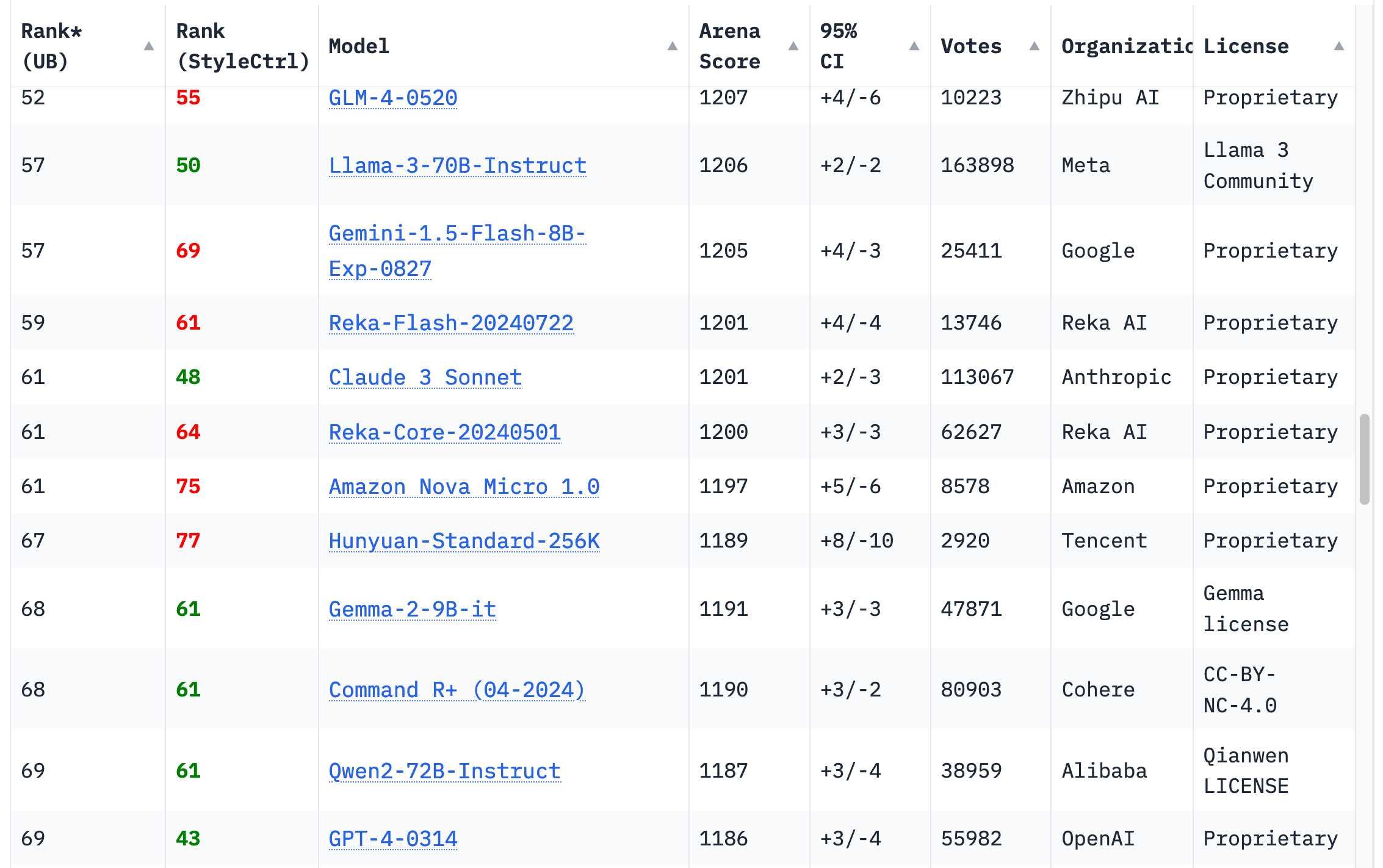

2024 war ein Jahr bemerkenswerter Entwicklungen bei großen Sprachmodellen (LLMs). Mehrere Organisationen übertrafen die Leistung von GPT-4, was zu einer drastischen Effizienzsteigerung führte – LLMs konnten sogar auf privaten Laptops laufen. Multimodale Modelle wurden zum Standard, mit aufkommenden Sprach- und Videofunktionen. Die promptgesteuerte App-Generierung wurde zur Commodity, doch der universelle Zugriff auf die besten Modelle dauerte nur wenige Monate. Obwohl „Agents“ weiterhin schwer fassbar blieben, gewann die Bedeutung von Evaluierungen an Bedeutung. Apples MLX-Bibliothek übertraf die Erwartungen, im Gegensatz zu den enttäuschenden „Apple Intelligence“-Funktionen. Inferenz-skalierende Modelle entstanden, senkten die Kosten und verbesserten die Umweltbilanz, warfen aber gleichzeitig Bedenken hinsichtlich der Umweltbelastung neuer Infrastrukturen auf. Synthetische Trainingsdaten erwiesen sich als äußerst effektiv, doch die Benutzerfreundlichkeit von LLMs blieb eine Herausforderung, die Wissensverteilung war ungleichmäßig und bessere kritische Bewertungen sind notwendig.