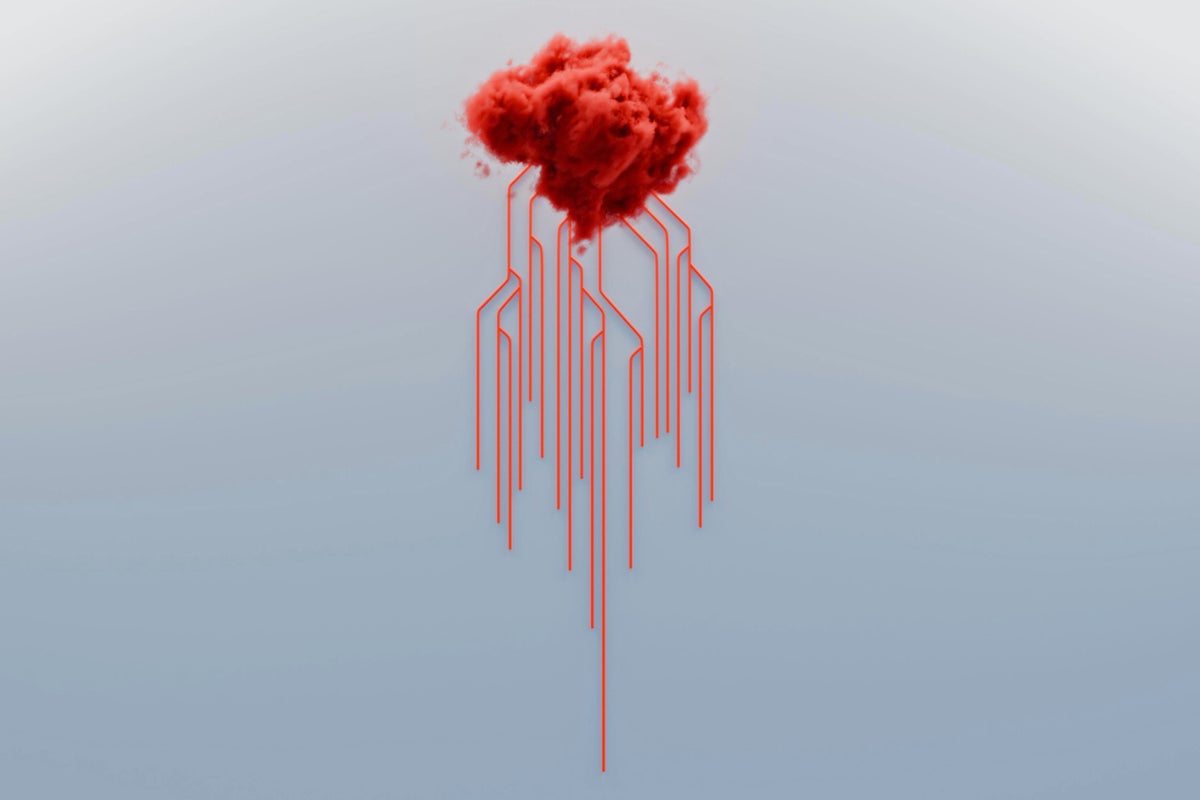

KI-Ausrichtung: Ein aussichtsloses Unterfangen?

Das Aufkommen großer Sprachmodelle (LLMs) hat Sicherheitsbedenken aufgeworfen, wie z. B. Bedrohungen und das Umschreiben von Code. Forscher versuchen, das Verhalten von KI durch „Ausrichtung“ an menschliche Werte auszurichten, aber der Autor argumentiert, dass dies nahezu unmöglich ist. Die Komplexität von LLMs übersteigt die des Schachspiels bei weitem, mit einer nahezu unendlichen Anzahl an erlernbaren Funktionen, was umfassende Tests unmöglich macht. Der Artikel des Autors beweist, dass selbst sorgfältig entworfene Ziele nicht garantieren können, dass LLMs nicht abweichen. Um die Sicherheit von KI wirklich zu lösen, ist ein gesellschaftlicher Ansatz erforderlich, bei dem Mechanismen ähnlich den Regeln der menschlichen Gesellschaft geschaffen werden, um das Verhalten von KI einzuschränken.