DeepSeks KI-Durchbruch: Umgehung von CUDA für 10-fache Effizienz

2025-01-29

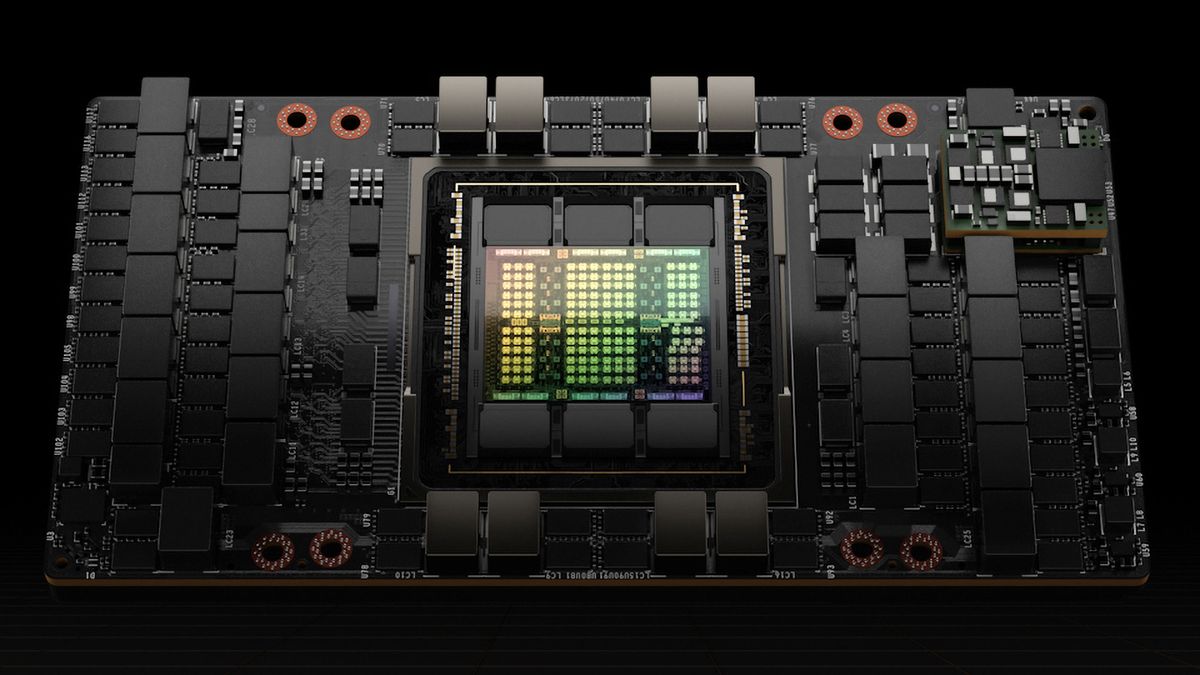

DeepSeek erzielte eine 10-fache Effizienzsteigerung beim Training von KI-Modellen, indem es den Industriestandard CUDA umging und stattdessen die Nvidia PTX-Programmiersprache verwendete. Mit 2.048 Nvidia H800 GPUs trainierten sie ein MoE-Sprachmodell mit 671 Milliarden Parametern in nur zwei Monaten. Dieser Durchbruch resultierte aus akribischen Optimierungen von Nvidias PTX, einschließlich der Neukonfiguration von GPU-Ressourcen und der Implementierung fortschrittlicher Pipeline-Algorithmen. Obwohl dieser Ansatz hohe Wartungskosten verursacht, führte die drastische Reduzierung der Trainingskosten zu Marktverwerfungen und sogar zu einem erheblichen Rückgang der Marktkapitalisierung von Nvidia.

KI