LLM-Modell unter 100 MB jetzt per pip installierbar: Vorstellung von llm-smollm2

2025-02-07

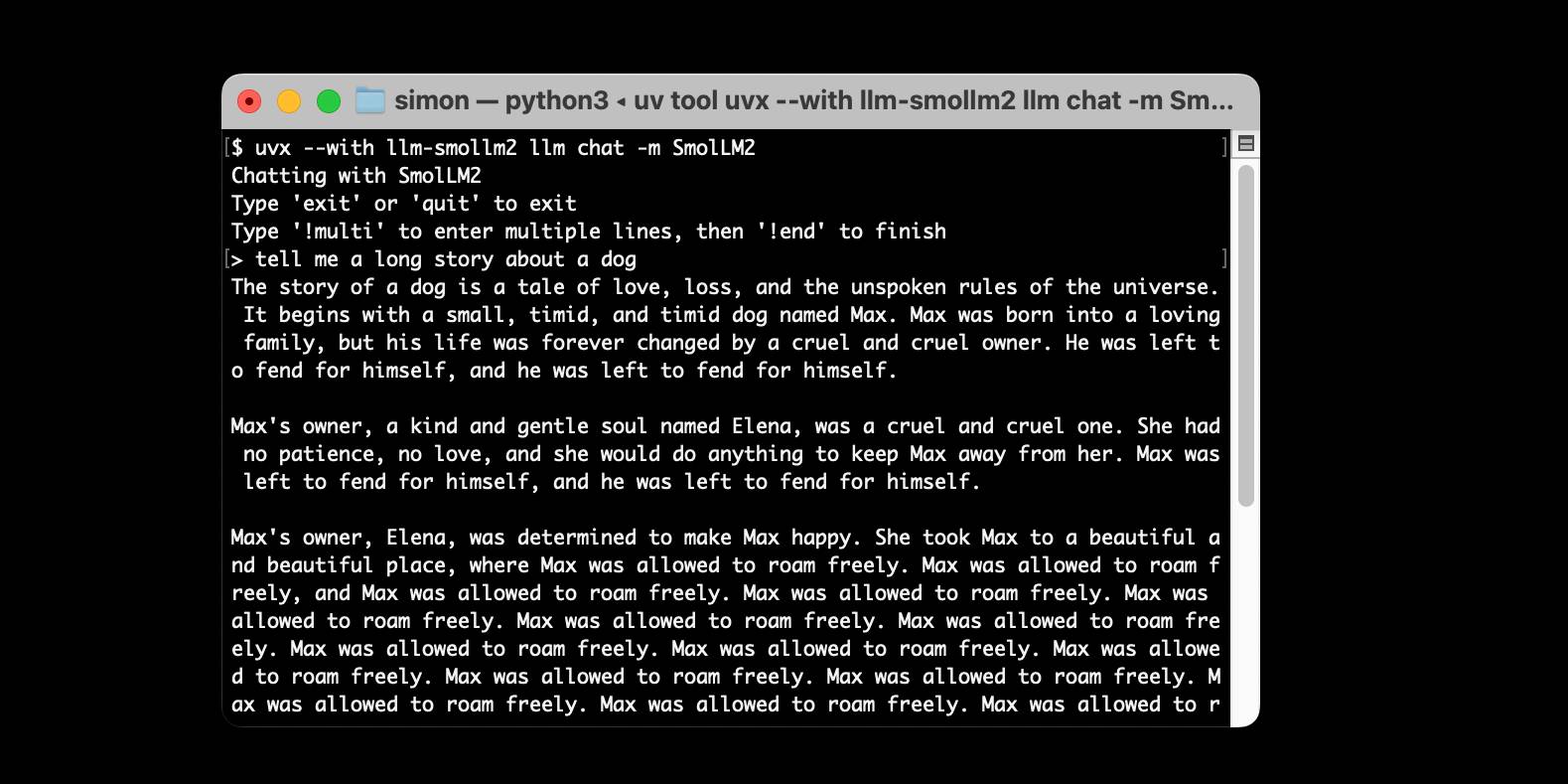

Ein neues Plugin, llm-smollm2, enthält ein quantisiertes SmolLM2-135M-Instruct LLM-Modell von unter 100 MB, wodurch es per pip installierbar ist. Der Autor beschreibt den Erstellungsprozess, von der Suche nach einem geeigneten Modell unter 100 MB (begrenzt durch die Größenbeschränkungen von PyPI) bis zur Unterdrückung der ausführlichen Protokollierung von llama-cpp-python und der Verpackung für PyPI. Obwohl die Fähigkeiten des Modells begrenzt sind, wird es als wertvolles Lernwerkzeug zum Verständnis der LLM-Technologie präsentiert.

Entwicklung

Modellquantisierung