Células Conceito: Os Blocos de Construção da Memória?

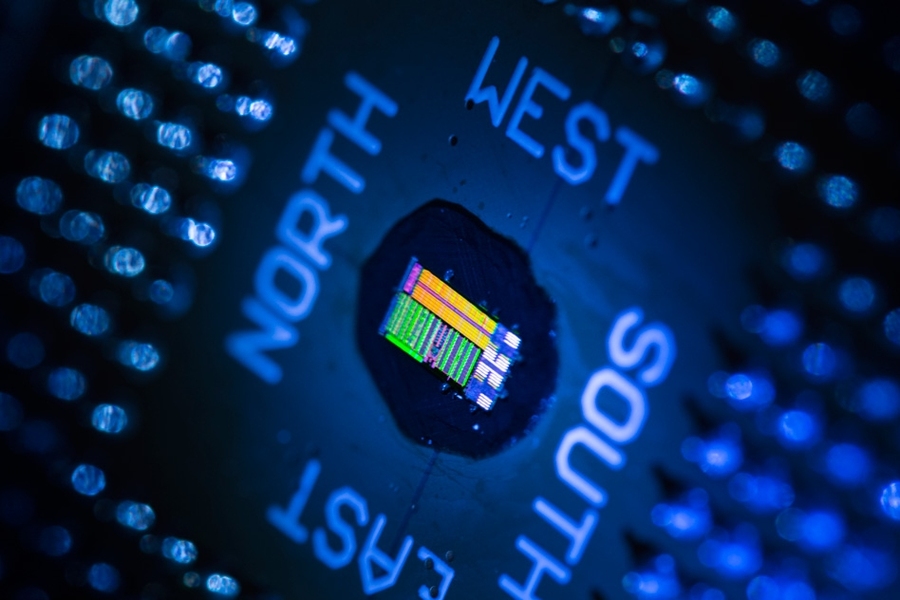

Neurocientistas descobriram 'células conceito' no cérebro que disparam para ideias específicas, independentemente de como essa ideia é apresentada (imagem, texto, fala, etc.). Essas células não apenas respondem a imagens; elas representam conceitos abstratos, desempenhando um papel crucial na formação da memória. Pesquisas sugerem que as células conceito se interconectam para formar redes complexas de memória. Essa descoberta desafia a neurociência tradicional, oferecendo novas perspectivas sobre a memória e a cognição humanas. A descoberta inicial dessas células, inicialmente chamadas de 'células Jennifer Aniston', foi recebida com ceticismo, mas pesquisas subsequentes solidificaram sua importância.