Google DeepMind发布Gemini Robotics:赋能下一代机器人

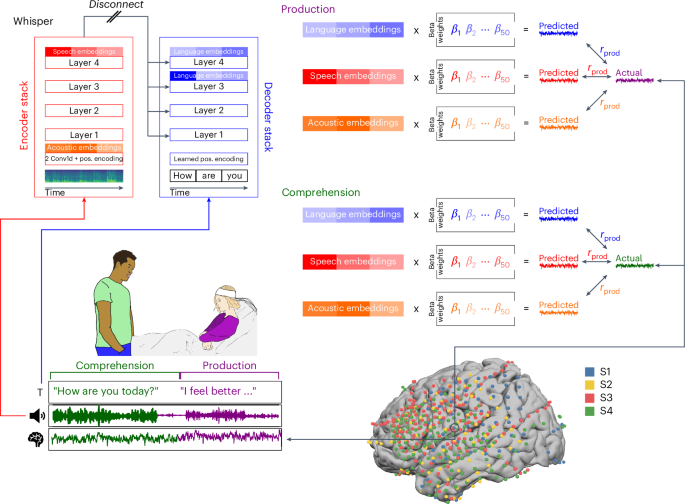

Google DeepMind发布了基于Gemini 2.0的两个新AI模型:Gemini Robotics和Gemini Robotics-ER,它们能够让机器人执行更广泛的现实世界任务。Gemini Robotics是一个先进的视觉-语言-动作模型,能够直接控制机器人;Gemini Robotics-ER则具有先进的空间理解能力,允许机器人专家使用Gemini的具身推理能力运行他们自己的程序。这两个模型都具有通用性、交互性和灵活性,能够处理各种任务和环境,并与人类更好地协作。DeepMind还发布了一个新的数据集ASIMOV,用于评估和改进具身AI和机器人的语义安全性,并与Apptronik等公司合作开发下一代人形机器人。