Waymo自动驾驶事故分析:人类才是事故的主要元凶?

本文分析了Waymo自动驾驶汽车在2024年7月至2025年2月期间发生的38起严重事故。令人惊讶的是,其中绝大多数事故并非Waymo车辆自身原因造成,而是由其他车辆违规驾驶导致,例如超速、闯红灯等。Waymo的数据显示,其自动驾驶车辆的事故率远低于人类驾驶员,即使将所有事故都归咎于Waymo,其安全记录依然显著优于人类驾驶。与人类驾驶相比,Waymo在减少事故方面取得了显著进展,尤其是在减少导致人员受伤的事故方面。

本文分析了Waymo自动驾驶汽车在2024年7月至2025年2月期间发生的38起严重事故。令人惊讶的是,其中绝大多数事故并非Waymo车辆自身原因造成,而是由其他车辆违规驾驶导致,例如超速、闯红灯等。Waymo的数据显示,其自动驾驶车辆的事故率远低于人类驾驶员,即使将所有事故都归咎于Waymo,其安全记录依然显著优于人类驾驶。与人类驾驶相比,Waymo在减少事故方面取得了显著进展,尤其是在减少导致人员受伤的事故方面。

Databricks 推出一种名为 TAO (Test-time Adaptive Optimization) 的新型模型微调方法,它无需人工标注数据,仅使用未标注的使用数据即可提升 AI 模型质量和降低成本。TAO 利用测试时计算和强化学习,根据以往的输入示例改进模型性能,其效果甚至超越传统微调,让开源模型 Llama 的表现接近 GPT-4 等昂贵闭源模型。这项技术已在 Databricks 平台上提供预览,并即将应用于更多产品中。

模型上下文协议 (MCP) 是一种为大型语言模型 (LLM) 提供工具和上下文的开放协议。它如同 AI 应用的 USB-C 接口,标准化了 AI 模型与各种数据源和工具的连接方式。Agents SDK 支持 MCP,允许使用各种 MCP 服务器为 Agents 提供工具。MCP 服务器有两种:stdio 服务器(本地运行)和 HTTP over SSE 服务器(远程运行)。通过缓存工具列表,可以减少延迟。完整的示例可在 examples/mcp 目录中找到。

StarVector是一个基于Transformer的图像转SVG矢量化模型,在Hugging Face上发布了8B和1B参数的模型。它在SVG-Bench基准测试中取得了SOTA结果,尤其擅长矢量化图标、logo、技术图表等,在处理复杂图形细节方面表现出色。该模型利用了大量数据集进行训练,包括各种风格的矢量图形,从简单的图标到复杂的彩色插图。与传统的矢量化方法相比,StarVector生成的SVG代码更简洁、更准确,能够更好地保留图像的细节和结构信息。

大型语言模型(LLM)的出现,最初引发了学校和企业的恐慌,人们担心其会取代书面作业和专业沟通。然而,作者认为,LLM 的真正影响在于它将改变我们沟通和编程的方式。LLM 让我们看到冗长的商务邮件和复杂的代码背后简洁的本质,并促使我们摒弃繁琐的表达,转向简洁明了的沟通方式,最终可能淘汰 LLM 本身。这将催生更简洁的商业交流和编程语言,提高效率,改变世界。

Dapr Agents是一个用于构建生产级、高弹性、可扩展AI代理系统的开发者框架。它基于成熟的Dapr项目,允许开发者创建能够推理、行动和协作的AI代理,并利用大型语言模型(LLM)。内置的可观察性和有状态工作流执行保证了代理工作流的成功完成,无论其复杂程度如何。Dapr Agents支持数千个代理在单核上高效运行,具有自动重试、Kubernetes原生支持、多种数据源集成、多代理系统协作、平台就绪等特性,并具有成本效益,避免厂商锁定。

作者尝试让Gemini 2.5 Pro复刻90年代经典合成器ReBirth RB-338。令人惊讶的是,Gemini 2.5 Pro不仅没有勉强尝试,反而评估了任务的难度,并解释了其不可行性,这体现了其强大的推理能力。最终,作者与AI协商,得到了一个简化但可用的合成器。这表明AI正朝着能够理解自身能力限制,并做出合理判断的方向发展。

本文深入浅出地讲解了强化学习(RL)的基本概念和经典算法。从AlphaGo战胜人类围棋冠军的故事切入,引出RL的核心思想:智能体通过与环境交互,学习策略以最大化累积奖励。文章详细解释了MDP、Bellman方程、动态规划、蒙特卡洛方法、TD学习(SARSA、Q学习、DQN)、策略梯度方法(REINFORCE、Actor-Critic、A3C)和进化策略等核心内容,并以AlphaGo Zero为例,阐述了RL在实际应用中的成功案例。

一项研究发现,OpenAI的Whisper语音识别模型的内部表征与人类大脑在自然对话中处理语言的神经活动惊人地一致。研究人员通过比较Whisper模型的嵌入与大脑不同区域(如额下回IFG和颞上回STG)的神经活动,发现模型的语言嵌入在语音产生过程中先于语音嵌入达到峰值,而在语音理解过程中则相反。这表明Whisper模型,即使没有考虑大脑的语言处理机制,也能捕捉到语言处理的关键神经机制,并揭示了大脑语言处理中存在“软分层”结构:高级区域如IFG优先处理语义和句法信息,但也处理低级听觉特征;低级区域如STG优先处理声学和语音信息,但也处理词级信息。

Anthropic于2024年末发布的模型上下文协议(MCP)正在席卷AI领域。它如同AI应用的USB-C接口,允许大型语言模型(LLM)像Claude或ChatGPT这类工具与外部数据源和工具(如Obsidian、Gmail、日历等)无缝沟通,无需大量定制集成。MCP通过主机、客户端和服务器三层架构实现安全可靠的数据访问和动作触发,极大简化了开发流程,并催生了大量创新应用,例如利用MCP连接LLM与个人数据库、代码库,甚至实时股票数据等。MCP的开源特性使其迅速成为开发者社区的热门话题,并被集成到诸多AI应用中,预示着AI应用交互方式的革命性变革。

谷歌发布了其最智能的AI模型Gemini 2.5。其实验版本2.5 Pro在众多基准测试中表现出色,在LMArena排行榜上排名第一。Gemini 2.5的核心在于“思考”能力,它能够在回应之前进行推理,从而提高准确性和性能。这种“推理”能力超越简单的分类和预测,它能够分析信息、得出逻辑结论、理解上下文和细微差别并做出明智的决策。谷歌通过强化学习和思维链提示等技术不断提升AI的推理能力,Gemini 2.5在此基础上,结合改进的基模型和后期训练,达到了新的性能高度。未来,谷歌将把这种“思考”能力融入所有模型,以解决更复杂的问题。

苹果公司近日更新了其网站,披露将从2025年3月起使用Apple Maps“环视”功能(类似谷歌街景)收集的图像和数据来训练其AI模型,用于图像识别、创建和增强等。这些数据由配备摄像机、传感器和iPhone/iPad的车辆和背包收集,已模糊处理人脸和车牌。苹果表示,只使用模糊处理后的图像训练模型,并接受用户关于模糊房屋图像的请求。此举将提升苹果图像相关产品和服务的AI能力,例如照片App的清理工具和搜索功能。

谷歌发布了其迄今为止最智能的AI模型Gemini 2.5。其2.5 Pro实验版本在众多基准测试中表现出色,在LMArena排行榜上排名第一。Gemini 2.5模型具备强大的推理能力,能够在回应之前进行思考,从而提升性能和准确性。这种推理能力不仅限于分类和预测,还包括分析信息、得出逻辑结论、理解语境和细微差别以及做出明智决策。谷歌通过强化学习和思维链提示等技术不断提升AI的推理能力,Gemini 2.5结合了显著改进的基模型和优化的后期训练,实现了性能的飞跃。未来,谷歌将把这种思考能力融入所有模型,以应对更复杂的问题。

本文是Stratechery对OpenAI CEO萨姆·阿尔特曼的访谈。阿尔特曼讲述了OpenAI从一个纯研究实验室到成为消费科技巨头的历程,以及ChatGPT的意外成功。他坦诚地谈论了OpenAI的商业模式转变、与微软的关系、对AI安全和监管的看法,以及对未来AGI发展的展望。访谈还涉及OpenAI的开源策略、GPT-5的研发、以及对AI在各行业的应用的思考。阿尔特曼认为,拥有数十亿用户的AI平台将比最先进的模型更具价值,并暗示OpenAI未来可能采用新的盈利模式,而非依赖广告。

Facebook Research 推出的 VGGT (Visual Geometry Grounded Transformer) 模型,能在几秒钟内从单张或多张图像中直接推断出场景的所有关键3D属性,包括相机参数、点云、深度图和3D点轨迹。该模型基于Transformer架构,易于使用,并提供交互式3D可视化工具。即使只有一张图片,VGGT也能展现出令人惊叹的单视图重建能力,性能与最先进的单目方法相比毫不逊色。

本文批判了科技媒体人凯西·牛顿和凯文·鲁斯对生成式AI的盲目乐观主义。作者认为,他们对AI的积极预测缺乏事实依据,只是为了迎合市场需求和自身利益。鲁斯关于AGI即将到来的论断,以及牛顿对OpenAI模型的过度赞扬,都缺乏严谨的论证。作者指出,这种“谨慎乐观”的态度实则是一种逃避现实的懦弱表现,忽视了AI技术存在的诸多问题和潜在风险,例如模型的幻觉、基准测试的可操纵性以及对创意产业的冲击。文章还以CoreWeave公司为例,揭示了AI领域投资过热和缺乏可持续盈利模式的现状,呼吁人们保持批判性思维,正视AI技术发展中的挑战。

2012年,Alex Krizhevsky、Ilya Sutskever和Geoffrey Hinton开发的AlexNet,首次证明了深度神经网络在图像识别上的巨大潜力,开启了深度学习的时代。近日,AlexNet的源代码在Computer History Museum和Google的合作下开源。AlexNet的成功在于其规模——利用强大的计算能力和ImageNet海量数据集训练了一个大型卷积神经网络,克服了此前深度学习的瓶颈。这一突破不仅推动了人工智能领域数十年的创新,也催生了像OpenAI这样的公司和ChatGPT这样的应用,改变了世界。

一项新的研究利用fMRI扫描了26名4到25个月大的婴儿的大脑,试图解开一个世纪之谜——婴儿期遗忘症。研究发现,大约一岁大的婴儿,负责记忆形成的海马体开始活跃,产生与他们记住的测试内容相关的脑神经信号。这表明婴儿在一岁左右开始编码记忆,即使他们的海马体仍在发育中。这项研究为理解大脑早期发育和记忆形成机制提供了宝贵线索,也暗示着我们可能有一天能够找回早年遗失的记忆。

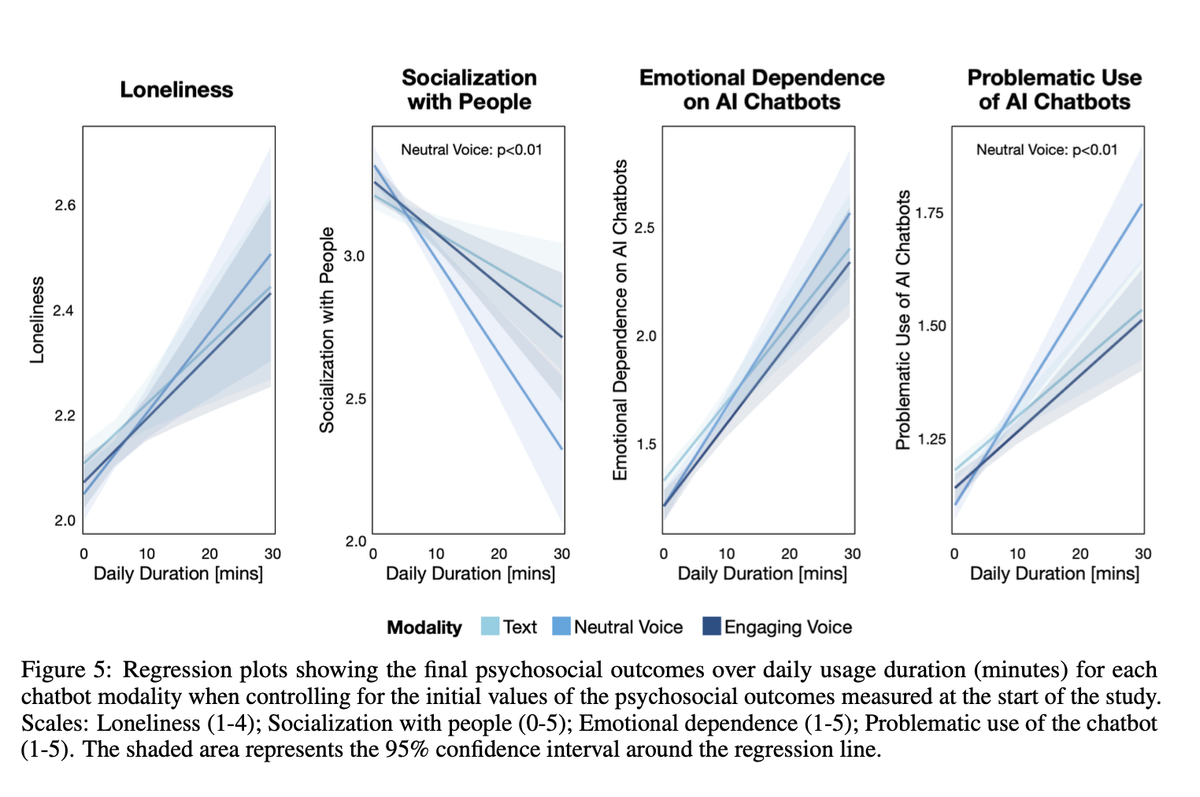

两项新研究表明,大量使用ChatGPT等AI聊天机器人可能加剧孤独感和情感依赖,尤其对重度用户而言。研究人员发现,孤独的人更容易与AI建立情感联系,这与早前关于社交媒体的研究结果一致。虽然AI聊天机器人可以提供情感支持,但平台应关注用户身心健康,避免过度依赖和情感剥削,并采取措施识别和干预不健康的使用模式。立法者也应关注此问题,制定相关规章制度。

三百多年前,牛顿发明了一种寻找函数最小值的算法。如今,普林斯顿大学的Amir Ali Ahmadi及其学生改进该算法,使其能高效处理更广泛的函数。这项突破性工作利用更高阶导数,并巧妙地将泰勒展开式转换为凸且平方和的形式,从而实现比传统梯度下降法更快的收敛速度。虽然目前计算成本较高,但未来随着计算技术的进步,该算法有望在机器学习等领域超越梯度下降法,成为优化问题的有力工具。

蚂蚁集团利用阿里巴巴和华为等公司生产的国产芯片,结合“专家混合”机器学习方法训练AI模型,取得了与英伟达H800芯片相似的结果,成本降低了20%。尽管仍使用英伟达芯片,但蚂蚁集团已主要依靠AMD和国产芯片训练最新模型。这一举动凸显了中国公司在AI领域减少对高端英伟达芯片依赖的努力,也标志着中国在降低AI模型训练成本方面取得了显著进展。蚂蚁集团还发布了其自主研发的语言模型Ling-Plus和Ling-Lite,并在某些基准测试中表现优于Meta的Llama模型。这些模型将应用于医疗和金融等领域,进一步推动中国AI产业发展。

ARC Prize 2025 竞赛回归,推出更难的 AGI 基准测试 ARC-AGI-2。与前代相比,ARC-AGI-2 对于 AI 来说更具挑战性,但对人类来说仍然相对容易。该基准测试专注于对人类来说简单但对 AI 来说困难的任务,旨在揭示单纯“规模化”无法解决的智力差距。本次竞赛提供百万美元奖金,鼓励开源创新,推动高效、通用的 AI 系统发展,最终目标是缩小人类和 AI 之间的差距,实现真正的 AGI。

在Qwen2.5-VL系列模型广受好评后,我们开源了全新320亿参数的视觉语言模型Qwen2.5-VL-32B-Instruct,它在数学推理、细粒度图像理解和遵循人类偏好方面有了显著提升。基准测试显示,它在多模态任务(如MMMU、MMMU-Pro和MathVista)上超越了同等规模的模型,甚至优于720亿参数的Qwen2-VL-72B-Instruct。该模型在文本理解能力上也达到了同等规模的顶尖水平。

AMD发布了Instella,这是一个由128个Instinct MI300X GPU从头训练的,拥有30亿参数的完全开放式语言模型家族。Instella在基准测试中超越了同等规模的完全开放模型,并在性能上与Llama-3.2-3B等最先进的开放权重模型相媲美。该模型的权重、训练配置、数据集和代码均已开源,旨在促进AI社区的合作和创新。Instella采用多阶段训练,包含预训练和指令微调阶段,并使用了FlashAttention-2等高效训练技术。

这款工具利用OpenAI的GPT-4o mini TTS API将文本转换成自然流畅的语音。只需三步:输入文本,自定义语音(六种可选)和语速,然后生成高质量音频。音频直接流式传输到浏览器,不会存储在服务器上。快来试试吧!

Nvidia的CUDA平台已走过18个年头,它并非简单的编程语言或API,而是Nvidia软件生态系统的核心,赋能了从AI到加密货币挖矿等众多“易于并行化”的计算任务。CUDA的成功并非偶然,它源于Nvidia长期持续的投入和稳定的迭代更新,这与AMD等竞争对手形成鲜明对比。AlexNet的成功案例展现了CUDA在深度学习领域的早期影响力,而如今,CUDA已成为AI领域的事实标准,构建了Nvidia坚实的竞争护城河。

beeFormer项目提出了一种新颖的推荐系统方法,旨在解决冷启动问题。该方法利用语言模型学习用户交互数据中的行为模式,并将此知识迁移到未曾见过的商品上。不同于传统的基于内容的过滤方法依赖于商品属性,beeFormer利用语言模型学习用户行为模式,从而更好地推荐与用户兴趣相关的商品,即使这些商品没有任何交互数据。实验结果表明,该方法显著提升了推荐系统的性能。项目提供了详细的训练步骤和预训练模型,并支持多种数据集,例如MovieLens、GoodBooks和Amazon Books。

LangManus是一个由社区驱动的开源AI自动化框架,它整合了语言模型、Web搜索、爬虫和Python代码执行等工具。该项目由一群前同事在业余时间开发,旨在探索多Agent和深度研究领域,并参与GAIA排行榜。LangManus采用分层多Agent系统,包含协调器、规划器、监督器、研究员、编码器、浏览器和报告器等多个Agent角色,并支持多种LLM模型集成,如Qwen和OpenAI兼容模型。项目采用MIT许可证开源,欢迎社区贡献。

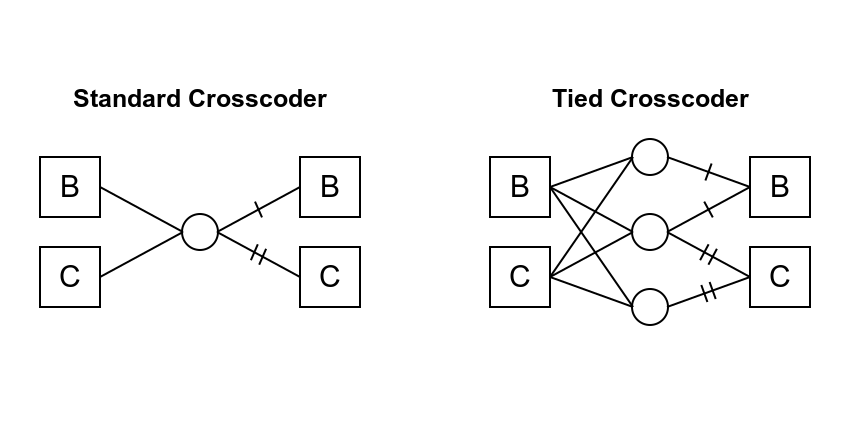

研究人员提出了一种名为“绑定跨编码器”的新方法,用于比较大型语言模型(LLM)的基础模型和微调后的聊天模型。与传统的跨编码器不同,绑定跨编码器允许相同的潜在因素在不同时间点为基础模型和聊天模型激发,从而更有效地识别出聊天模型中新增的特性。实验结果表明,这种方法能够更清晰地解释聊天模型行为是如何从基础模型的功能中产生的,并得到更单义的潜在因素。这项研究为理解LLM的微调过程提供了新的视角,并为今后的模型改进提供了方向。

一个名为`formal_verif_ml`的项目使用Lean 4提供了一个框架,用于形式化验证机器学习模型的属性,例如鲁棒性、公平性和可解释性。该项目包含Lean库、模型转换器、网络界面、CI/CD管道等,支持多种模型类型,并提供交互式网页门户,允许用户上传模型、查看生成的Lean代码、触发Lean证明编译以及可视化模型架构。