Lokales Ausführen von LLMs: Ein Leitfaden für Entwickler

2024-12-29

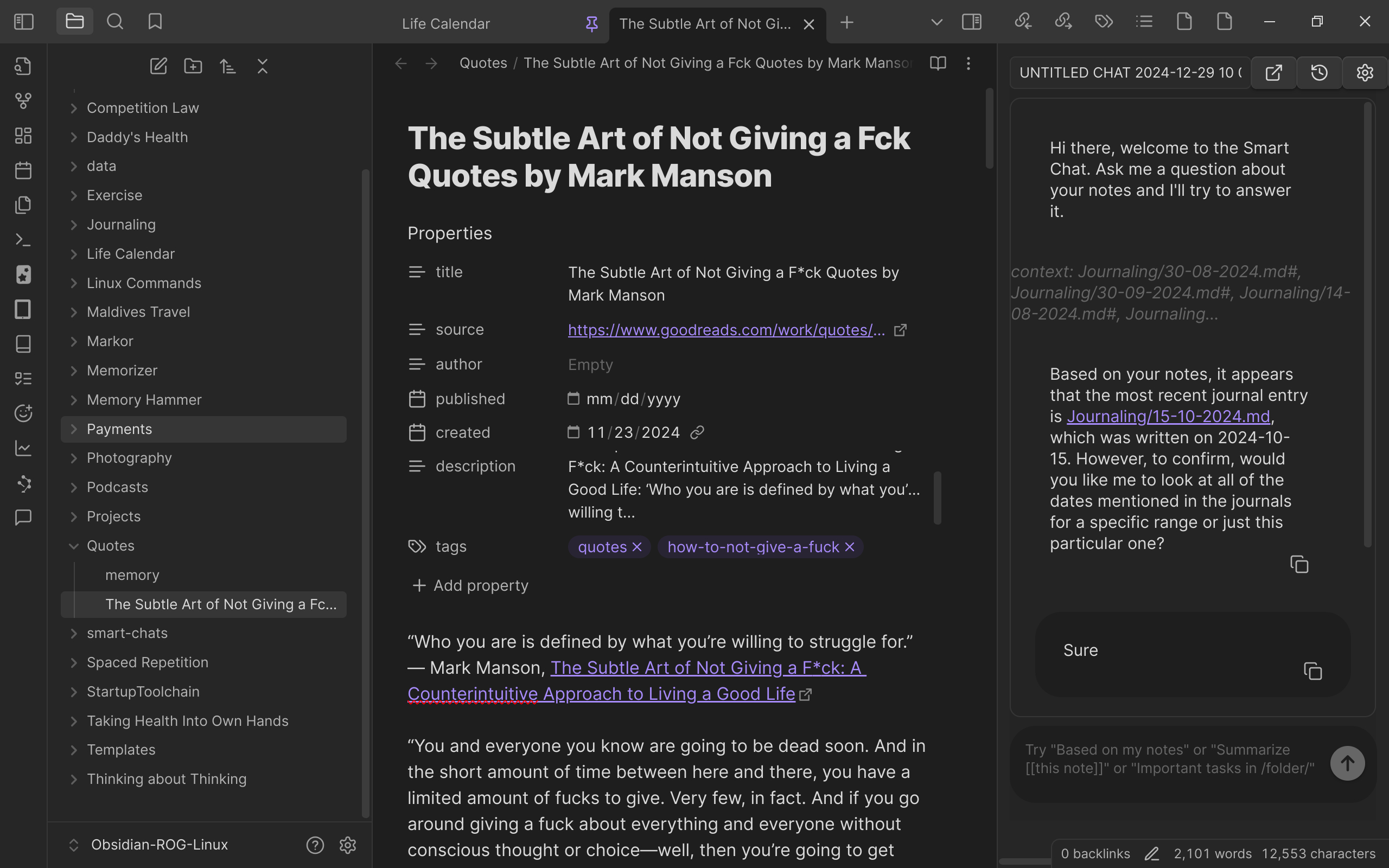

Ein Entwickler teilt seine Erfahrungen mit dem Ausführen von Large Language Models (LLMs) auf einem persönlichen Computer. Mit einem leistungsstarken Rechner (i9 CPU, 4090 GPU, 96 GB RAM) und Open-Source-Tools wie Ollama und Open WebUI konnte er erfolgreich mehrere LLMs für Aufgaben wie Code-Completion und Notizenabfragen ausführen. Der Artikel beschreibt detailliert die verwendete Hardware, Software, Modelle und Aktualisierungsmethoden und hebt die Vorteile der lokalen Ausführung von LLMs in Bezug auf Datensicherheit und niedrige Latenz hervor.