Können LLMs besseren Code schreiben, wenn man sie immer wieder bittet, „besseren Code zu schreiben“?

2025-01-03

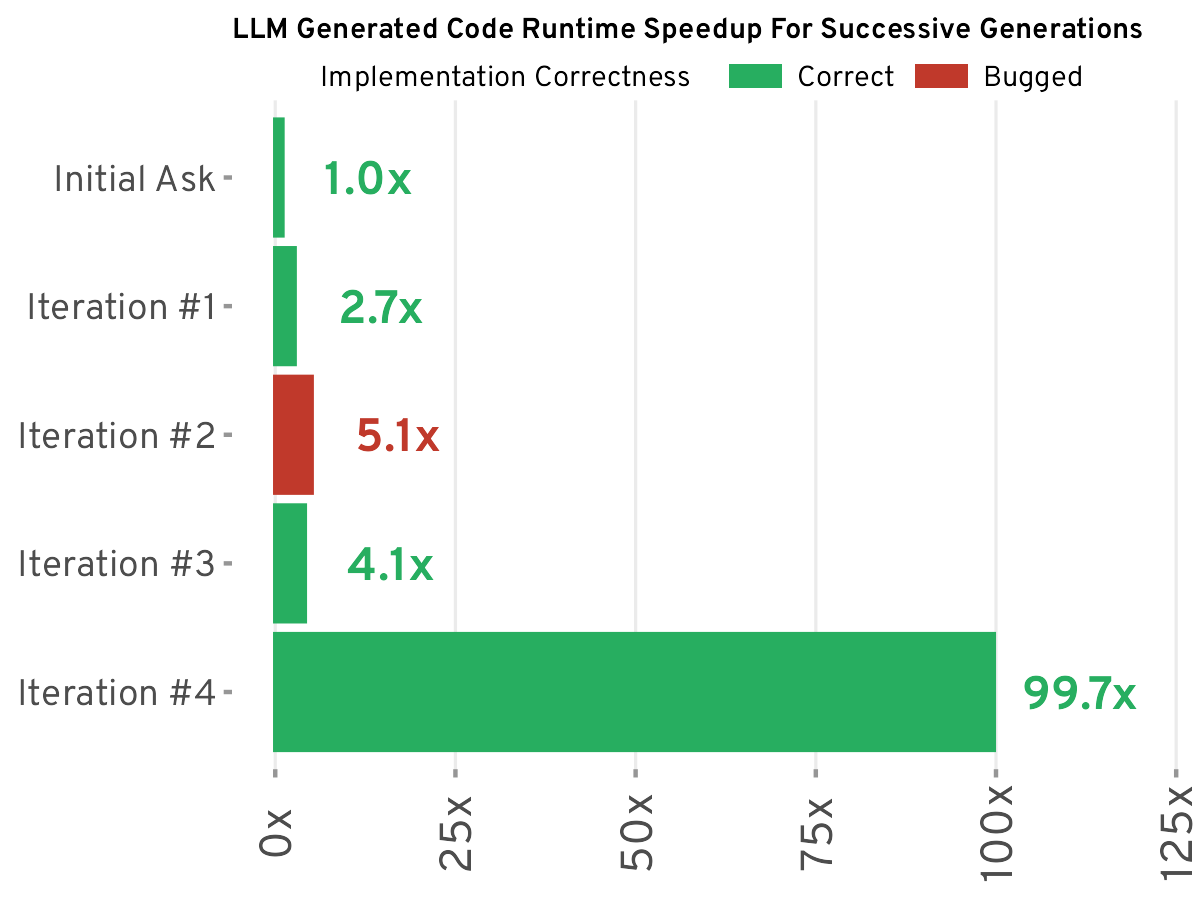

Dieser Blogbeitrag beschreibt ein Experiment, das untersucht, ob die wiederholte Aufforderung an ein Large Language Model (LLM), „besseren Code zu schreiben“, die Codequalität verbessert. Mit Claude 3.5 Sonnet beginnt der Autor mit einem einfachen Python-Codierproblem und fordert das LLM iterativ auf. Die Leistung verbessert sich drastisch und erreicht eine 100-fache Beschleunigung. Einfache iterative Aufforderungen führen jedoch zu Overengineering. Präzises Prompt Engineering erzeugt einen deutlich effizienteren Code. Das Experiment zeigt, dass LLMs die Codeoptimierung unterstützen können, aber menschliches Eingreifen und Fachwissen bleiben für Qualität und Effizienz unerlässlich.

Entwicklung

Codeoptimierung