DeepSeek v3: Wesentliche Verbesserungen der Transformer-Architektur

2025-01-28

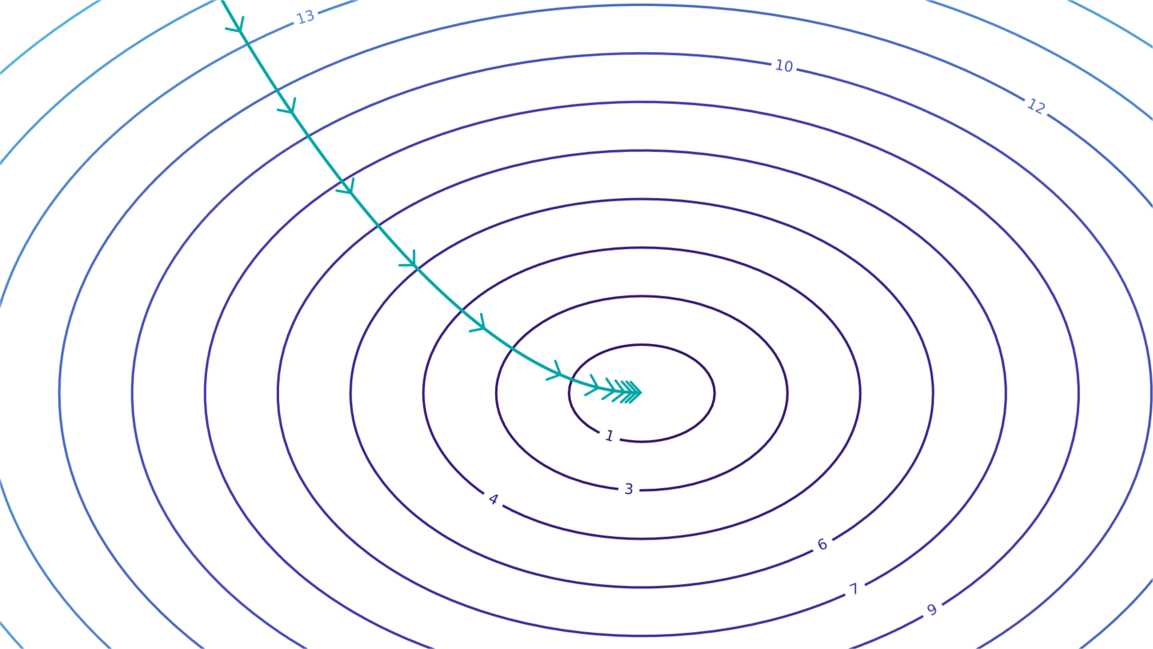

DeepSeek v3 erreicht State-of-the-Art-Leistung in Benchmarks mit deutlich weniger Rechenaufwand als vergleichbare Modelle. Dies ist auf wichtige architektonische Verbesserungen zurückzuführen: Multi-Head Latent Attention (MLA) reduziert die Größe des KV-Cache drastisch, ohne die Modellqualität zu beeinträchtigen; verbessertes Mixture-of-Experts (MoE) behebt Routing-Collapse durch verlustfreien Lastenausgleich und geteilte Experten; und Multi-Token-Prediction steigert die Trainingseffizienz und Inferenzgeschwindigkeit. Diese Verbesserungen zeigen ein tiefes Verständnis der Transformer-Architektur und weisen den Weg für große Sprachmodelle.

(epoch.ai)

KI