GATE: Ein integriertes Bewertungsmodell für den wirtschaftlichen Einfluss von KI

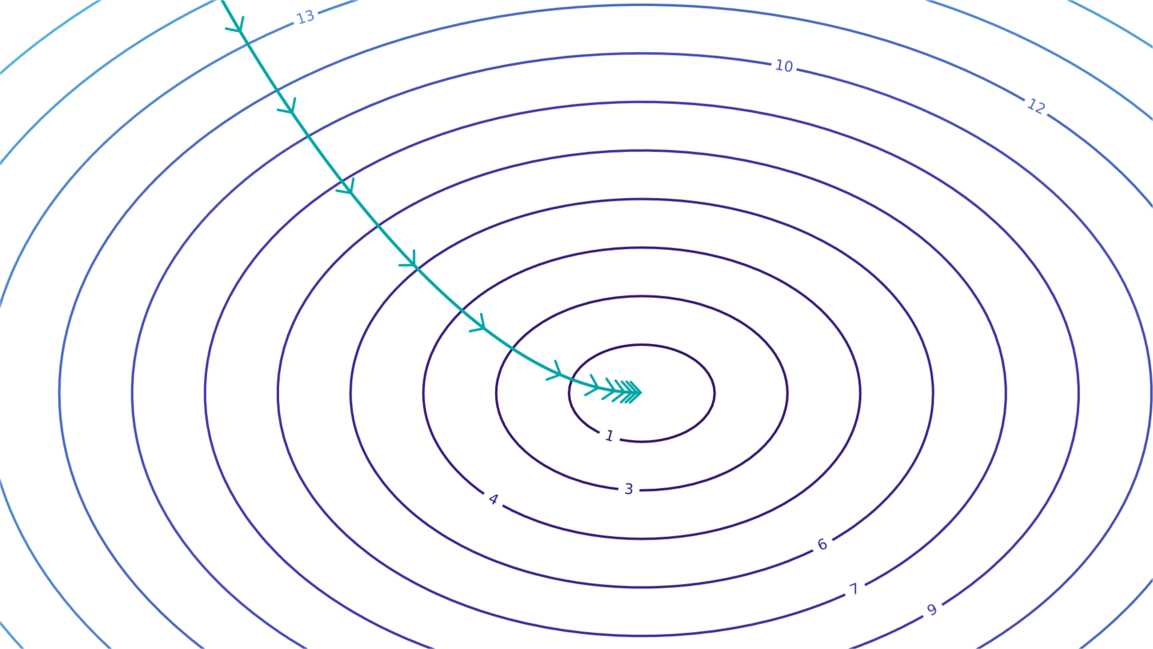

Epoch AI präsentiert GATE, ein integriertes Bewertungsmodell, das den wirtschaftlichen Einfluss von KI untersucht. Das Modell konzentriert sich auf eine Automatisierungsschleife: Investitionen fördern die Rechenleistung, was zu leistungsfähigeren KI-Systemen führt, die Aufgaben automatisieren, die Produktion steigern und die KI-Entwicklung weiter vorantreiben. Ein interaktiver Playground ermöglicht es Benutzern, Parameter anzupassen und das Verhalten des Modells in verschiedenen Szenarien zu beobachten. Die Vorhersagen sind keine Prognosen von Epoch AI, sondern konditionale Vorhersagen, die auf Annahmen basieren und hauptsächlich zur Analyse der qualitativen Dynamik der KI-Automatisierung nützlich sind.

Mehr lesen