Hört auf, KI-Agenten zu bauen!

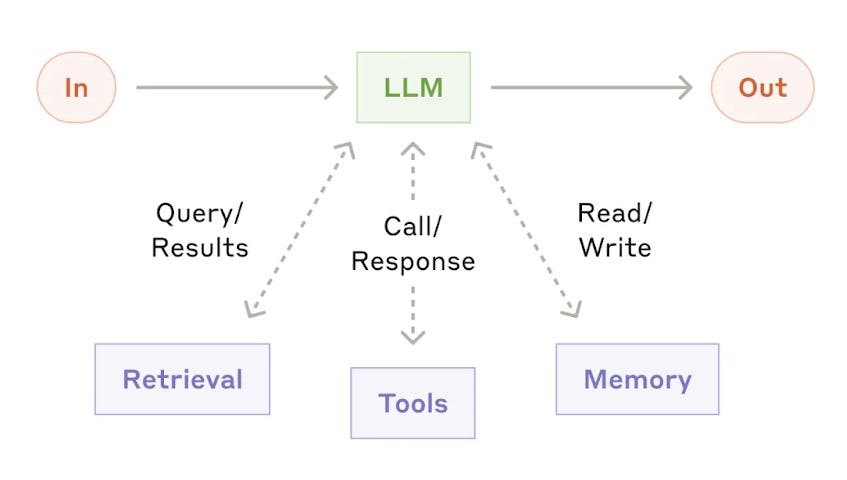

Hugo, ein Experte, der Teams bei Netflix, Meta und der US Air Force bei der Entwicklung von LLM-basierten Systemen berät, argumentiert, dass viele Teams zu früh auf KI-Agenten setzen, was zu komplexen und schwer zu debuggen Systemen führt. Er behauptet, dass einfachere Workflows wie Verkettung, parallele Verarbeitung, Routing und Orchestrator-Worker-Muster oft effektiver sind als komplexe Agenten. Agenten sind nur das richtige Werkzeug, wenn es sich um dynamische Workflows handelt, die Speicher, Delegation und Planung erfordern. Der Autor teilt fünf LLM-Workflow-Muster und betont die Bedeutung des Aufbaus von beobachtbaren und kontrollierbaren Systemen. Vermeiden Sie Agenten für stabile Unternehmenssysteme; sie eignen sich besser für Szenarien mit menschlicher Beteiligung.

Mehr lesen