Die erstaunliche Einbettungs-Kapazität von GPT-3: Hochdimensionale Geometrie und das Johnson-Lindenstrauss-Lemma

2025-09-15

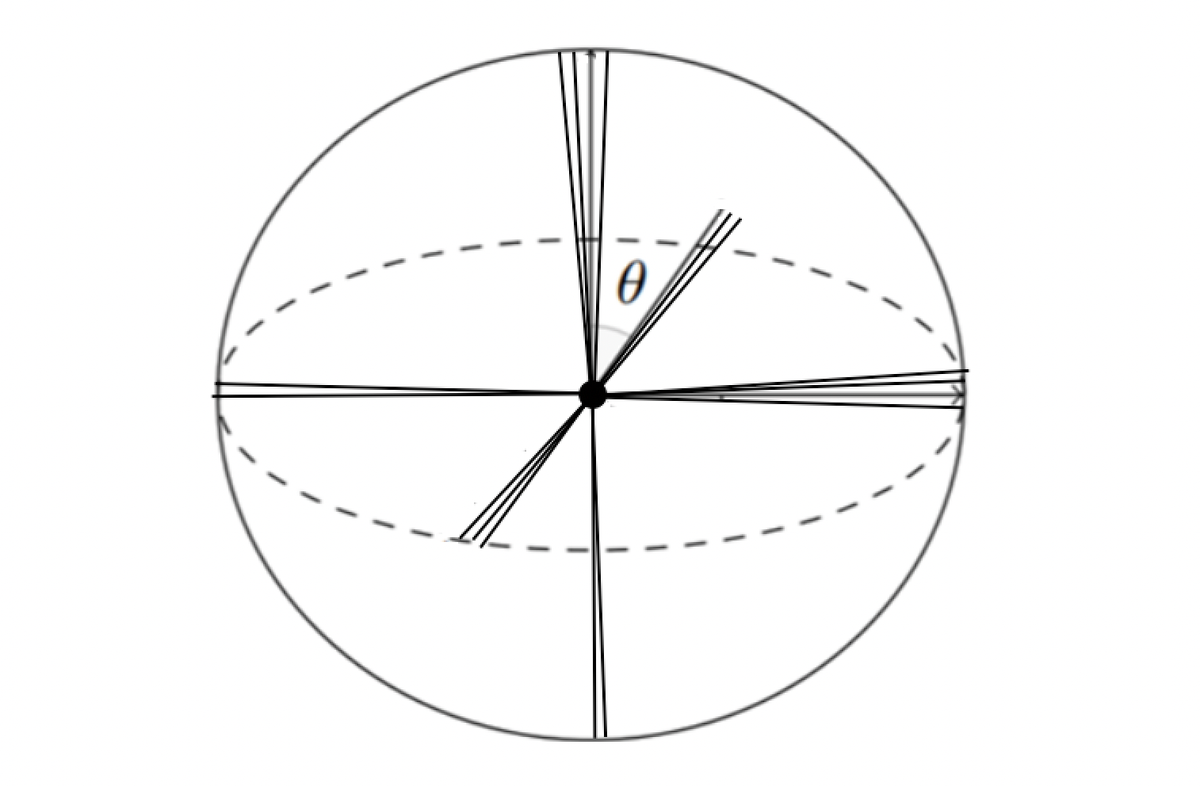

Dieser Blogbeitrag untersucht, wie große Sprachmodelle wie GPT-3 Millionen verschiedener Konzepte in einem relativ bescheidenen 12.288-dimensionalen Einbettungsraum unterbringen. Durch Experimente und die Analyse des Johnson-Lindenstrauss-Lemmas zeigt der Autor die Bedeutung von „quasi-orthogonalen“ Vektorbeziehungen in der hochdimensionalen Geometrie und Methoden zur Optimierung der Anordnung von Vektoren in Einbettungsräumen, um die Kapazität zu erhöhen. Die Forschung zeigt, dass selbst unter Berücksichtigung von Abweichungen von der perfekten Orthogonalität der Einbettungsraum von GPT-3 eine erstaunliche Kapazität besitzt, die ausreicht, um menschliches Wissen und Denken darzustellen.

Mehr lesen