LLMベースのAIエージェント、CRMテストで期待外れの結果

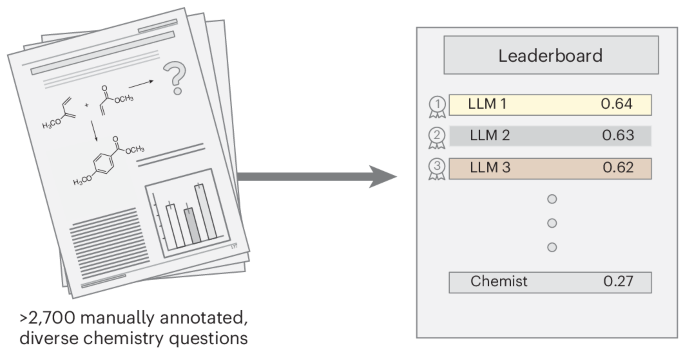

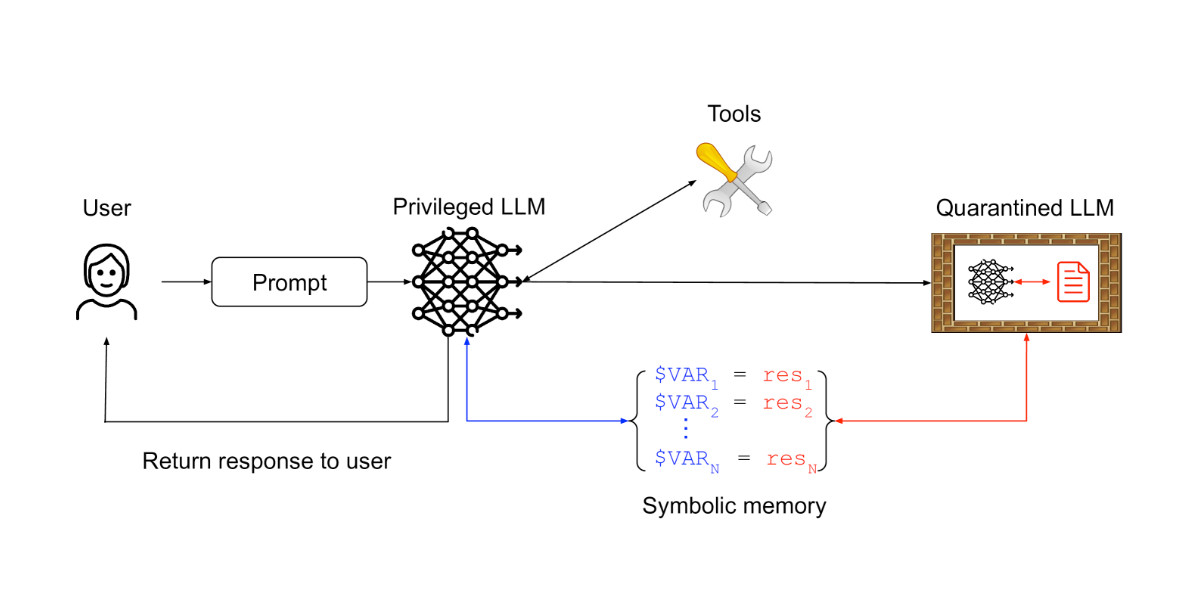

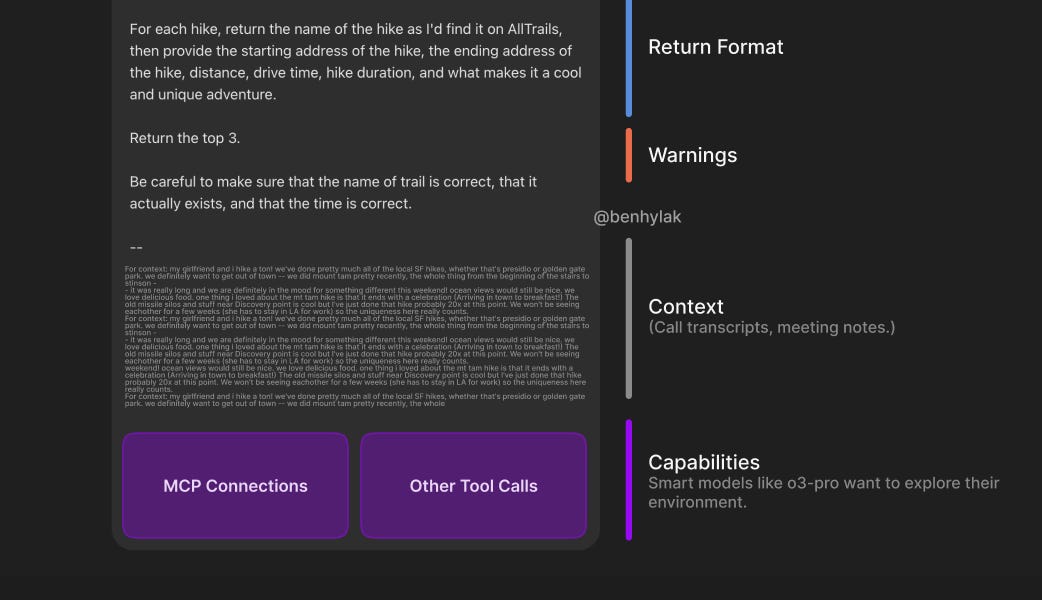

新しいベンチマークによると、大規模言語モデル(LLM)ベースのAIエージェントは、標準的なCRMテスト、特に機密性に関する点で期待以下のパフォーマンスを示しました。Salesforceの調査では、単一ステップのタスクの成功率は58%ですが、複数ステップのタスクでは35%に低下します。さらに懸念されるのは、これらのエージェントが機密情報の認識が低いことで、パフォーマンスに悪影響を及ぼしていることです。この研究は、既存のベンチマークの限界を浮き彫りにし、現在のLLMの機能と現実世界の企業ニーズとの間に大きなギャップがあることを明らかにしています。これは、効率性向上のためAIエージェントに依存する開発者や企業にとって懸念材料となります。