DeepSeek与芯片出口管制:一场AI军备竞赛

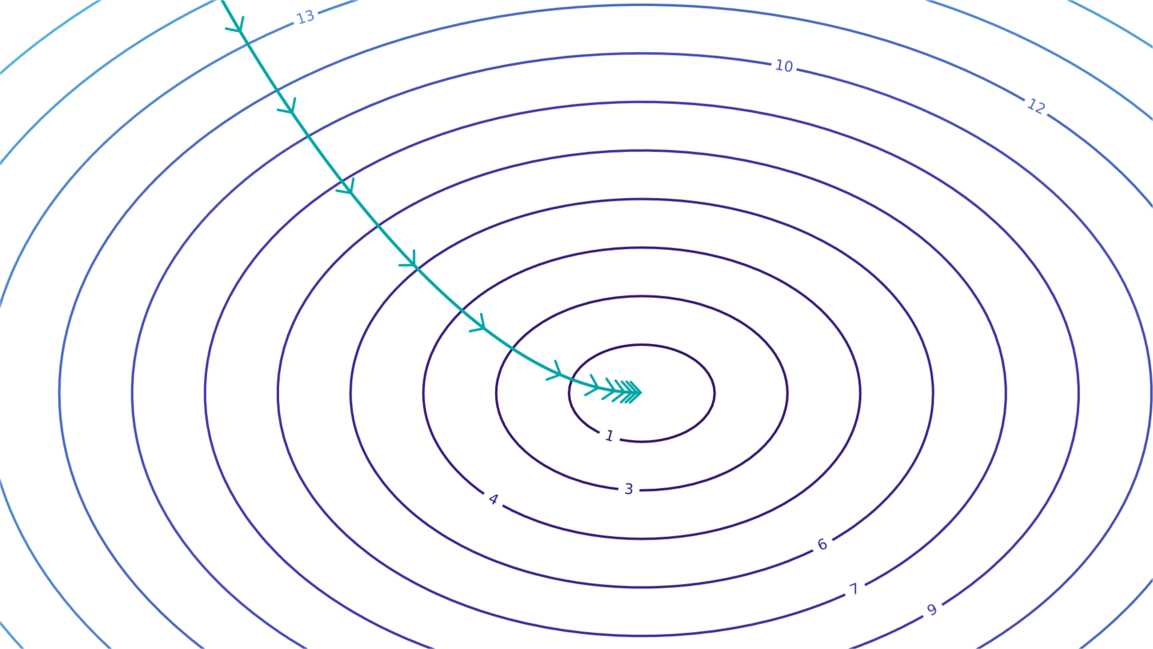

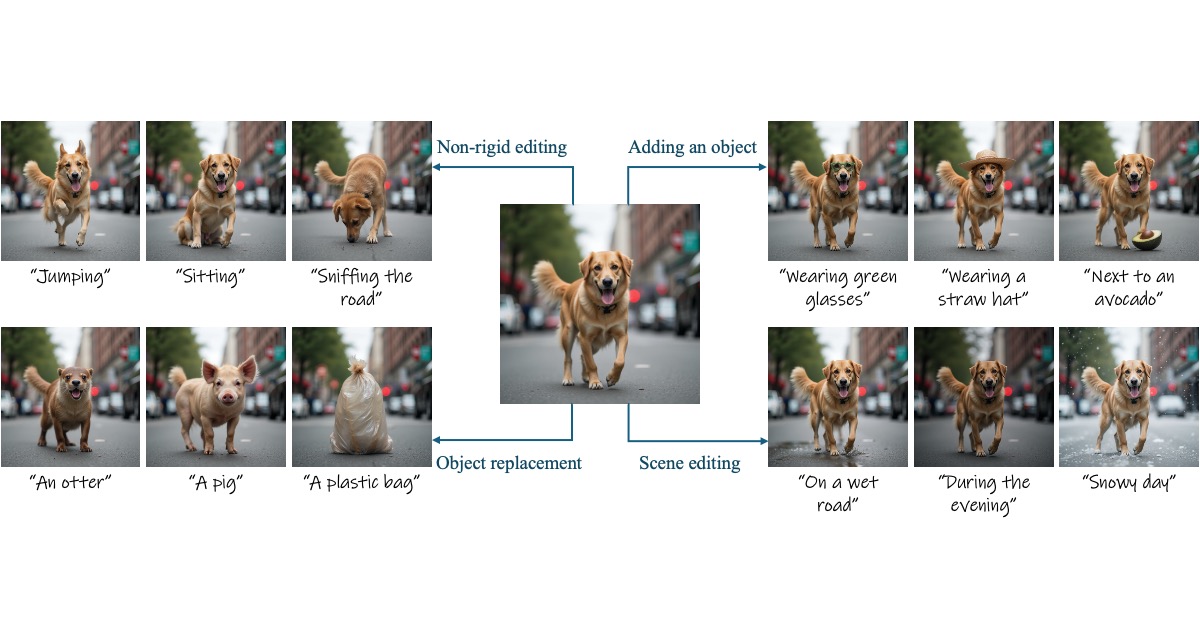

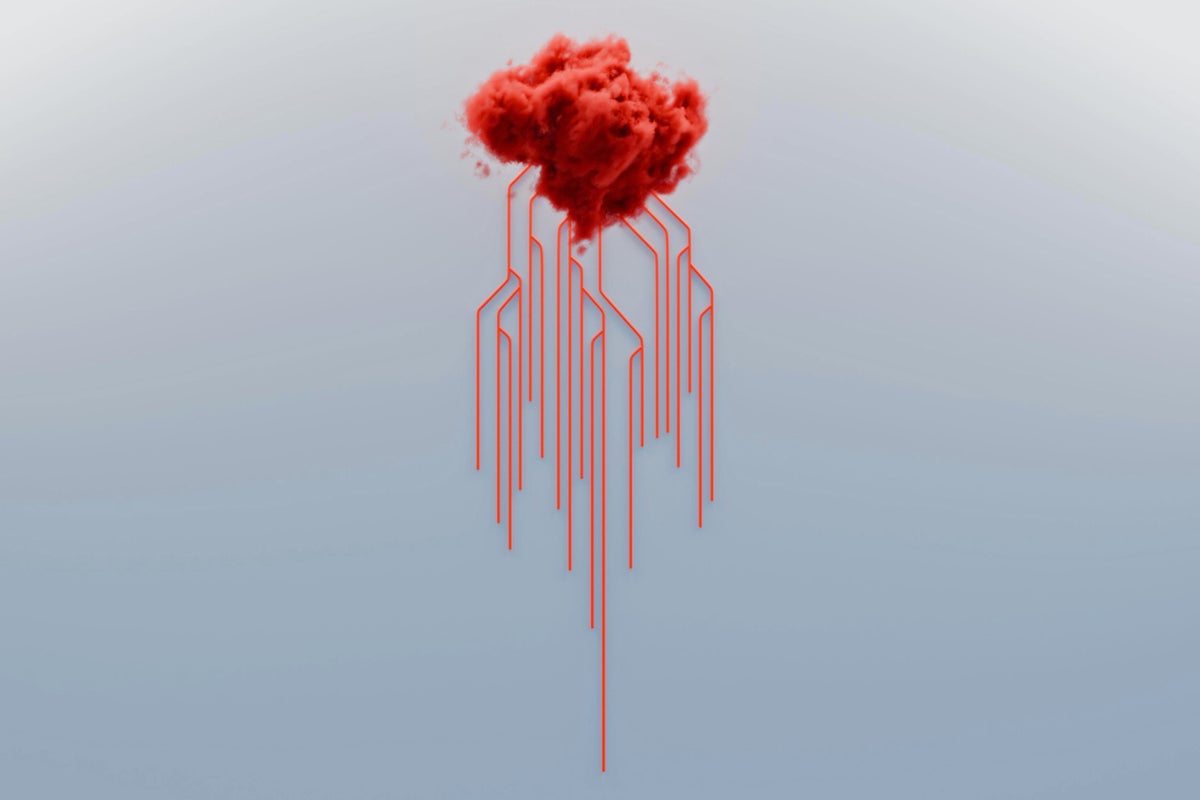

Dario Amodei的文章探讨了中国AI公司DeepSeek的崛起及其对美国芯片出口管制政策的影响。DeepSeek凭借其高效的工程创新,在成本更低的情况下,其模型性能接近美国领先的AI模型。Amodei认为,DeepSeek的成功并非对出口管制的否定,反而突显了这些政策的重要性。他分析了AI发展的三个动态:规模定律、曲线转移和范式转变,认为DeepSeek的进展符合成本下降的预期趋势。最终,Amodei强调,出口管制对于防止中国获得大量芯片,从而避免AI领域形成两极格局至关重要,这关乎美国在全球舞台上的领导地位。