分类: AI

Glicol:一款革新性的AI图像生成工具

Glicol并非简单的图像生成器,它更像是一位数字艺术家,通过独特的算法和模型,将文本描述转化为风格迥异、细节丰富的图像。它不仅仅局限于常见的图像风格,还能根据用户的细微调整生成出令人惊艳的作品。Glicol的出现,预示着AI图像生成领域迈入了新的纪元,为艺术家和设计师提供了前所未有的创作工具。

AI训练无需巨型数据中心?

科技巨头们正竞相建设拥有数万甚至数十万GPU的巨型数据中心来训练AI模型。然而,《经济学人》的一篇文章指出,这种趋势可能很快就会改变。未来,AI模型训练或许不再需要庞大的硬件设施,甚至可以完全摆脱专用硬件的依赖。分布式计算和新型算法的进步将使得在普通计算机网络上训练复杂的AI模型成为可能,这将大大降低AI研究的门槛,并促进AI技术的普及。

AI智能体将超越人类成为主要应用用户

Accenture的一份报告预测,到2030年,AI智能体将成为大多数企业内部数字系统的主要用户,到2032年,与智能体的互动将超过应用程序成为消费者在智能设备上花费时间的首要方式。这标志着科技领域一个关键转折点——“二元大爆炸”,AI基础模型突破自然语言障碍,改变了我们设计、使用和运行技术系统的方式。未来发展将集中在智能系统、数字核心和生成式用户界面三个领域,这些系统将基于高度可组合和模块化的构建块。报告建议企业内部尝试使用AI智能体,从小规模任务开始,逐步扩展功能和数据访问权限,最终构建面向外部的智能体。同时,也强调了确保AI智能体透明度、可解释性和可信度的重要性。

Voyage AI发布全新代码检索模型Voyage-code-3:更高精度,更低成本

Voyage AI发布了新一代代码检索模型Voyage-code-3,在32个数据集上平均超越OpenAI-v3-large和CodeSage-large 13.80%和16.81%。通过Matryoshka学习和量化(int8和二进制),Voyage-code-3显著降低了存储和搜索成本,同时保持了检索质量。它支持2048、1024、512和256维嵌入,以及多种量化格式,并具有32K token上下文长度。Voyage-code-3在代码检索方面表现出色,尤其是在处理算法推理和细微语法规则方面,其训练数据涵盖了海量代码和文本数据,并经过严格评估,确保了模型的鲁棒性和准确性。

AI驱动2D转3D模型生成器:3Dify

3Dify是一个免费的AI驱动2D到3D模型生成器,只需上传2D图像,AI即可自动去除背景并生成高质量的3D模型,支持GLB和高斯格式输出,可用于游戏开发、3D打印等商业用途。虽然目前仅支持单物体图像转换,且复杂图像可能需要后期调整,但其易用性和免费特性使其成为广大创作者的理想工具。

用GPT-4解决350张高度相似图片的识别难题

一家小型AI公司面临一个棘手的图像识别挑战:需要识别350张高度相似的汽车插图。传统的计算机视觉方法和增强现实技术均告失败。团队尝试了MobileNet迁移学习和数据增强,但效果不佳。最终,他们巧妙地结合了基于KNN的图像嵌入搜索和GPT-4,将候选图像提交给GPT-4进行最终匹配。虽然并非完美,但该方案显著提高了识别准确率,并成功应用于博物馆应用程序中,也为公司主产品线带来了改进。这表明大型语言模型正日益成为产品开发中的多功能工具,简化了AI应用流程。

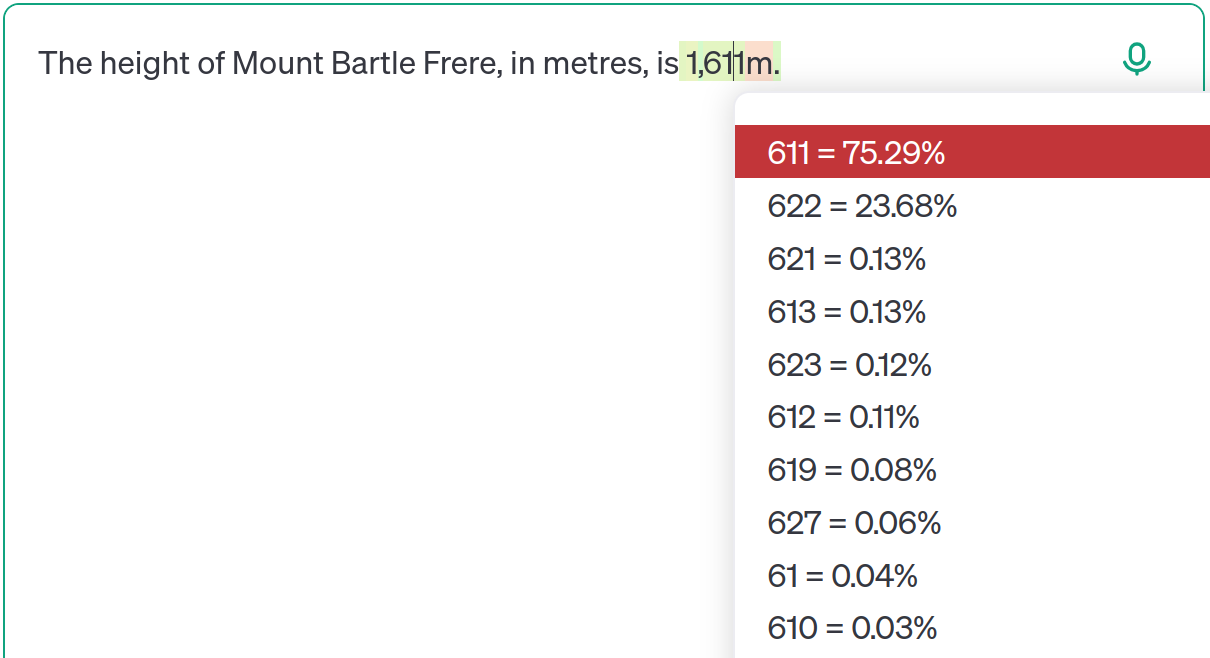

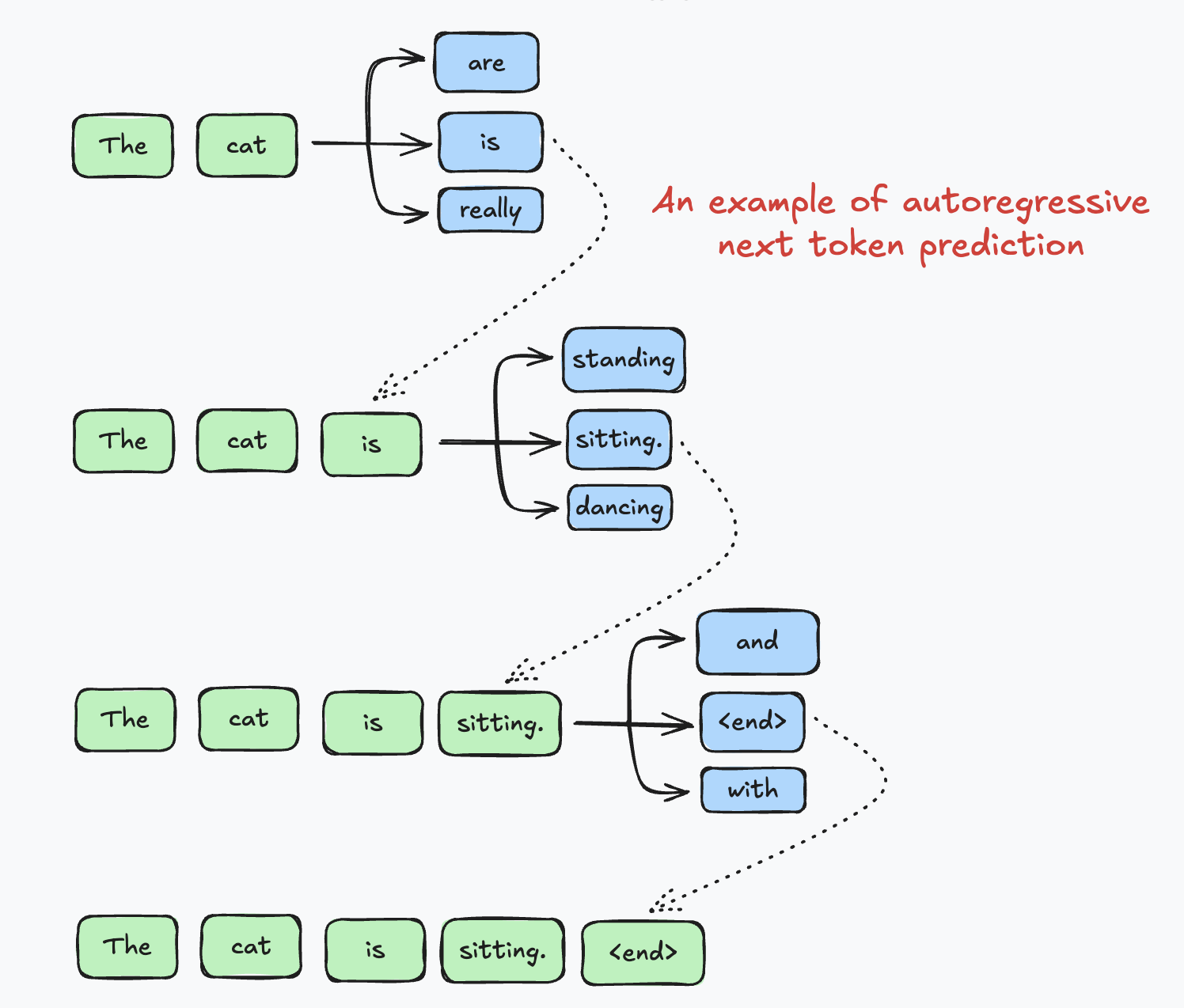

大型语言模型输出的熵:一个信息论视角

本文从信息论的角度探讨了大型语言模型(如ChatGPT)的输出。作者通过计算每个输出token的熵,来衡量模型对下一个token预测的确定性。实验结果表明,在句子结尾或单词片段处,熵值较低,模型预测较为确定;而在描述性语句中,熵值较高,模型预测的不确定性更大。作者还比较了低熵和高熵情况下模型选择的token类型,发现低熵通常与事实陈述(包含专有名词)相关,而高熵则与描述性语句相关。最后,作者用泰米尔语的例子进行了补充说明,并强调了辨别信息真伪的重要性。

AI工具对批判性思维的冲击:认知卸载的利与弊

一项针对666名参与者的混合方法研究发现,频繁使用AI工具与批判性思维能力呈显著负相关,认知卸载是其中的关键因素。年轻参与者对AI工具的依赖性更高,批判性思维能力也较低。这项研究强调了AI工具依赖的潜在认知成本,并为减轻其对批判性思维的不利影响提供了教育策略建议。

FurtherAI:用AI革新保险业流程

FurtherAI,一家获得Y Combinator等顶级风投青睐的初创公司,致力于利用AI自动化保险工作流程。他们开发的AI伙伴能够处理非结构化文档、进行数据录入和拨打电话,目标是让AI达到与人类员工同等可靠、适应性和学习能力。目前他们正在招聘多个职位,包括产品设计师、应用研究工程师和软件工程师等,为有志于AI和保险行业的人才提供绝佳机会。

大型语言模型中的过时信息:逻辑矛盾的根源

大型语言模型(LLM)如ChatGPT,其训练数据包含大量过时或冲突信息。文章以澳大利亚昆士兰州最高山巴特尔弗雷尔山的精确高度为例,探讨了LLM如何处理此类冲突信息。研究发现,LLM并非总是给出最新答案,而是根据其训练数据中不同信息的概率分布进行预测。即使是最新的GPT-4o模型,也可能因为提示词的细微变化而输出过时信息。这并非简单的“幻觉”,而是模型学习了多种可能性并根据上下文调整概率的结果。作者呼吁关注LLM的局限性,避免过分依赖,并强调透明度的重要性。

让大型语言模型学会“焦虑”:深度思考Prompt引爆X平台

博主Maharshi在X平台上发布了一个独特的Prompt,引导大型语言模型(LLM)在回答问题前进行“深度思考”。该Prompt鼓励LLM模拟人类的思考过程,探索多种可能性,并质疑自身假设,最终得出结论。此方法的灵感源于OpenAI的o1模型,该模型通过强化学习进行训练,能在推理过程中花费更多时间“思考”。Maharshi设计的Prompt包含四个核心原则:探索优先于结论、深入推理、展现思考过程和坚持不懈。通过在Prompt中加入特定格式和引导性语句,LLM能够生成更具逻辑性和准确性的答案,但同时也需要注意LLM可能出现的幻觉问题。

微软开源140亿参数大模型Phi-4:兼顾性能与效率

微软发布了其最新的开源语言模型Phi-4,这是一个拥有140亿参数的强大模型。它基于合成数据集、公共领域网站数据和学术书籍及问答数据集构建,并经过严格的微调和优化,确保指令遵循准确性和安全性。Phi-4 的上下文长度为16k tokens,主要应用于需要内存/计算受限环境、低延迟场景以及推理和逻辑能力的通用AI系统和应用(主要为英文)。微软强调,开发者在使用Phi-4时应考虑语言模型的局限性,并评估和减轻其在高风险场景中的准确性、安全性和公平性问题。

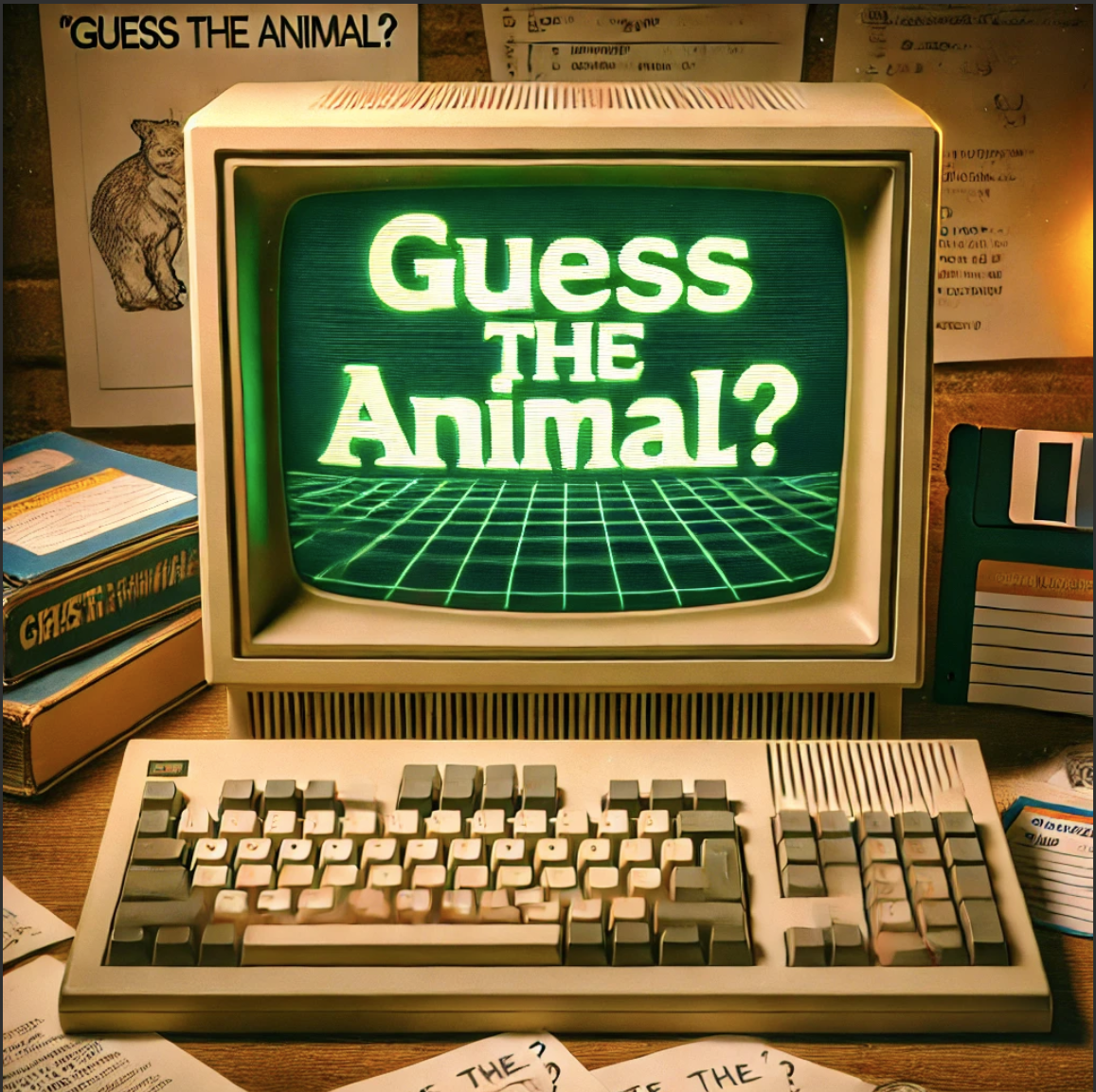

80年代的AI先驱:一个简单的猜动物游戏

本文讲述了一个在80年代用BASIC语言编写,名为“猜动物”的简单游戏。这个游戏通过决策树实现,用户回答“是”或“否”,程序逐步缩小范围,最终猜出动物。更重要的是,它能够从错误中学习,将新的问题和答案添加到知识库中,并支持进度保存和加载。这展现了即使在AI技术不发达的年代,程序员就已经开始探索可训练算法的思想,为现代机器学习奠定了基础。作者用C++重写了该算法,并对比了两种语言实现的优缺点。

ChatGPT的“前额叶皮层问题”:一个有趣的AI认知测试

作者通过让ChatGPT进行钟表绘画测试等一系列认知测试,发现其表现出类似人类前额叶皮层受损患者的症状,例如空间组织能力差、计划能力不足等。虽然ChatGPT能够编写程序生成正确的钟表图像,但在直接绘画或文本描述方面却屡屡出错。这引发了作者对AI认知能力、监督机制以及赋予AI高级认知功能的伦理风险的思考。最终结论是,当前的AI模型难以胜任所有人类任务,并提出了关于AI治理和立法的建议。

机器人与AI的复杂性:误解与真相

本文探讨了机器人技术和人工智能复杂性方面的常见误解。作者指出,人们常常将两者混为一谈,认为人工智能的进步可以直接转化为机器人技术的突破。然而,作者认为,机器人技术面临的挑战在于传感器运动控制的复杂性,这远比人们想象的要困难。这与莫拉维克悖论相符:低级感知运动技能比高级推理更难复制。作者进一步解释了当前人工智能解决方案依赖于强大的计算能力和海量数据,而这些条件在机器人领域难以满足。文章还探讨了硬件限制、数据瓶颈以及模型运行速度等问题,并对未来机器人技术的发展方向进行了展望。

AI专家预测未来AI/LLM发展趋势

Simon Willison在Oxide and Friends播客中分享了他对未来1年、3年和6年AI/LLM发展的预测。他认为,通用AI代理在短期内难以实现,但代码和研究助手类应用将会蓬勃发展。3年内,AI辅助的调查性报道可能会获得普利策奖,同时更严格的隐私法律也会出台。6年后,AI可能会创造出令人惊叹的艺术作品,但也可能引发大规模的社会动荡,这取决于AGI/ASI的发展和经济影响。Willison强调,他对这些预测缺乏十足的信心,并表示这将是一个有趣的回顾未来发展的参考点。

仅需3秒!全球首个AI语音克隆技术

AnyVoice推出全球首个仅需3秒音频即可生成超逼真语音克隆的AI技术。这项突破性的技术彻底改变了语音克隆的效率,无需冗长的录音。目前支持英语、中文、日语和韩语。用户只需在安静环境下自然朗读3-10秒的音频,即可获得高质量的语音克隆。该技术可用于商业用途,但需购买商业许可证。

LLM系统2推理:元链式思考的突破

研究人员提出了一种名为“元链式思考”(Meta-CoT)的新框架,它扩展了传统的链式思考(CoT),通过显式建模得出特定CoT所需的底层推理过程。该框架利用过程监督、合成数据生成和搜索算法生成元CoT,并提出了一种具体的训练流程,结合指令微调和线性化搜索轨迹以及强化学习后训练。这项工作为在大型语言模型中实现元链式思考提供了一个理论和实践路线图,为人工智能中更强大、更人性化的推理铺平了道路。

智能体还不够:AI 发展的新视角

近期arXiv上的一篇论文《智能体还不够》指出,尽管AI智能体正经历复兴,但仅依靠生成式AI不足以使其取得更大成功。作者认为,未来有效的AI生态系统需要包含三个关键部分:智能体(Agents)、模拟用户偏好和行为的模拟器(Sims)以及直接与用户交互并协调任务执行的助手(Assistants)。通过研究以往智能体发展经验,文章强调了构建更有效、更可持续的AI智能体系统的必要性。

2025年AI、机器人和太空探索预测回顾:泡沫破裂?

MIT人工智能实验室创始人Rodney Brooks在其2025年新年预测回顾中,对2018年做出的关于自动驾驶汽车、机器人、人工智能和太空探索的预测进行了总结。他指出,AI领域的炒作严重扭曲了人们对现实的理解,许多关于AI即将取代人类工作的预测并未实现。自动驾驶技术进展缓慢,完全自动驾驶汽车的承诺并未兑现;机器人技术同样面临挑战,人形机器人距离实际应用还有很长的路要走;太空探索方面,虽然商业航天取得一定进展,但仍远未达到预期。Brooks强调,理性评估技术发展,避免盲目跟风至关重要,真正的技术突破需要时间和持续的努力。

OpenAI封禁利用ChatGPT打造机器人哨兵枪的工程师

一位名为STS 3D的工程师利用OpenAI的ChatGPT API开发了一款能够根据语音指令瞄准和射击的机器人哨兵枪。该系统引发了关于AI武器化伦理的广泛讨论。OpenAI迅速回应,以违反其使用政策为由,封禁了该工程师,并强调其政策禁止将服务用于开发或使用武器。尽管OpenAI去年删除了关于军事用途的语言限制,但仍禁止用户利用其服务伤害他人。这一事件凸显了AI技术潜在的危险性,以及对其应用进行严格监管的必要性。

扎克伯格批准Meta使用盗版数据训练Llama模型,引发版权诉讼

Meta首席执行官扎克伯格被指控批准其Llama AI模型团队使用包含盗版电子书和文章的数据集LibGen进行训练。原告,包括畅销书作家莎拉·西尔弗曼和塔-内希西·科茨,指控Meta侵犯版权。Meta辩称其受合理使用原则保护,但原告认为Meta通过删除版权信息试图掩盖其侵权行为,甚至通过BT下载LibGen,进一步加剧了侵权行为。此案目前仅针对Meta最早期的Llama模型,最终结果仍有待法院裁决,但这起诉讼已经对Meta的声誉造成了负面影响。

英伟达发布Cosmos WFM:基于物理的开放世界模型

在CES 2025上,英伟达发布了Cosmos World Foundation Models (Cosmos WFMs),这是一系列能够预测和生成物理感知视频的AI世界模型。这些模型分为Nano、Super和Ultra三个等级,大小从40亿到140亿参数不等,可用于机器人、自动驾驶等领域。虽然英伟达称其为“开放”模型,但并未完全开源,其训练数据来源也引发争议,据称使用了未经授权的YouTube视频。尽管如此,该模型已获得多家公司的青睐,用于各种应用场景。

NeuralSVG:基于隐式神经表示的文本转矢量图生成

NeuralSVG 是一种新颖的文本转矢量图生成方法,它利用隐式神经表示(类似于NeRF)将整个场景编码到小型MLP网络的权重中,并通过分数蒸馏采样(SDS)进行优化。通过引入基于dropout的正则化技术,NeuralSVG 能够生成具有分层结构且可编辑的有序形状的矢量图形,并支持动态调整背景颜色、长宽比等参数。实验结果表明,NeuralSVG 在生成结构化和灵活的SVG方面优于现有方法。

YC孵化公司Two Dots招募机器学习工程师

Y Combinator孵化的金融科技公司Two Dots正在招聘机器学习工程师,年薪20-25万美元。Two Dots利用AI技术革新贷款流程,致力于预防类似2008年金融危机的事件。该职位需要维护机器学习管道(文档图像、自然语言、数字),并具备良好的团队合作能力。这是一个混合办公职位,位于旧金山,每周需要5天在办公室工作。

SAT求解器研究:从蛮力到现代算法

本文探讨了SAT求解器的演进,从简单的暴力求解算法到基于Davis-Putnam过程和冲突驱动子句学习(CDCL)的复杂算法。文章比较了不同算法的优缺点,并介绍了近年来在SAT求解器性能提升方面取得的一些进展,例如一致性闭包、子句等价扫描和有界变量添加等技术。作者还提供了用Python编写的不同SAT求解器的示例代码,包括蛮力求解器、基于Davis-Putnam过程的求解器以及基于给定子句循环的求解器。最后,文章讨论了部分求值技术在SAT求解器中的应用,并对未来研究方向进行了展望。

重温Barricelli的细胞自动机:生命的自发生成

本文探讨了Nils Aall Barricelli在约翰·康威之前15年开创的细胞自动机研究。Barricelli的“共生有机体”模型在一个有限的环形一维空间中,通过简单的碰撞消除、位置复制和变异规则,模拟了不同元素的运动和相互作用。模拟结果显示,即使规则简单,也能自发产生稳定的周期性模式,类似于生命的自发生成。作者深入分析了模式的稳定性,并提出了将宇宙早期模拟与生命起源模拟结合的猜想,试图寻找生命起源的更有效方法。

NVIDIA发布Project DIGITS:人人可用的AI超级计算机

英伟达发布了Project DIGITS,一款基于Grace Blackwell超级芯片的个人AI超级计算机。这款售价3000美元起的设备,让AI研究人员、数据科学家和学生都能轻松访问强大的AI计算能力。GB10超级芯片提供高达1 petaflop的AI性能,能够运行2000亿参数的大型语言模型。用户可以在自己的桌面系统上开发和运行模型,然后无缝部署到云或数据中心基础设施上。Project DIGITS将AI计算能力带给大众,推动AI普及化。

谷歌DeepMind组建“世界模型”AI团队,剑指AGI

/cdn.vox-cdn.com/uploads/chorus_asset/file/25263501/STK_414_AI_A.jpg)

谷歌DeepMind正在组建一个新的AI研究团队,专注于开发能够模拟物理环境的“世界模型”。该团队由前OpenAI Sora项目联合负责人Tim Brooks领导,目标是利用大规模预训练视频和多模态数据,推动AGI发展。此举将助力游戏、机器人训练以及其他领域,例如视觉推理和模拟、具身智能体的规划以及实时互动娱乐。 这标志着谷歌在AGI竞赛中加紧了步伐,与OpenAI等竞争对手展开角逐。