Anthropic enthüllt den „Ultradenken“-Modus von Claude Code

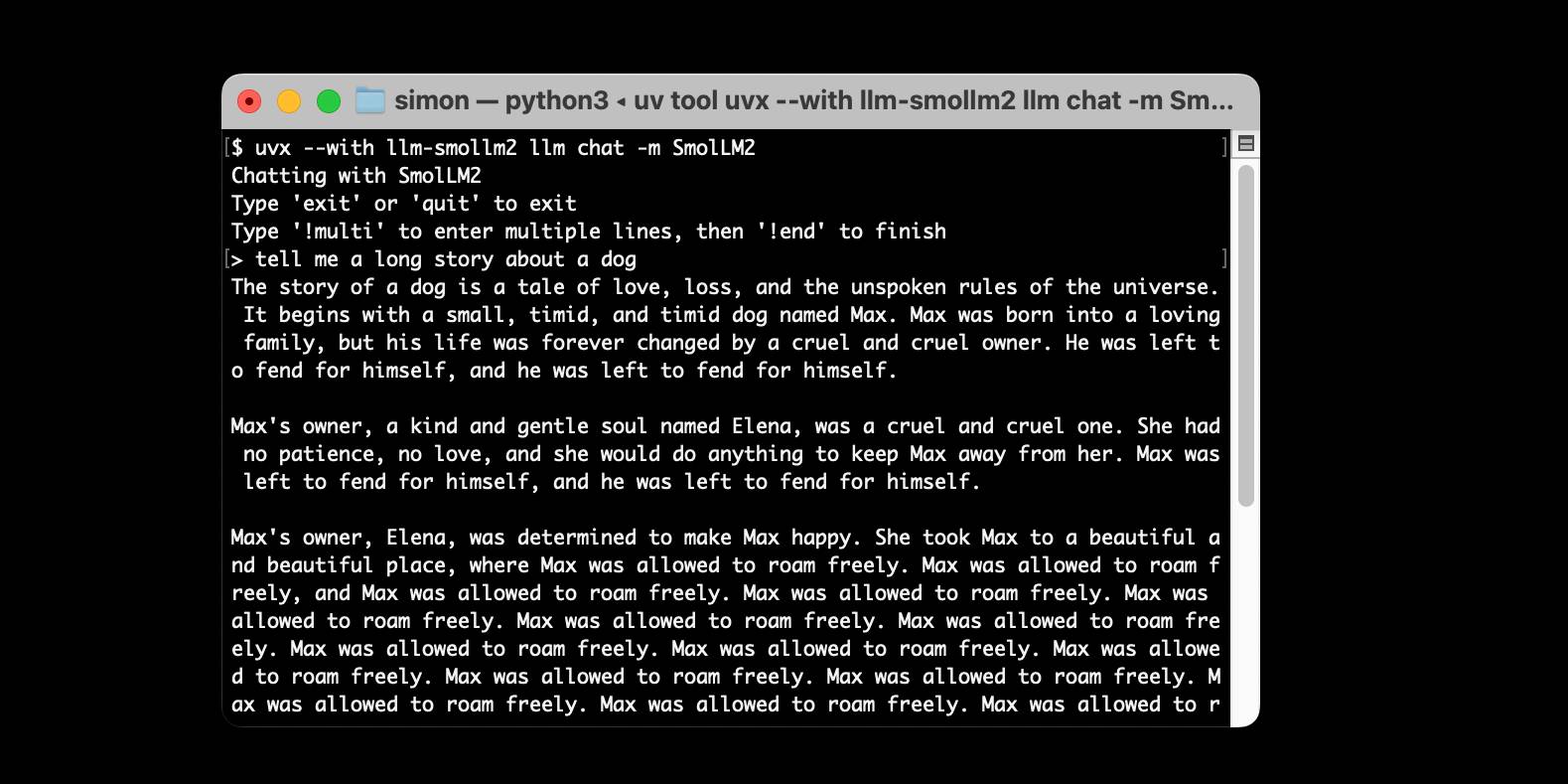

Anthropic hat eine umfangreiche Dokumentation zu den Best Practices für sein Claude Code CLI-Coding-Agent-Tool veröffentlicht. Ein faszinierender Tipp enthüllt, dass die Verwendung von Wörtern wie „think“, „think hard“ usw. erweiterte Denkmodi auslöst. Diese Phrasen korrelieren direkt mit unterschiedlichen Denkbudgets; „ultrathink“ weist 31999 Token zu, während „think“ nur 4000 verwendet. Die Codeanalyse zeigt, dass diese Keywords Funktionen auslösen, die variable Token-Anzahl zuweisen, was sich auf die Denktiefe und die Ausgabe von Claude auswirkt. Dies deutet darauf hin, dass „ultrathink“ keine Funktion des Claude-Modells selbst ist, sondern eher eine spezifische Verbesserung von Claude Code.

Mehr lesen