Die platonische Repräsentationshypothese: Auf dem Weg zur universellen Einbettungsinversion und Kommunikation mit Walen

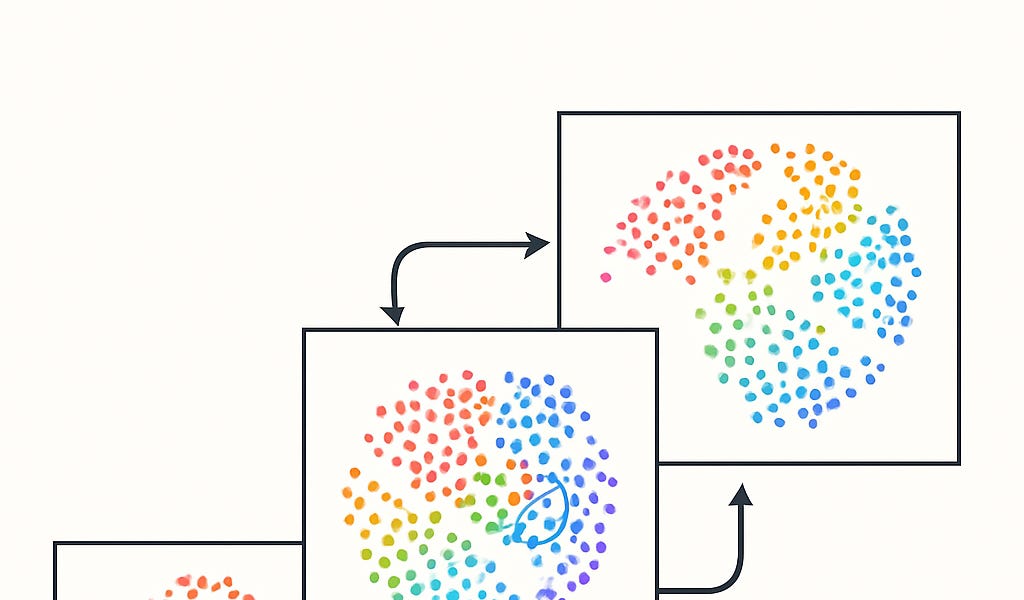

Forscher haben entdeckt, dass große Sprachmodelle mit zunehmender Größe in einen gemeinsamen zugrundeliegenden Repräsentationsraum konvergieren, ein Phänomen, das als „Platonische Repräsentationshypothese“ bezeichnet wird. Dies deutet darauf hin, dass unterschiedliche Modelle unabhängig von der Architektur dieselben Merkmale lernen. Der Artikel verwendet das Spiel „Mussolini oder Brot“ als Analogie, um diese gemeinsame Repräsentation zu erklären, und unterstützt sie weiter durch die Kompressionstheorie und die Generalisierungsfähigkeit des Modells. Kritisch ist, dass die Forscher auf der Grundlage dieser Hypothese vec2vec entwickelt haben, eine Methode zur unüberwachten Konvertierung zwischen Einbettungsräumen verschiedener Modelle, die eine hochpräzise Text-Einbettungsinversion erreicht. Zukünftige Anwendungen könnten das Dekodieren alter Texte (wie Linear A) oder die Übersetzung der Sprache von Walen umfassen und neue Möglichkeiten für das interlinguistische Verständnis und den Fortschritt der KI eröffnen.

Mehr lesen