Sechs Wege, die Bestie zu zähmen: Kontextfehler in LLMs mindern

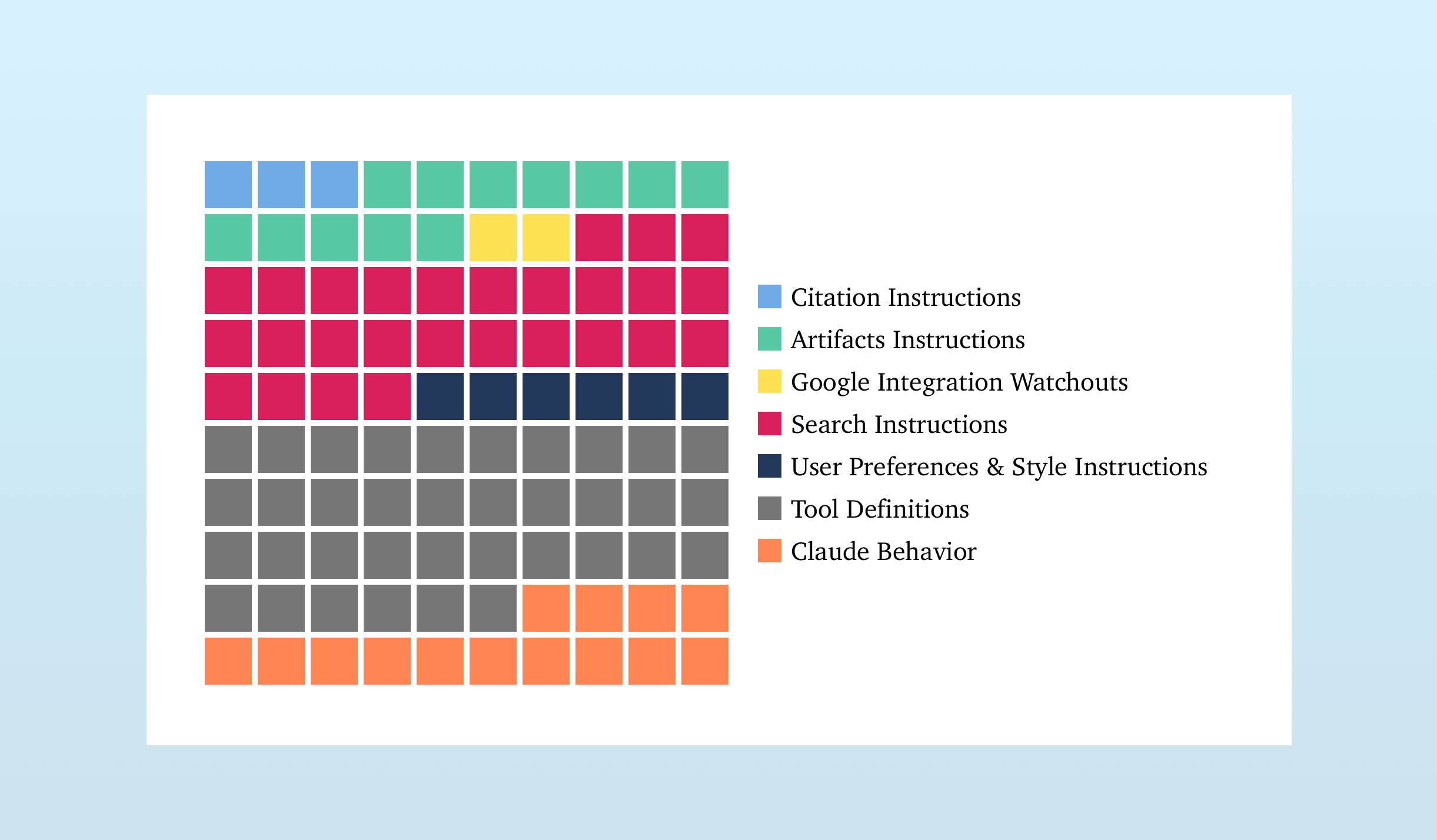

Große Sprachmodelle (LLMs) verfügen über immer größere Kontextfenster, aber zu viel Kontext kann die Leistung beeinträchtigen. Dieser Artikel beschreibt sechs Strategien zur Minderung von Kontextfehlern: Retrieval-Augmented Generation (RAG) zum selektiven Hinzufügen von Informationen; Tool Loadout zur Auswahl relevanter Tools; Kontextquarantäne zur Isolierung von Kontexten in separaten Threads; Kontextbeschneiden zum Entfernen irrelevanter Informationen; Kontextzusammenfassung zum Verdichten des Kontexts; und Kontext-Offloading zum Speichern von Informationen außerhalb des LLM-Kontexts. Studien zeigen, dass diese Methoden die Genauigkeit und Effizienz des Modells deutlich verbessern, insbesondere beim Umgang mit vielen Tools oder komplexen Aufgaben.

Mehr lesen