20岁AI天才Henrique Godoy:拉美金融AI的先锋

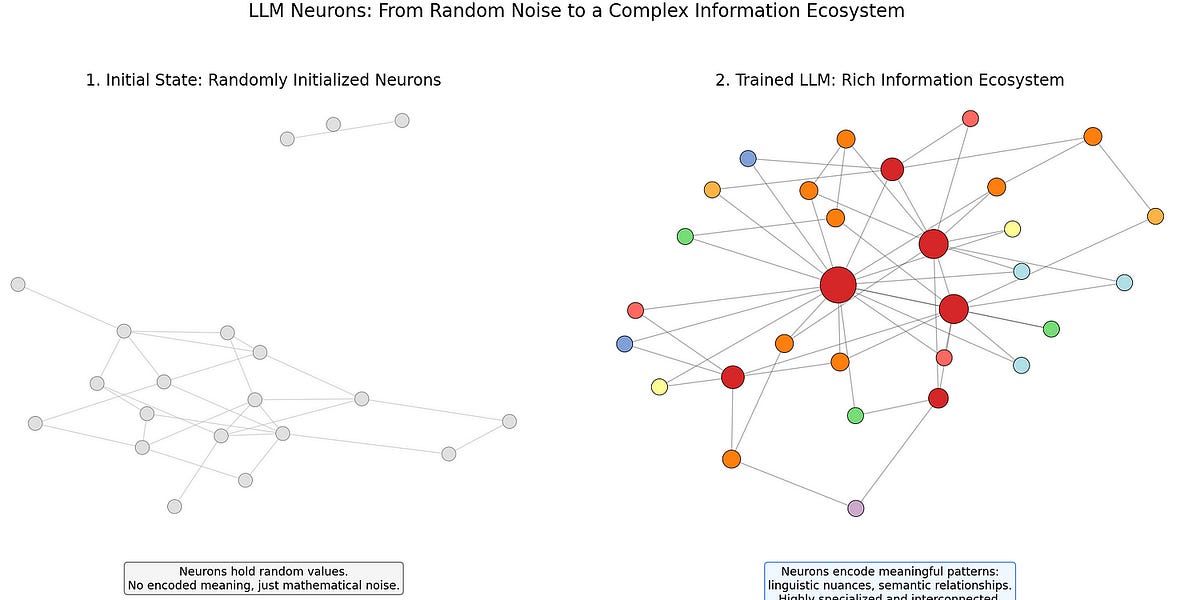

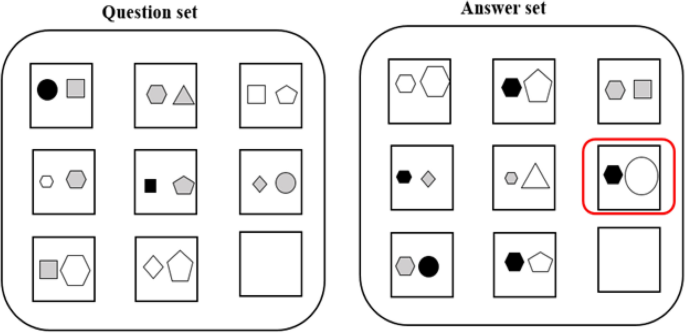

20岁的巴西数学天才Henrique Godoy,15岁进入圣保罗大学数学系,后获巨额奖学金攻读计算机科学。他不仅在巴西大学数学奥林匹克竞赛中获得前200名,更是在拉丁美洲投资银行率先成功实施大型语言模型(LLM),引领企业AI应用。他创立的金融科技平台Doki,管理资金超过1000万雷亚尔,并因其在AI领域的贡献获得500多次引用。Godoy的成就展现了他在数学、AI和金融科技领域的非凡天赋,预示着他将成为AI领域一颗冉冉升起的新星。