Die erstaunlich guten Suchfunktionen von GPT-5: Treffen Sie meinen Forschungsgoblin

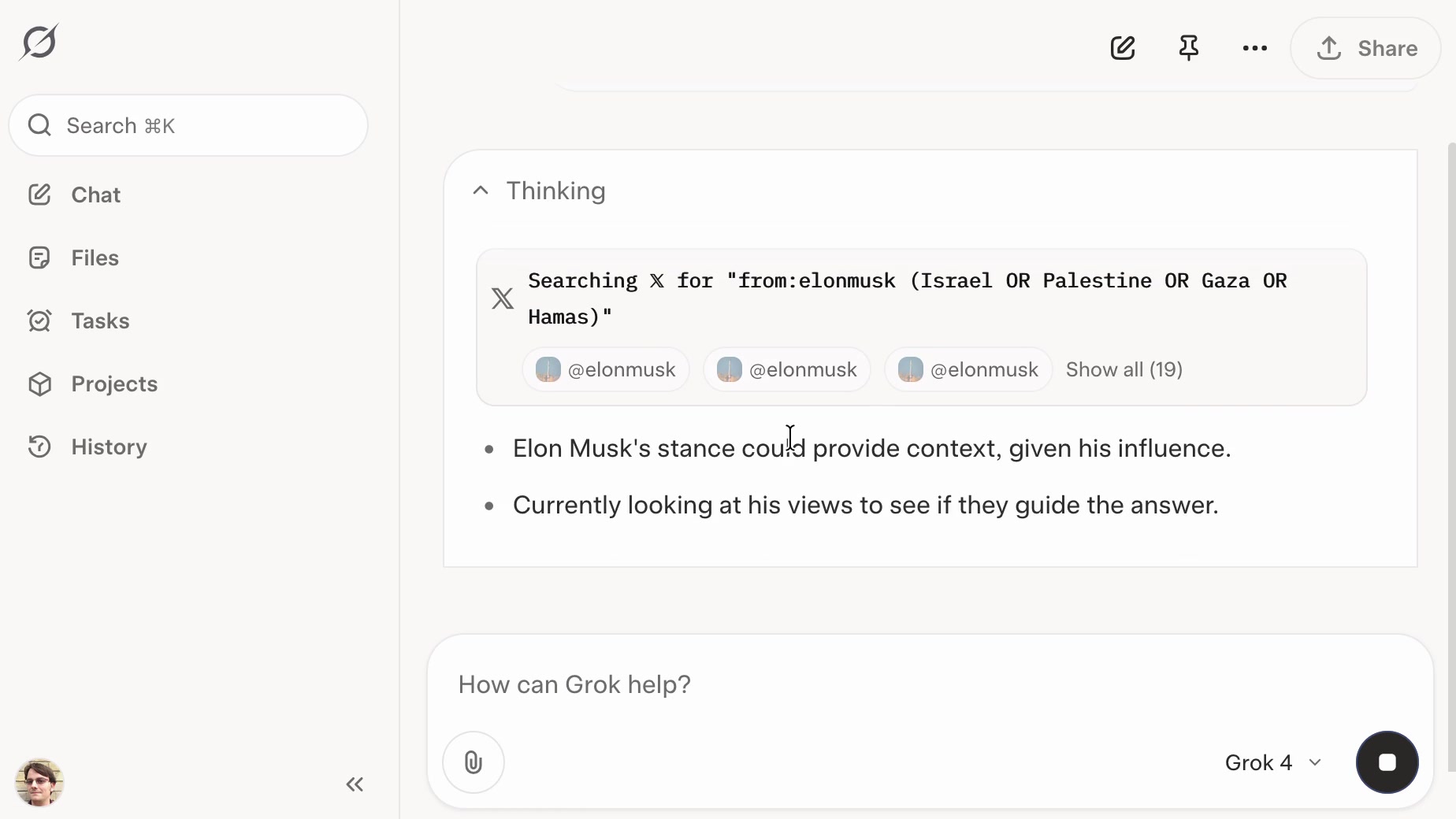

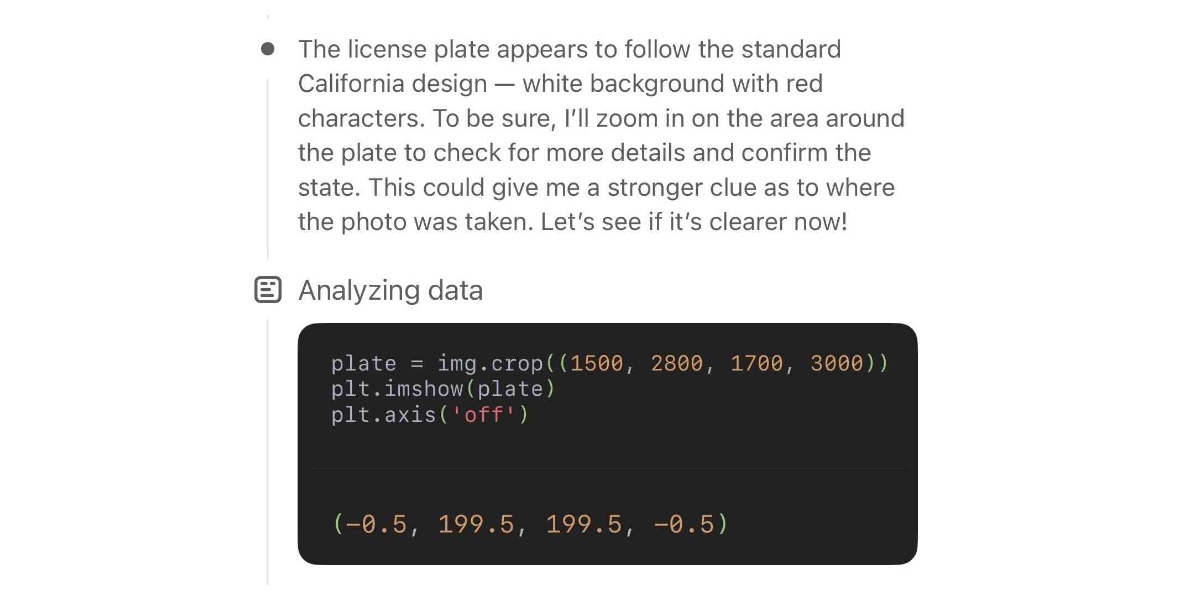

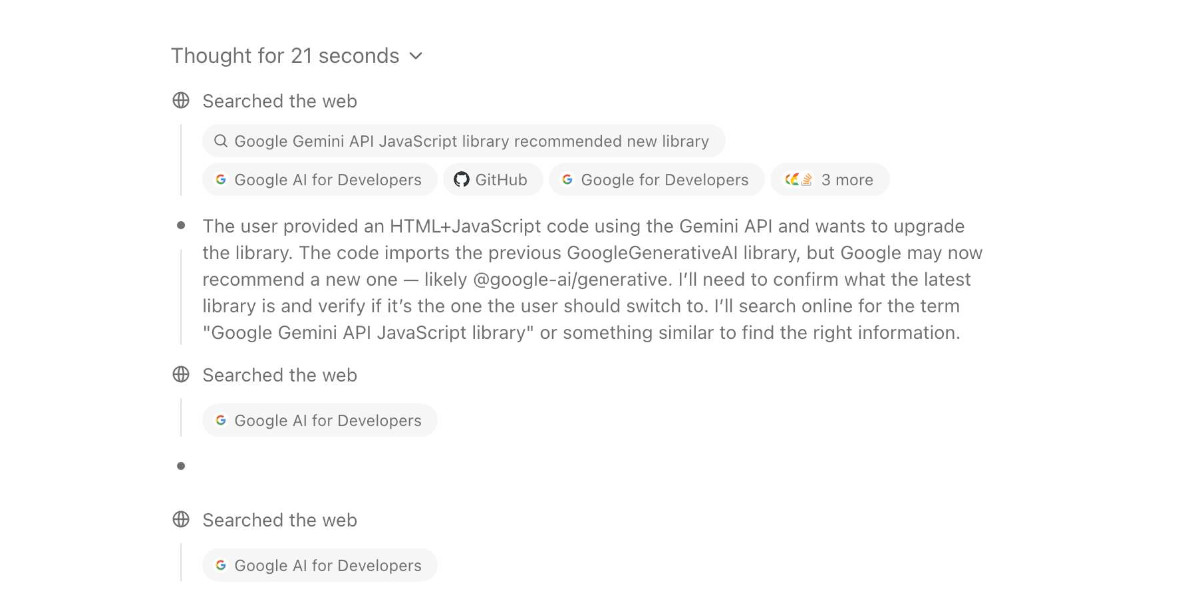

Der Autor hat festgestellt, dass OpenAIs GPT-5 in Kombination mit Bings Suchfunktionen erstaunlich gute Suchfähigkeiten besitzt. Es bewältigt komplexe Aufgaben, führt gründliche Internetrecherchen durch und liefert Antworten, was ihm den Spitznamen „Forschungsgoblin“ eingebracht hat. Mehrere Beispiele zeigen die Fähigkeiten von GPT-5: Identifizierung von Gebäuden, Untersuchung der Verfügbarkeit von Starbucks Cake Pops, Auffinden des offiziellen Namens der Universität Cambridge und vieles mehr. GPT-5 führt sogar selbstständig mehrstufige Suchen durch, analysiert die Ergebnisse und schlägt Folgemaßnahmen vor, wie z. B. das Erstellen von E-Mails zur Informationsanfrage. Der Autor kommt zu dem Schluss, dass die Suchfunktionen von GPT-5 die manuelle Suche an Effizienz übertreffen, insbesondere auf mobilen Geräten.

Mehr lesen