Cursor, l'assistant de codage IA, obtient un financement de 900 millions de dollars

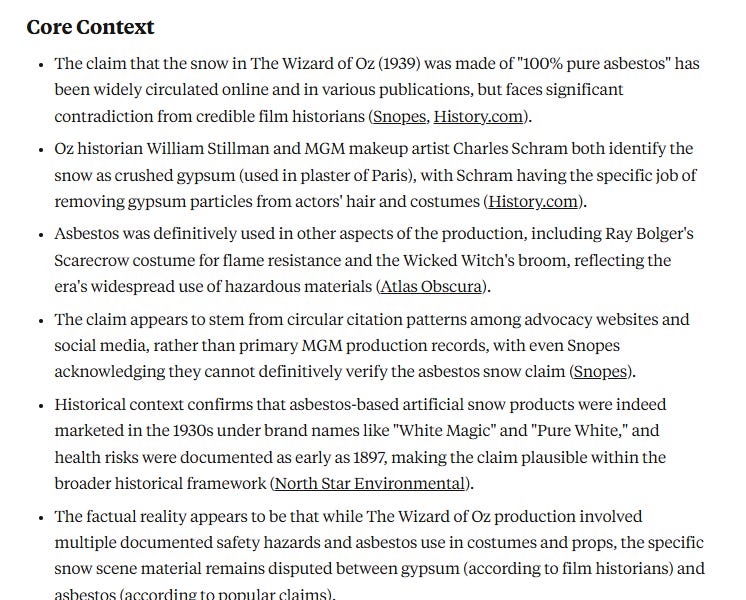

Anysphere, le laboratoire à l'origine de l'assistant de codage IA Cursor, a annoncé une levée de fonds de 900 millions de dollars pour une valorisation de 9,9 milliards de dollars. Les investisseurs comprennent Thrive, Accel, Andreessen Horowitz et DST. Cursor affiche plus de 500 millions de dollars de revenus annuels récurrents (ARR) et est utilisé par plus de la moitié des entreprises du Fortune 500, notamment NVIDIA, Uber et Adobe. Cet investissement important permettra à Anysphere de poursuivre ses recherches et son développement dans le domaine du codage assisté par IA, renforçant ainsi sa mission de révolutionner l'expérience de codage.