Dimensões de Incorporação: De 300 para 4096 e Além

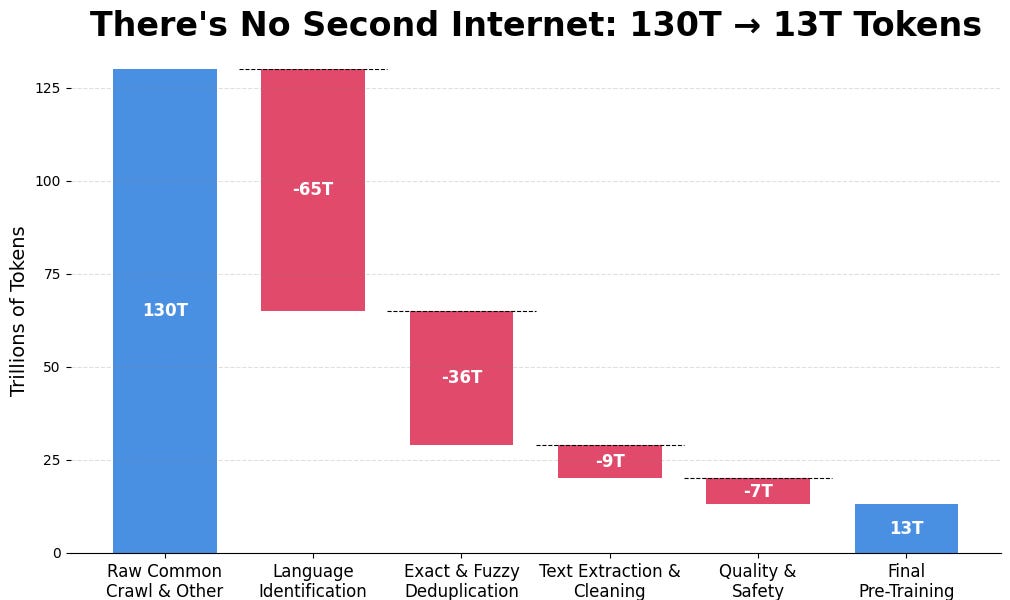

Há alguns anos, embeddings de 200 a 300 dimensões eram comuns. No entanto, com o surgimento de modelos de aprendizado profundo como BERT e GPT, e avanços na computação GPU, a dimensionalidade dos embeddings explodiu. Vimos uma progressão de 768 dimensões do BERT para 1536 do GPT-3 e agora modelos com 4096 dimensões ou mais. Isso é impulsionado por mudanças arquitetônicas (Transformers), conjuntos de dados de treinamento maiores, o surgimento de plataformas como Hugging Face e avanços em bancos de dados vetoriais. Embora o aumento da dimensionalidade ofereça ganhos de desempenho, também introduz desafios de armazenamento e inferência. Pesquisas recentes exploram representações de embeddings mais eficientes, como o aprendizado Matryoshka, buscando um melhor equilíbrio entre desempenho e eficiência.